微软最近宣布了在其Azure AI Foundry Agent服务中预览发布模型上下文协议(MCP)支持。该服务于今年5月向公众开放,旨在显著提升人工智能(AI)智能体的互操作性。

生成式 AI 智能体越来越强大,但其实用性常常因为连接到企业数据源、工作流程和专业知识库的复杂性而受到限制。传统上,这涉及到繁琐的过程,例如手动编写 Azure 函数、管理 OpenAPI 规范或为每个后端系统开发自定义插件。

最初由 Anthropic 提出的MCP解决了这一挑战。它是一个开放的、基于 JSON-RPC 的协议,允许“服务器”一次性发布工具(函数)和资源(上下文)。任何符合规范的“客户端”(如 Foundry Agent 服务)都可以自动发现并调用这些能力。微软的首席云解决方案架构师 Kapil Dhanger 在 LinkedIn帖子中恰当地将其描述为“AI 集成的 USB-C”,承诺提供“一次连接,随处集成”的体验。解决方案架构师 Abbas Ali Aloc 在 LinkedIn 上回应这一观点,评论说“MCP 听起来像是 AI 智能体的罗塞塔石碑——在促进互操作性方面做得非常出色!”

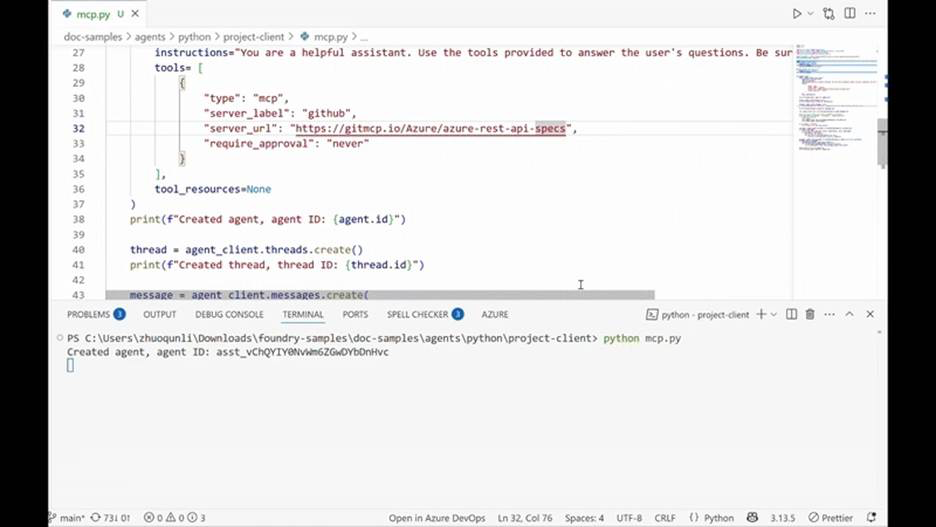

根据公司的文档,通过这次预览,Azure AI Foundry Agent 服务将成为一个一流的 MCP 客户端——允许开发人员引入任何远程 MCP 服务器——无论是自托管还是 SaaS——Azure AI Foundry 将在几秒钟内导入其能力,自动保持更新,并通过对服务的企业级安全保护层进行路由调用。此外,这将极大地简化构建和维护 AI 智能体的过程,这些智能体能够查询记录系统、触发工作流程或访问专业知识。

Azure AI Foundry Agent 服务中 MCP 支持的关键好处包括:

易于集成,简化了与内部服务和外部 API 的连接,无需编写和管理自定义函数。

增强的企业特性,利用 Foundry Agent 服务的企业就绪能力,例如自带线程存储。

简化的智能体开发,这意味着从连接的 MCP 服务器自动添加动作和知识到智能体中,并随着功能的发展保持最新,从而减少了开发和维护时间。

(来源:微软Devblogs)

虽然 Azure AI Foundry Agent 服务提供了一个内置 MCP 支持的 AI 智能体开发统一平台,但谷歌云和 AWS 也通过各自的服务组合集成了 MCP。GCP 的Vertex AI Agent Builder及其智能体开发套件和“MCP数据库工具箱”为通过 MCP 连接智能体到数据源提供了一个结构化的环境。同样,AWS 利用Amazon Bedrock智能体和一系列针对特定 AWS 服务(如 ECS 和 EKS)的开源 MCP 服务器,允许开发人员将实时上下文信息集成到 Amazon Q Developer 等工具中。

最后,这一发布紧随微软 Build 2025 之后,Satya Nadella 强调了一个“设计开放”的 AI 生态系统,以及公司与Anthropic合作将 MCP 作为 Windows 11、GitHub、Copilot Studio 和 Azure AI Foundry 的标准。

原文链接:

https://www.infoq.com/news/2025/07/azure-foundry-mcp-agents/