在智能制造和智能家居加速融合的时代背景下,AI 技术正以前所未有的速度渗透到家电、工厂和企业管理的各个层面。作为全球领先的科技制造企业之一,美的集团正在通过大模型、具身智能、Agent 等前沿技术,推动 AI 能力在多样场景中的落地与重塑。

日前,在美的集团举办的第三届远见者大会上,美的集团 AI 研究院院长徐翼系统阐述了美的在信息智能与具身智能两大核心方向的技术路径、落地挑战与阶段成果。

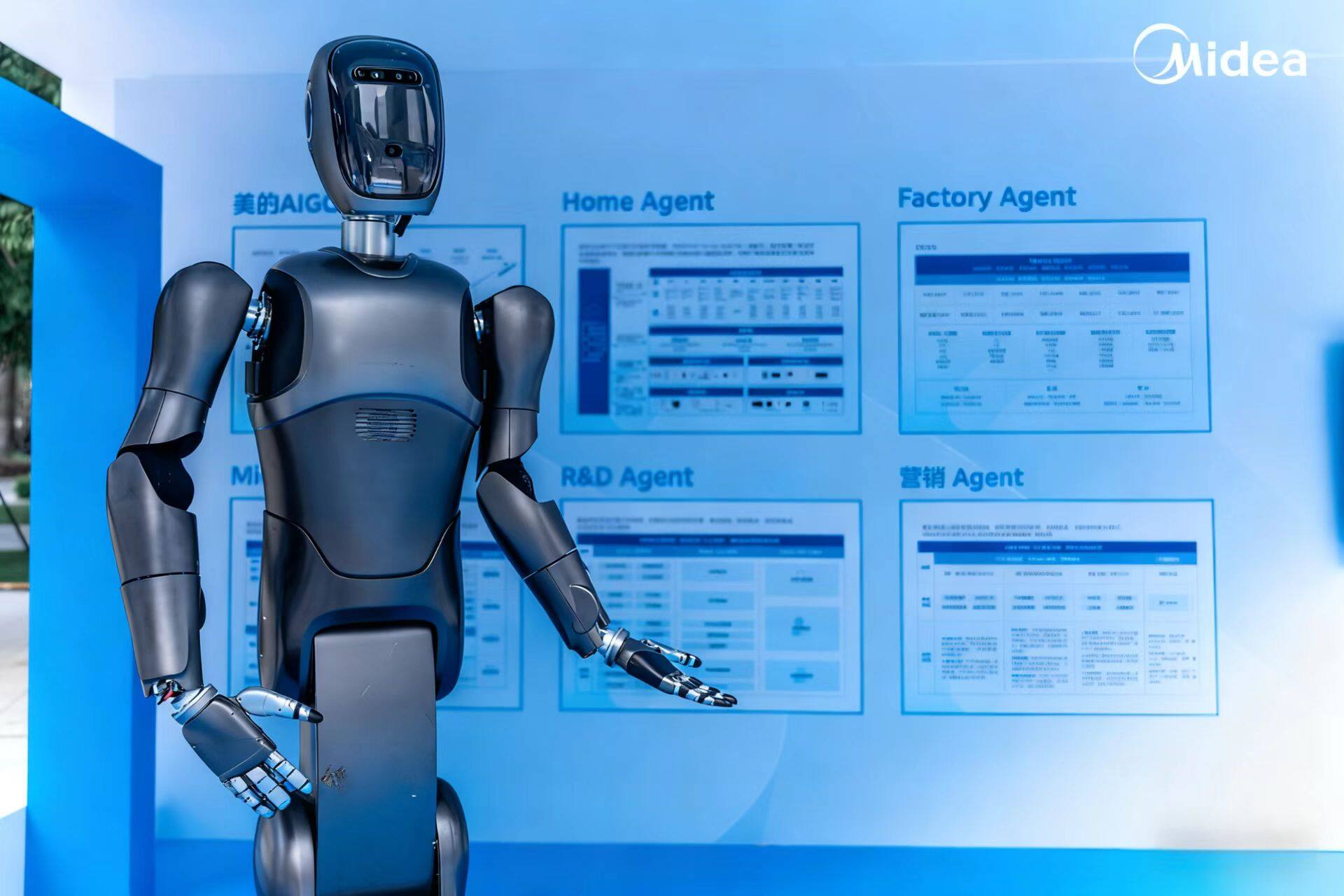

徐翼指出,美的 AI 研究院当前聚焦的两大技术主线分别是以大模型和 Agent 为代表的信息智能技术,以及以 VAL(视觉-动作-语言融合模型)为核心的具身智能技术。两条路径既服务于家庭、工厂、企业等内部场景,也面向行业客户,形成了自研与落地相互促进的循环。

围绕智能家居,构建新的行为数据网络

在家庭信息智能方面,徐翼以“小美语音链路”和 COLMO AI 管家为例,展示了美的对于用户交互体验的探索。他强调,交互的深度与广度正因大模型的引入发生显著变化——从传统的“点击-播放-观看”浅层行为,扩展到多模态、长链条、高语义的深度协作。例如,在家庭聚会场景下,智能家居系统需协同控制灯光、窗帘、空调、清洁等多设备,才能完成用户的真实需求。

“家电其实是新的流量入口”,徐翼将其比喻为“可构建行为数据网络的新节点”,并类比谷歌、亚马逊、Meta 等互联网巨头在行为网络构建上的技术积淀。他认为,智能家居中的人机交互将为美的构建以用户为中心的服务闭环提供全新抓手。

基于对现有家电系统“设备连接不全”“交互缺乏联动”“推理能力不足”“多模态感知未融合”等挑战,美的 AI 研究院正在推进一套覆盖连接、感知、推理、执行、记忆与优化的 Agentic 系统能力架构。演讲中,徐翼详细介绍了这一“多智能体协同架构”的设计思路:以 Chat Agent 为核心,配合控制、信息、记忆等功能型 Agent,实现类“大内总管”式的中枢交互能力。例如,借助三级记忆机制(短期、长期、用户画像),系统可支持显示性记忆与隐性偏好学习,增强个性化响应能力。

“我们希望突破的不只是技术本身,而是人机协作中的预期差。”徐翼表示,用户对家电的操作往往具有明确预期,如“一句‘关灯’可能指代多个不同语义”,缺乏澄清机制的系统容易被认为“智能不足”。为此,美的正通过引入多智能体推理能力,推动家电向具备“自主理解与多轮响应”能力演进。

家庭具身智能:端到端场景真正解放人力

在具身智能领域,徐翼介绍了美的 AI 研究院当前聚焦的典型家庭场景,包括收纳、洗护、烹饪、清洁与照护等大类,现阶段的技术探索主要集中在收纳与洗护两大任务方向。

他指出,团队以“性能(Performance)、能力(Capability)、泛化能力(Generalization)”为评估核心,从特定任务上的高成功率起步,逐步拓展泛化能力,是当前最可行的技术演进路径。

基于这一理念,美的联合学术团队发布了视觉-语言-动作模型 DexVLA,相关论文在今年已经发表。该框架旨在解决传统 VLA 模型中动作生成能力不足的问题,通过引入可插件化的扩散式动作专家模块(Plug-In Diffusion Expert),使模型在面对多种机器人配置与任务时,具备更强的泛化能力与执行能力。

徐翼在现场举例介绍了两项典型探索任务:

洗护任务:从洗衣机中取出衣物,展开后完成折叠与整齐摆放;

食材管理任务:识别冰箱中的食材,抓取后按类别完成分仓存储。

除了 DexVLA,徐翼透露团队还将在今年年底推出另一个具身智能大模型,计划于 NeurIPS 上公开发布。这一工作更进一步探索了端到端模型中推理能力的保留问题,并在架构与训练方法上做出多项创新:

架构方面:采用 MoE(Mixture-of-Experts)设计,不同 Expert 分别专注于多模态理解与机器人动作生成;

训练范式:采用二阶段流程,首先训练 MoE Expert,随后专门训练 open-world 场景下的 embodied reasoning;

验证任务:

数学推理题(验证推理能力是否在端到端训练中保留);

空间理解任务(如“将杯子放在架子的上方或下方”等空间动作计划)。

该模型的目标,是进一步解决当前端到端 VLA 架构中存在的推理能力弱化问题,延续 VLM 在语言-视觉预训练中所形成的理解能力,并将其有效迁移到具身任务中。

尽管在具身智能方向已实现多项原型能力展示,徐翼坦言,当前仍处于技术探索阶段,离真正走进家庭还有不小距离。

“我们演示的层层操作任务,比如叠衣服、冰箱分拣,成功率仍不够稳定,要做到一百次不出错是很难的。”他指出,家庭场景的安全性要求远高于工业场景,“比如机器人开门时把洗衣机门拽坏了,或者操作失误造成物品摔落,甚至伤人,这些情况绝不允许发生。”

他判断,在技术上形成可预测性和泛化能力的大致能力曲线,大约还需两到三年时间。美的 AI 研究院也在评估“功能型机器人”与“家电融合体”的混合产品路径,以规避人形机器人所带来的系统复杂度与成本问题。

工厂智能:从大脑中枢到异构终端协同

除了家庭场景,美的在工厂智能的方向也在持续展开探索。

徐翼介绍,在工业侧,美的正以“工厂大脑”作为中枢,打通异构设备与具身终端的调度、控制与反馈体系。中枢系统能够统一指挥包括人形机器人、AI 眼镜、移动终端在内的多种智能设备,并整合虚拟智能体,如品质智能体、工艺智能体等,实现任务分派与状态交互。

在工厂端的具身智能方面,研究团队已推进多个关键任务:

在美的洗衣机荆州工厂,美的部署了具备视觉检测与基本操作能力的巡检机器人,可识别洗衣机运行状态;

在钣金上下料任务中,通过对原材料位置的视觉识别,实现一定泛化能力的分拣机器人,应对物体状态的随机变化;

在打螺丝任务中,展示了“双臂协作具身大模型”的应用,左臂通过视觉与力传感完成对孔定位,右臂进行螺栓安装,协同精度显著提升。

“这个双臂系统是我们具身智能皇冠上的明珠”,徐翼说,“它不仅具备协作能力,而且能实现一定程度的泛化,真正完成复杂装配任务。”

用 AI 重构生产、客服与研发能力

在企业内部场景,美的 AI 研究院聚焦“高效生产”目标,推进多项智能化基础能力建设,包括 OCR 文档解析、客服 Agent 系统与代码大模型。

徐翼指出,对于制造型企业而言,OCR 是实现数据化的基础。“美的内部有大量流程图、复杂表格,这些信息如果无法结构化,就无法进一步智能化。”他透露,美的 OCR 大模型在复杂文档场景下的表现优于业内主流模型,在简单文档方面也位于前列。

在客服智能体系统上,美的构建了由对话模型与状态模型并行的 Agentic 架构,状态模型可调用大量 MCP Service,支持流程强耦合的业务交互。“这个系统不同于小美语音链路,必须和业务规则深度绑定,因此我们采取了多模型并行的方式。”

据悉,在代码智能方面,美的也在推进工程效率提升。