用飞桨一站式搞定大模型生产 PaddleFleetX 大模型开发套件业内首发。

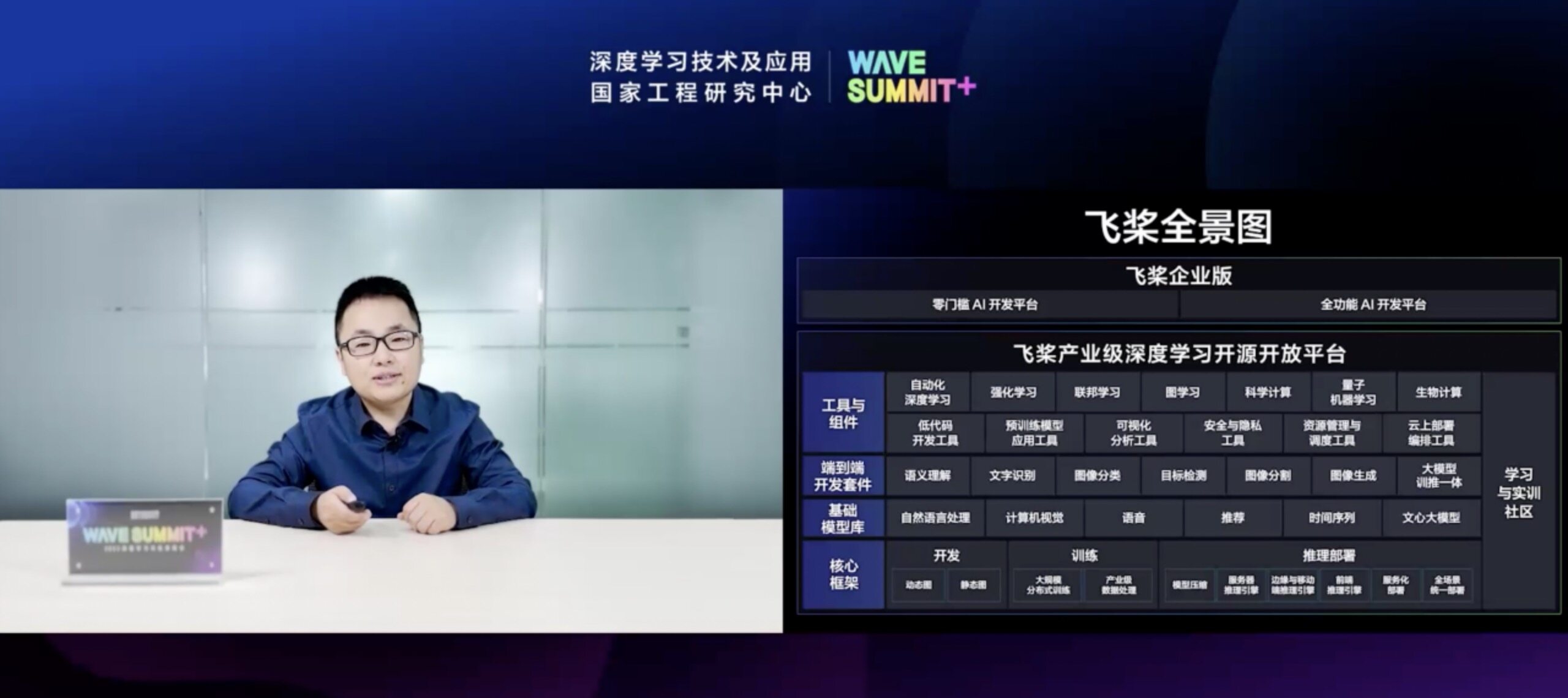

11 月 30 日,在百度 WAVE SUMMIT+2022 深度学习开发者峰会上,百度 AI 技术生态总经理马艳军发布了飞桨深度学习平台的最新技术和生态进展,全新发布飞桨开源框架 2.4 版本,带来业界首个端到端大模型开发套件 PaddleFleetX,联合 12 家硬件生态伙伴发布飞桨生态发行版,AI Studio 学习与实训社区升级推出企业实训和生态异构算力中心等等。

图:百度 AI 技术生态总经理马艳军分享飞桨平台最新发布

飞桨开源框架 2.4 版发布

此次飞桨升级的 2.4 版本,框架开发更加灵活便捷,大规模模型分布式训练持续领先,并实现了全场景高性能推理部署。

开发方面,飞桨开源框架 2.4 版本针对稀疏计算、图学习等重要场景新增 160 多个 API,并且 API 开发门槛和成本大幅降低,使此次新增的 API 中有 1/3 来自生态开发者的贡献。针对 AI for Science 场景需求,2.4 版实现了通用的高阶自动微分功能,更好地支持科学计算相关应用。同时,飞桨全面提升了核心动转静技术的可扩展性和部署灵活性,新模型动转静成功率达 92%,充分发挥动态图和静态图各自优势。

训练方面,2.4 版全新升级,推出了基于 GPU 的超大规模图模型训练引擎 PGLBox,在业内率先实现了可同时支持复杂算法、超大图、超大离散模型的一体化图学习方案。另外,飞桨的集合通信分布式训练性能也做到了优化,为大模型训练提供了全面丰富的分布式训练性能优化体系。

作为 AI 实现产业落地的“最后一公里”,模型的推理部署过程十分关键。首先对于大模型的推理,飞桨开源框架 2.4 版支持自适应模型切分和分布式推理等功能,依托飞桨框架动转静能力,可实现自动深度融合及高性能优化,全面支撑大模型应用落地。同时为了从根本上解决 AI 应用落地面临的场景碎片化、开发成本高、推理速度慢三大难题,飞桨全新推出的全场景高性能 AI 部署工具 FastDeploy,一站式满足端、边、云多场景,多框架与多硬件的部署需求,不仅 API 设计统一,简单易用,而且还支持自动化压缩与高性能推理引擎深度联动,可充分发挥软硬一体融合优势,推理性能提升,为 AI 产业应用落地提供最优解。

持续降低应用门槛,加速 AI 应用落地

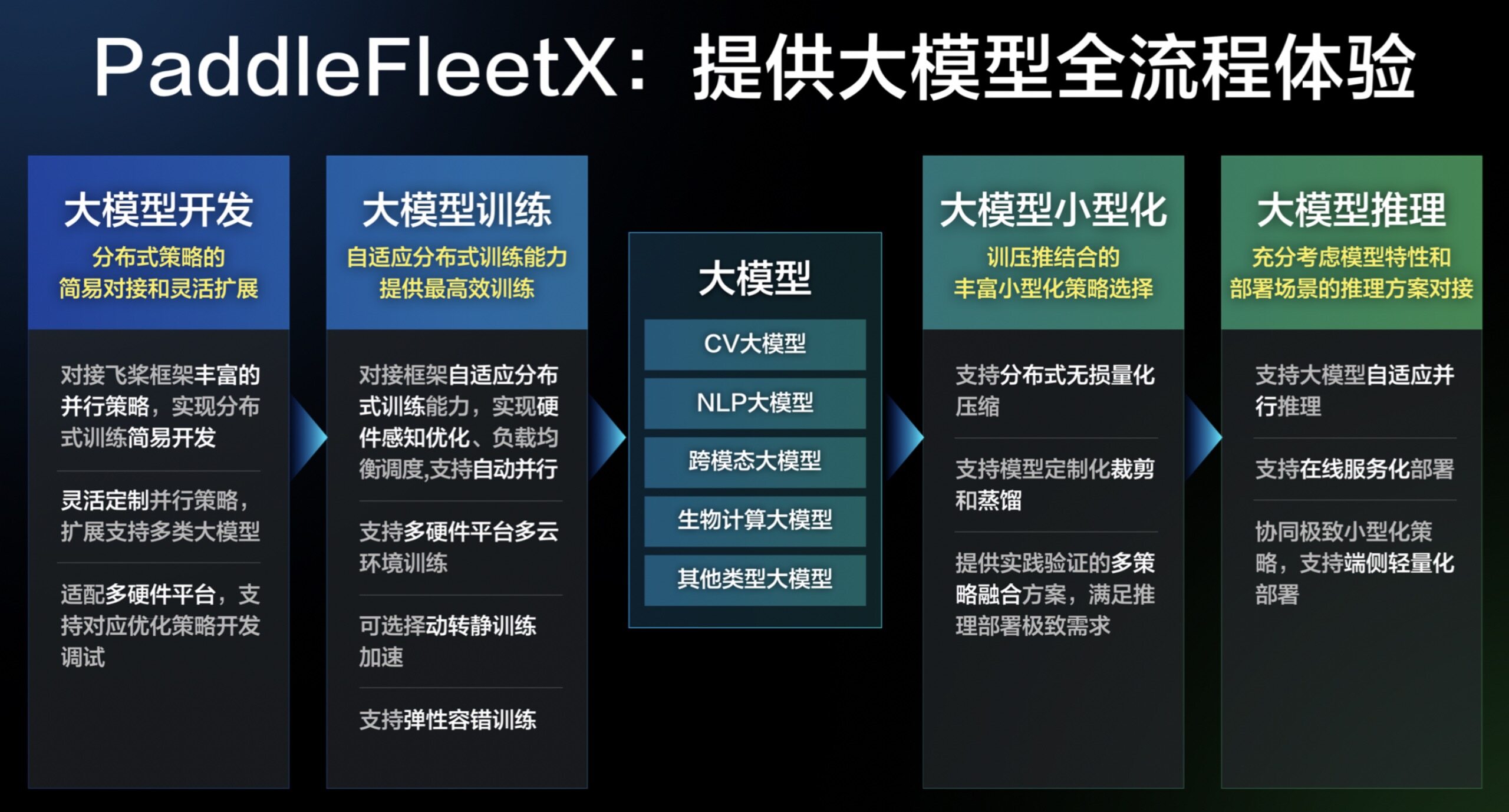

大模型的应用可以降低 AI 应用的门槛,但大模型开发、训练、推理部署过程仍具有很大的挑战。为了更好地支撑大模型应用落地,飞桨全新发布端到端大模型开发套件 PaddleFleetX。PaddleFleetX 无缝对接飞桨并行策略并支持定制化组合,可以扩展支持更多类型的大模型,开发者可以根据模型结构的特点自行选择并行策略组合,并且支持 GPU/NPU/DCU 等多硬件平台的多云环境的训练调试。同时,PaddleFleetX 还支持自适应分布式推理技术,真正做到了分布式策略的训推一体,大可支持超大模型的服务化部署,小可协同训压推结合的丰富小型化策略,实现端侧轻量化部署。

此次峰会上,飞桨产业级开源模型库开源算法新增至 600 个以上,覆盖视觉、自然语言、时序建模等主流任务场景;经过产业实践打磨的精度与性能平衡 PP 系列特色模型新增至 42 个;飞桨产业实践范例增至 68 个,覆盖金融、工业、交通、互联网、安防、教育等十个重点行业场景;发布飞桨产业级模型库一站式入口,聚合模型知识与工具集,打通模型选择、快速体验、模型开发与使用、模型部署全流程。飞桨从产业模型开源、范例参考等方面蓄力,为企业应用 AI 技术提供便利支持,共同解决产业痛点难点。

发布硬件生态共创计划

推动人工智能在产业中落地应用,离不开与硬件的发展。今年 5 月,飞桨联合硬件生态伙伴发布“硬件生态共创计划”,在联合研发、资源共享、联合授权、培训赋能等多个维度全面合作。截至 11 月,飞桨“硬件生态共创计划”成员已经从 13 家增加至 28 家。同时,飞桨携手英伟达、Arm、寒武纪、昆仑芯、天数智芯、Graphcore、燧原等 12 家厂商联合发布了飞桨生态发行版,在为开发者提供更好的软硬一体化体验的同时,携手共建硬件生态。

为进一步加速 AI 产业智能化升级,飞桨深入产业场景,联合国家能源集团、中国工商银行、中国联通、中国石油、中国铁道科学研究院、中国移动、中国一汽等企业,发布产业实践范例征集计划,链接企业与开发者,解决各行业实际产业场景中的关键问题,助力 AI 产业落地。

飞桨建设的 AI Studio 学习与实训社区致力于让 AI 学习和应用更简单,目前也已成为国内最大的 AI 开发者社区。本次峰会上,AI Studio 升级新增两大板块:企业实训和生态异构算力中心。

企业实训为企业应用深度学习提供了实训阵地。截至目前,飞桨已与 20 余家企业联合举办赛事,共同探索 AI 应用方案,培养 AI 人才。长期以来,AI Studio 为广大开发者提供了包括 CPU 和 GPU 的丰富算力资源,又接入了曙光 DCU 算力,为开发者提供线上体验中心,为硬件基础设施提供便捷的体验环境。

评论