写点什么

创作场景

- 记录自己日常工作的实践、心得

- 发表对生活和职场的感悟

- 针对感兴趣的事件发表随笔或者杂谈

- 从 0 到 1 详细介绍你掌握的一门语言、一个技术,或者一个兴趣、爱好

- 或者,就直接把你的个人博客、公众号直接搬到这里

登录/注册

收录了 数据规模 频道下的 50 篇内容

Netflix使用会员的视频观看记录实时准确地记录用户的观看情况,并为会员提供个性化推荐。Netflix的发展,对视频观看记录时序数据存储的规模化提出了挑战,原有的单表存储架构无法适应会员的大规模增长。本文介绍了Netflix团队在规模化时序存储中的做法,包括数据存储方式的改进,以及在存储架构中添加缓存层。存储架构在Netflix的实际应用验证了该时序数据存储的有效性。

TiDB在网易游戏的技术实践。

在数据要素战略持续升级的背景下,发展以隐私计算为代表的密态技术,是解决大规模数据安全可信流转的技术手段。

本文介绍百分点认知智能实验室出品的基于动态知识图谱的大规模数据集成技术。

本篇将介绍 TSDB 在方案选型和存储模型设计上的实践。

今天我们就以大型电商热销榜为例,来谈一谈从 1 万用户到 1 亿用户,从 GB 数据到 PB 数据系统,技术思维需要怎样的转型升级?

全文总共分为三个部分,第一部分对大规模数据存储进行概述;第二部分以百度网盘为例介绍百度沧海如何支撑 EB 级大规模存储;第三部分享一些相关的经验与思考。

本文将着重介绍在 TSDB 中起了重要作用的两个核心功能的设计。

本次分享介绍目前知乎已读服务的整体架构以及如何在这个架构上应对各种挑战满足业务需求。

本篇文章首先介绍etcd优化的背景,为什么要进行优化, 之后介绍 etcd 内部存储系统的工作方式,之后介绍本次具体的实现方式及最后的优化效果。

MySQL的问题:之前的一次二次扩容的经历

微众银行在2014年成立之时,就非常有前瞻性的确立了分布式架构的基础架构。当时,腾讯有一款金融级的分布式数据库产品TDSQL,其业务场景和对数据库的可靠性要求,和银行场景非常类似。

存储短缺带来的焦虑,在 2026 年仍将延续。

一个基于 Q-learning 的强化学习(RL)智能体,通过观察数据集特征、尝试不同的 Spark 配置,并从性能反馈中学习,能够自主学习出最优的 Spark 配置策略。

以绝对王者之姿强势突围,一登场就刷新了行业的认知边界。直接“横扫”多项权威基准测试,以“世界最强多模态理解”“交互最深智能体”“推理怪兽”的姿态,强势碾压全球所有同类模型。

ByteHouse将持续为银行等金融领域提供高性能、高可用的分析服务,助推数据价值进一步释放。

在企业快速发展的过程中,数据量的迅速增加和对数据处理效率的更高要求成为了企业面临的重大挑战之一。如何在保持高可用性和灵活性的同时实现对海量数据的有效管理,是每一个企业必然考虑的问题。针对这一关键问题,本文将探索YashanDB的弹性设计,以实现企业

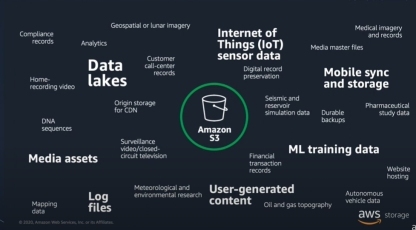

AWS S3 是如何在万亿数据规模,每秒千万次请求下,既要保证可用性(99.99%),持久性(11个9)的前提下,同时做到数据强一致性的呢?让我们一探究竟。

迪卡侬分享了其采用开源库 Polars 来优化数据流水线的原因。

本文分享了关于 AI 时代数据基座架构的思考,如何通过该架构解决 AI 原生应用的数据挑战,以及在云计算、新硬件环境下实现高性能数据基座的工程实践。