在大模型与推理需求持续增长的背景下,算力基础设施正在从云原生阶段向 AI 原生阶段演进。围绕这一趋势,如何将底层软硬件能力转化为可用、易用、高效的算力服务,成为当前基础设施设计中的关键问题。

近日,商汤大装置首席架构师项铁尧在 2026 中关村论坛上发表了《商汤大装置 AI 原生云基础设施探索与实践》主题演讲,系统阐述了商汤大装置对 AI 原生时代算力集群建设的前沿判断与实践路径——如何将软硬件能力真正转化为客户可用、易用、高效的算力服务。

在他看来,当算力集群的发展进入 AI 原生时代,新的架构范式应具备统一的规范、极致弹性的扩缩容机制以及为大模型训练和推理深度优化的 AI 集群 Runtime。

1. AI 算力池:面向角色、水平分层、资源自由流转

项铁尧从底层技术视角切入,指出 Kubernetes(全球最流行的容器编排平台)正朝着 AI 方向发展。

随着动态资源分配(DRA)、Workload API 与 Gateway API 三项核心新特性的引入,K8s 逐渐从简单的容器编排工具,进化为 AI 时代的操作系统。这背后,其实是整个行业在加速从云原生集群时代向 AI 原生时代跃迁。

围绕上述转变过程,项铁尧重点介绍了商汤大装置前瞻打造的核心产品——AI 算力池。

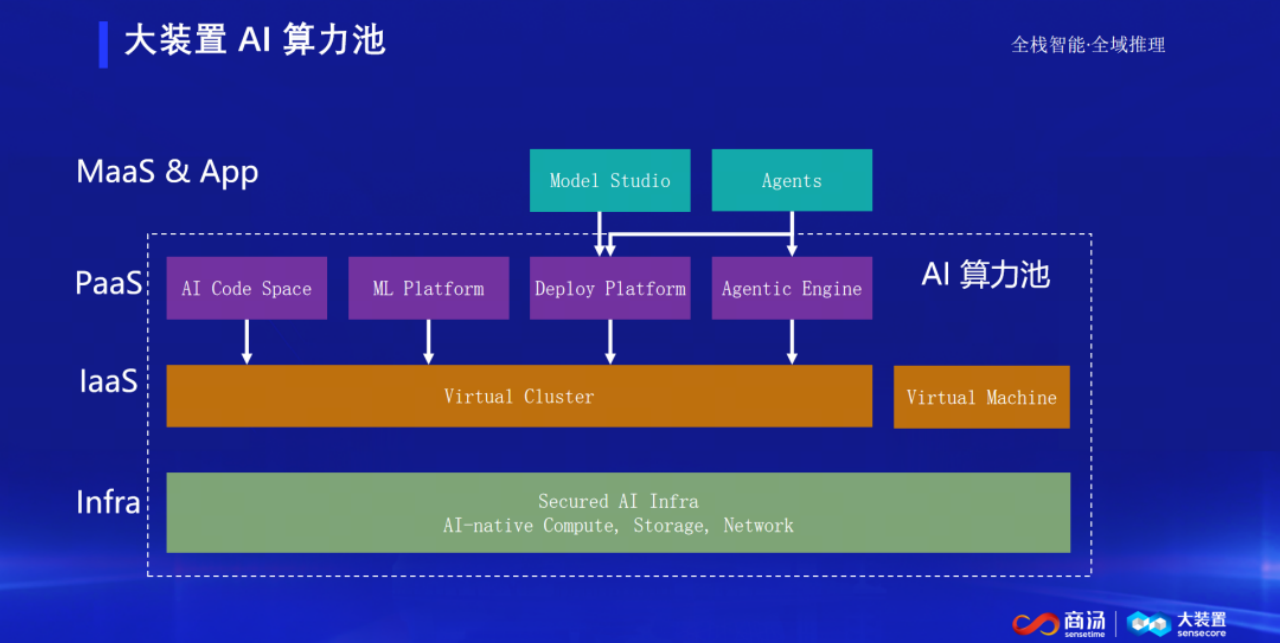

据了解,AI 算力池面向 AI 原生时代全新算力服务需求,采用"三明治"水平分层架构,从底层高度优化的计算网络存储基础设施,到中间层全新的虚拟集群技术,再到上层涵盖开发机、训练平台、部署平台及 Agentic Engine 的完整 PaaS 产品体系,全面杜绝不同产品之间的资源孤岛问题。

其中,大装置 AI 算力池具备三大优势:

1)面向角色。面对客户内部角色多元、需求复杂的现实,分别设计服务形态、提供差异化的解决方案。比如针对集群管理员与平台工程师提供高弹性虚拟集群资源;针对 AI 研究员,可提供丰富的脚本工具与高效研发环境等等。

2)水平分层。AI 算力池采用“三明治”结构,杜绝产品间信息、资源孤岛的可能。

3)资源自由流转。用户只需购买一种通用算力形态,即可在虚拟机、虚拟集群、AI Code Space 开发机等不同产品形态之间秒级自由切换,充分应对国内普遍存在的算力潮汐效应,大幅提升集群整体资源利用率。

2. 虚拟集群:全量托管,秒级弹性扩缩容

值得一提的是,在底层 Infra 层,商汤大装置创新应用虚拟集群技术,解决了传统云托管服务中“数据面管理重、扩容慢”的痛点。

有别于主流云厂商仅托管控制面,数据面仍需用户自行管理的传统模式,全新的虚拟集群技术,实现了控制面与数据面的全量托管,扩缩容效率从传统方案的数分钟乃至数十分钟压缩至秒级,同时提供完全标准的 K8s API,用户无需对现有代码做任何修改即可无缝接入。

3. 三大自研套件:护航超大规模 AI 训练与推理

在虚拟集群基础上,项铁尧进一步提出 AI 集群 Runtime 产品概念。

“要快速搭建一个离线混部、训练推理混合使用的集群非常复杂,因为现在 AI 新的技术层出不穷,各种组件之间协同优化同样复杂。”项铁尧指出,“为了解决这种难题,我们通过智能推荐、深度调优与版本锁定机制,帮助用户快速搭建复杂的在离线混部、训练推理混合使用集群,降低 AI 基础设施的使用门槛与运维复杂度。”

为了进一步满足超大规模 AI 生产场景的极致性能需求,商汤大装置还自研了三大套件:

1)SenseCore Scheduler:高性能调度器,支持复杂异构硬件的在离线混合调度。

2)容错引擎:解决超大规模训练中的不稳定性,实现故障自动检测与隔离。

3)Agentic Engine:针对不断涌现的 Agent 使用需求,进行深入优化,包括沙箱预热、快速启动、规划保持、状态快照等。

4. 虚拟节点:打通弹性算力最后一环

为了以更灵活的规格为客户提供算力资源,商汤大装置同步自研虚拟节点技术,它具备三大优势:

1)虚拟集群体系无缝集成;

2)提供相比于虚拟机更轻量级的使用体验以及更高效的性能;

3)提供相比于 runc 更好的安全性和隔离度。

5. 生态合作,共同助推国产推理基础设施迭代

目前,商汤大装置已与趋境科技展开深度合作,为其 ATaaS 高效能 AI Token 生产服务平台提供算力支撑。该平台目前可支撑万级 AI 推理需求,达到日均万亿级 Token 的整体产能。

此外,作为九源智能计算系统生态联合体理事单位,商汤大装置正积极参与国产智能计算系统的建设。通过产学研用协作,旨在统一软件生态并加速技术成果转化,共同推动国产推理基础设施的迭代升级,为新质生产力的落地提供支撑。