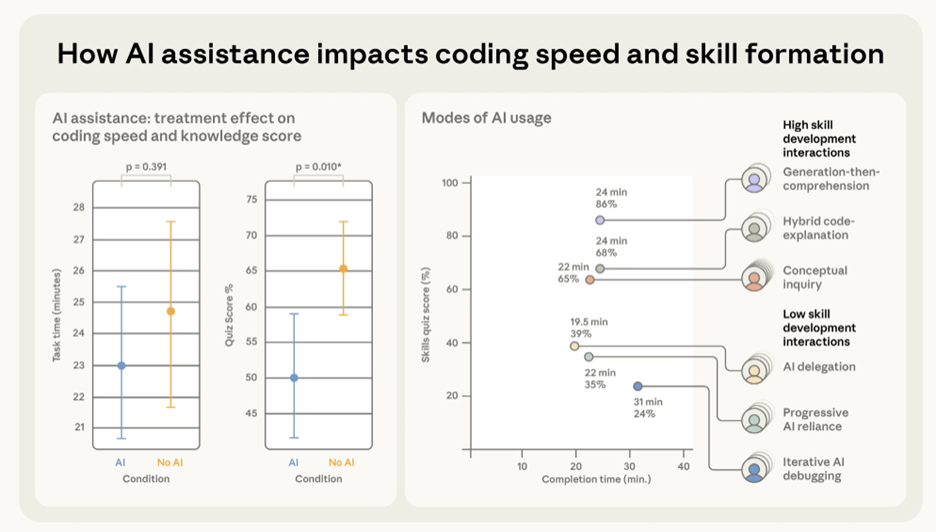

Anthropic 近日发布了一项随机对照试验,结果显示,使用 AI 编程辅助工具的开发者在理解能力测试中的得分比手动编程的开发者低 17%,且其生产力方面的提升未达到统计显著性。在对 52 名初级工程师的研究中,研究人员发现了明显的分化:将 AI 用于概念性问题的开发者测试得分达到或超过 65%,而将代码生成任务委托给 AI 的开发者得分则低于 40%。

Anthropic 研究人员开展的这项随机对照试验,旨在考察在学习新工具时,AI 编程助手如何影响技能发展。52 名参与者大多为初级工程师,且都至少有一年每周使用 Python 的经验。他们需要学习 Trio——一个此前无人接触过的异步编程库。对照组与 AI 辅助组均完成了两项编码任务,随后参加了一项测验,内容涵盖调试、代码阅读和概念理解。

AI 组完成任务的时间平均快约两分钟,但这一差异在统计学上并不显著。然而,测验成绩呈现出不同的结果:AI 组平均得分为 50%,而手动编码组为 67%,差距在调试类问题上尤为明显。

在 Hacker News 的讨论中,用户 siliconc0w 概括了核心张力:

人们是在用学习机会和能力退化,去换取一种并不总能兑现的生产力提升。

另一位评论者 AstroBen 提出了代际层面的担忧:

我在想,未来会不会出现这样一种情况:初级工程师再也无法真正掌握独立工作的技能和经验,而是完全依赖 AI。

研究发现,开发者如何使用 AI,比是否使用 AI 本身更关键。低分模式(平均低于 40%)包括:完全将代码生成委托给 AI、逐步把所有工作交给 AI 的渐进式依赖,以及在调试过程中依赖 AI 直接给出解决方案而非帮助澄清问题。高分模式(平均 65% 或以上)则有一个共同点——保持认知参与:在生成代码后提出追问,将代码生成与解释结合,或仅在概念性问题上使用 AI,而编码过程仍由自己完成。正如 Hacker News 用户 AstroBen 所说:

AI 作为个人导师极其有用。

这一模式也得到了独立学术研究的支持。2024 年,马里博尔大学(应用科学)Jošt、Taneski 与 Karakatič 开展了一项为期 10 周的实验,32 名本科生在学习 React 过程中参与研究。结果几乎一致:在代码生成与调试中使用大语言模型(LLM)与最终成绩之间存在显著负相关,而将 LLM 用于解释性用途则未发现显著负面影响。研究作者指出,这种使用方式“可能不会妨碍,甚至可能有助于学生表现”。

Medium 撰稿人 Tom Smykowski 认为,Anthropic 的研究主要测量的是学习新库时的表现,而非整体编程能力。他写道:

这项研究展示的不是 AI 如何影响程序员整体能力,而是 AI 使用如何影响你学习新事物的过程。

另一位 Medium 作者 Guru Prasad 则将核心张力界定为“认知参与”与“认知卸载”之间的区别,而非简单的“使用 AI”与“不使用 AI”的对立。

这项研究关注的不是 AI 对程序员整体能力的影响,而是当你学习新技术、新工具时,使用 AI 会带来怎样的影响。

这些发现与 Anthropic 此前的观察性研究形成对照。早期研究显示,在开发者已经具备相关技能的任务中,AI 可将任务完成时间缩短 80%。研究人员指出,AI 可能在既有技能领域提升生产力,同时在新技能习得方面产生抑制作用。不过他们也承认,本次研究仅测量了任务完成后的即时理解水平,并未追踪长期技能发展。

Anthropic 建议在部署 AI 工具时进行有意识的设计,以支持工程师的学习成长。他们指出,生产力收益可能以削弱监督 AI 生成代码所需的调试与验证能力为代价。目前,包括 Anthropic 与 OpenAI 在内的主要大语言模型提供商,都已推出专门的学习模式,强调理解优先而非任务委托,例如 Claude Code 的学习与解释模式,以及 ChatGPT 的学习模式。

原文链接:

https://www.infoq.com/news/2026/02/ai-coding-skill-formation/