Martin Fowler 的博客最近探讨了人类在 AI 辅助软件工程中的角色,认为开发者不太可能完全“脱离循环”。文章作者 Kief Morris 指出,许多团队未来会越来越多地以“在循环之上”的方式工作,即制定用于指导 AI 智能体的规范、测试与反馈机制,而非逐一审查 AI 生成的每一段内容。他的分析也呼应了业界更广泛的讨论,即这类由智能体驱动的开发工作流在实际应用中应如何进行验证、监控与管理。

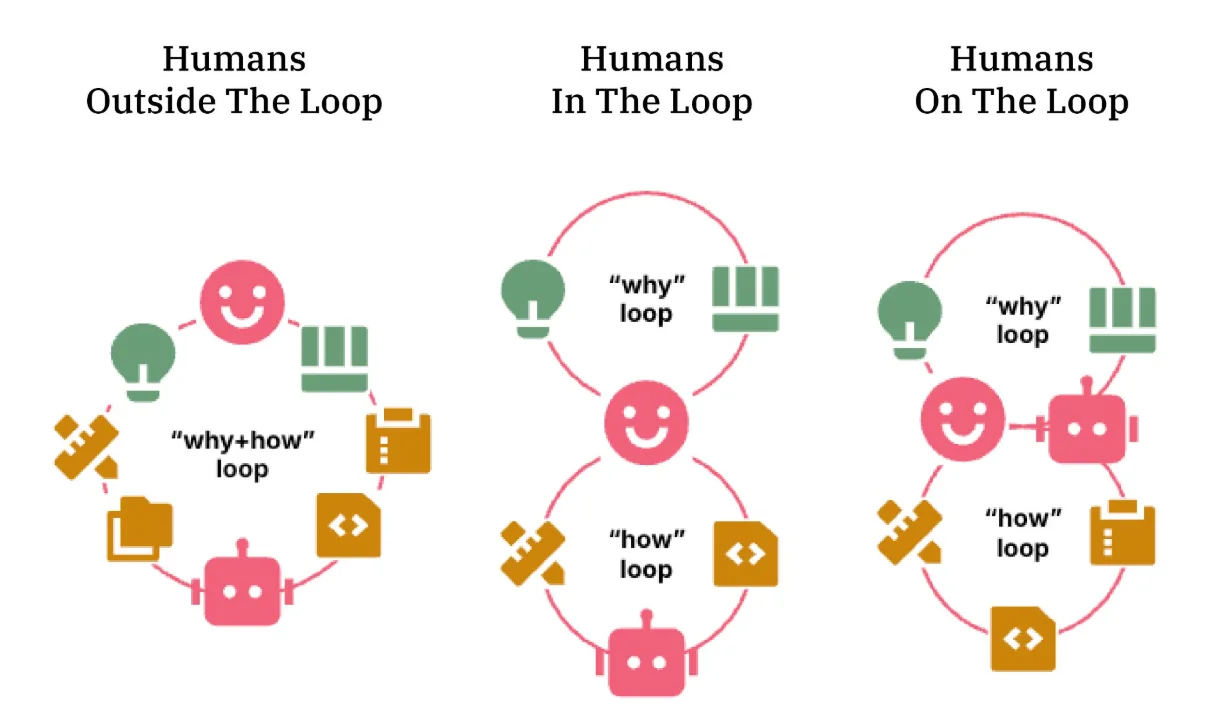

在这篇文章中,Morris 总结了人类与 AI 系统交互的三种模式:在循环中(in the loop),即开发者逐一审查 AI 的每一项输出;脱离循环(out of the loop),即系统基本实现自主运行;以及在循环之上(on the loop),即人类设计并维护用于指导、验证系统行为的机制。Morris 认为第三种模式对软件工程尤为适用——开发者专注于搭建测试框架、设定约束条件与构建评估流程,并以此规范 AI 智能体的行为,而非逐行检查 AI 生成的代码。

来源:MartinFowler.com

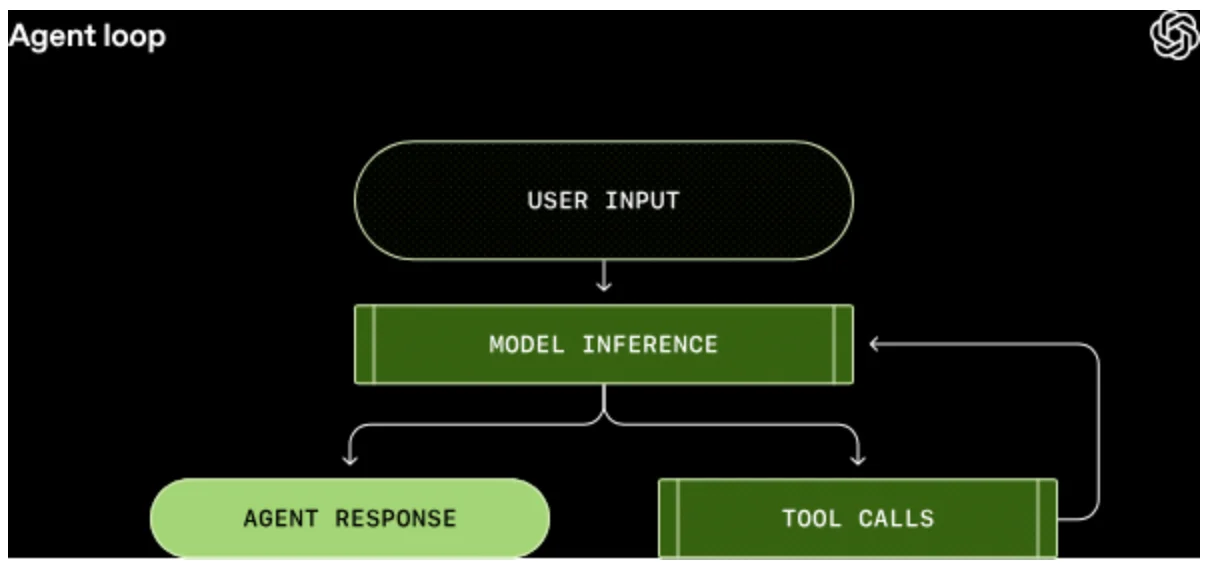

整个行业的组织都在尝试将编程智能体融入软件开发工作流。OpenAI 在对 Codex 系统的技术深度解析中,描述了用于协调用户、模型与外部工具之间交互的“智能体循环”。在这一架构下,系统的输出往往不再是简单的对话回复,而是直接在机器上编写或修改的代码,并通过迭代式的工具调用与反馈循环来生成。

来源:OpenAI

与此同时,开发者对 AI 生成代码的态度依然复杂。Stack Overflow 上的相关讨论与评论凸显了人们对代码可维护性和技术债务的担忧,尤其是当生成的代码需要经过大量审查或重构才能安全集成到生产系统时,所谓的生产力提升往往需要付出相应的代价。

Stack Overflow 的调查数据也反映了这种矛盾。在 2025 年开发者调查中,84% 的开发者表示正在使用或计划使用 AI 工具,但信任 AI 生成内容的开发者比例明显更低。许多受访者指出,调试 AI 生成的代码或验证其正确性往往需要额外投入工作量。

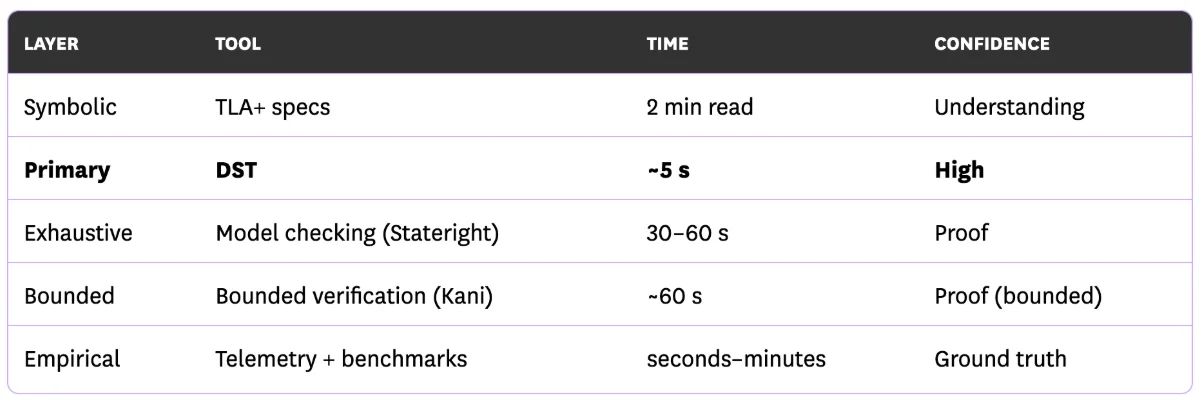

一些工程团队已开始探索通过更完善的验证与控制机制来应对这些挑战。Datadog 在近期一篇技术文章中提出,仅依靠人工审查无法应对 AI 生成的内容,尤其在智能体能够批量生成大量代码的情况下。团队更需要投入建设自动化验证流程,结合规范约束、模拟测试、限定范围验证与运行时遥测等手段来验证系统的行为。

来源:DataDog

Datadog 提出了“测试优先(harness-first)”的智能体开发方法,即通过自动化验证系统,结合规范、模拟测试与运行时遥测来评估智能体行为。在这种模式下,开发者专注于搭建用于验证智能体输出的测试框架,而非对每一项生成内容进行人工检查。

这些讨论凸显出业界对 AI 开发工具配套体系日益增长的关注。随着编程智能体的能力持续提升,多家机构均强调了测试框架、评估体系与可观测系统的重要性——这些工具能帮助开发者监控并引导 AI 生成的内容。

Morris 的“在循环之上”框架也体现了这一普遍的主题。许多团队正在探索如何让开发者设计并维护相应的约束机制,以此规范越来越自主的软件系统的运行方式,而非将人类完全从开发流程中剥离出去。

【声明:本文由 InfoQ 翻译,未经许可禁止转载。】

查看英文原文:https://www.infoq.com/news/2026/03/mf-aiassisted-dev/