就在昨天,AI 编程工具 Cursor 对外发布新模型 Composer 2,主打“更强编码能力”和“更低价格”,试图在 Claude、GPT-4 以及一众新兴代码模型的竞争中继续巩固自身地位。但发布后不久,这一模型便迅速陷入“套壳”质疑。

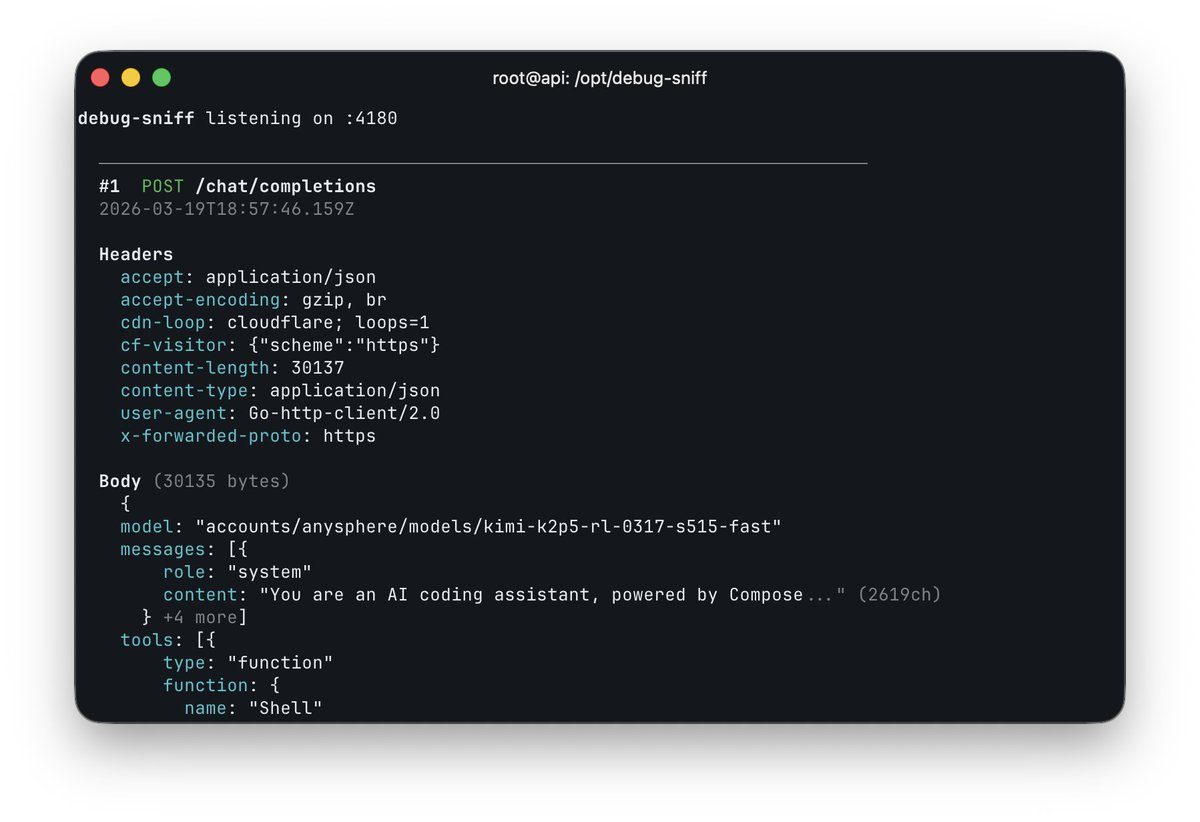

争议的导火索来自一位 ID 名为 Fynn 的开发者的逆向分析。

该开发者在调试 Cursor API 请求时发现,Composer 2 所调用的实际模型 ID 为:kimi-k2p5-rl-0317-s515-fast,

从命名结构来看,这一字符串具备高度可解释性:

kimi-k2p5:直指 Kimi K2.5

rl:强化学习(Reinforcement Learning)版本

0317:可能为模型构建或发布时间

s515-fast:特定推理/速度优化变体

这一“模型指纹”很快在社区传播,并被解读为:Cursor 新模型很可能直接调用或深度依赖月之暗面的 Kimi K2.5,而非完全自研。

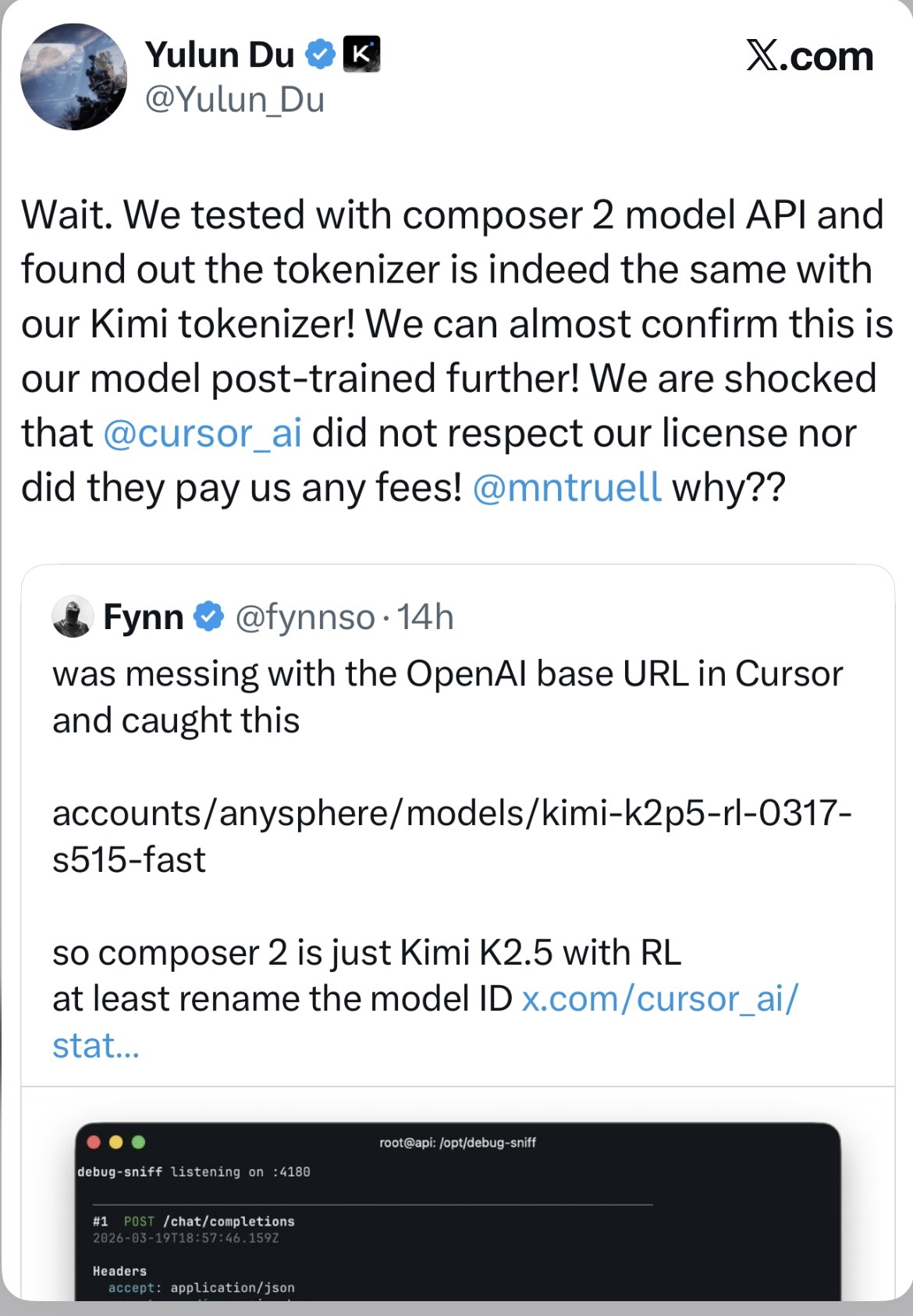

月之暗面的预训练负责人 Yulun Du 在 X 论坛上确认,该分词器(tokenizer)与 Kimi 的完全相同,并质疑 Cursor 没有遵守相关许可,也没有支付费用。

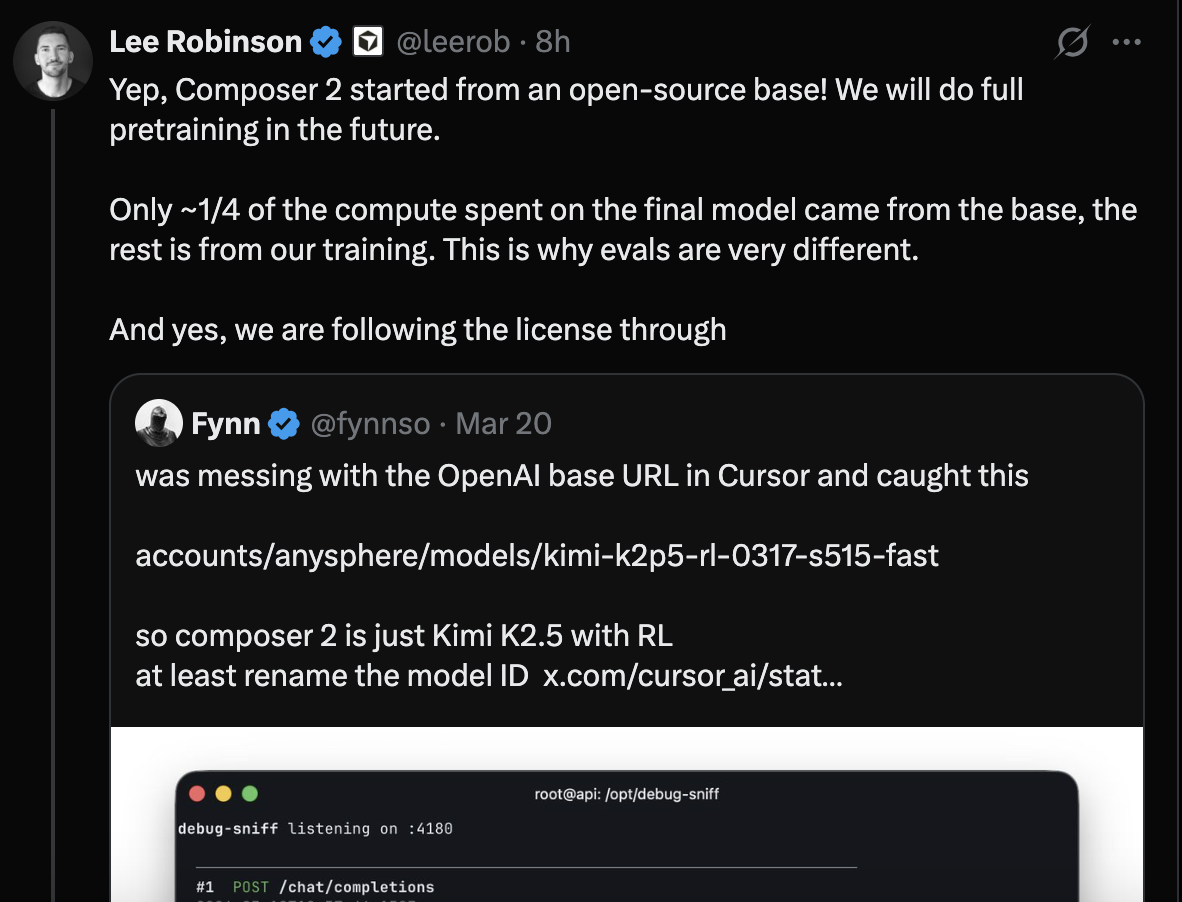

随着事情的发酵,昨天晚上,Cursor 公司 AI 教育负责人 Lee Robinson 在 x 上发文,承认了 Cursor 的确是基于开源模型起步的,并称未来会进行完整的预训练。

他表示 Composer 2 所花费的计算量中只有约四分之一来自开源模型,其余都来自他们自己的训练。这就是为什么评估结果会有很大差异。而且他们也全程遵守许可协议。

目前,Yulun Du 原帖已被他删除。

今早,这场持续了不到一天的模型“套壳”纷争迎来大结局。

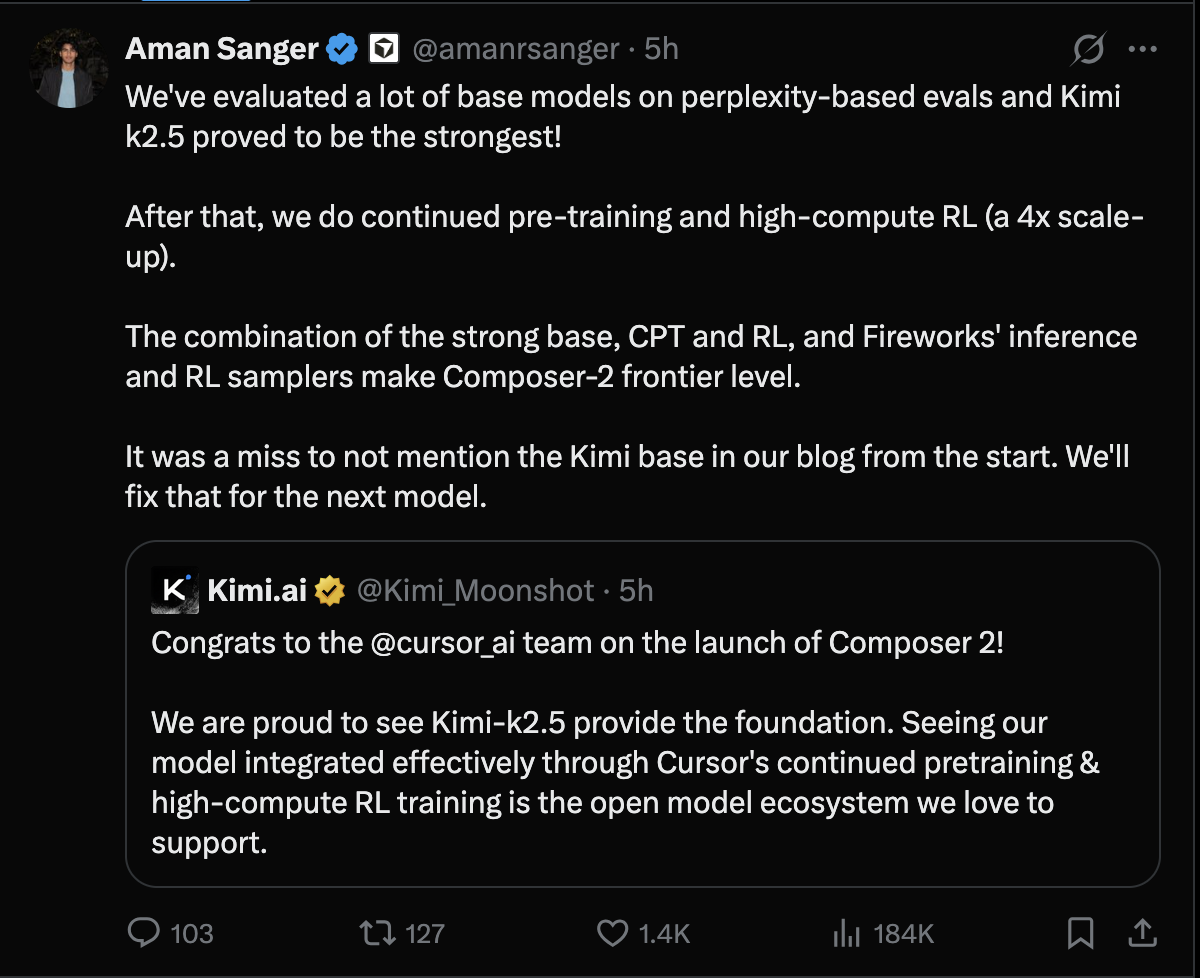

Cursor 联始 Aman Sanger 在 X 上发文,详细澄清了 Composer 2 “血统”问题。

Aman Sanger 写道:“k2.5 被证明是最强的!之后,我们进行了持续预训练和高计算强度的强化学习(规模扩大了 4 倍)。强大的基础模型、持续预训练与强化学习的结合,再加上 Fireworks 的推理和强化学习采样器,让 Composer-2 达到了前沿水平。但一开始没在博客里提到 Kimi 基础模型是我们的疏忽,下一个模型我们会补上这一点。”

Kimi 团队也在 X 上发文祝贺了 Composer 2 的发布。

Kimi 团队写道:“我们很自豪 Kimi-k2.5 能作为其基础模型。看到我们的模型通过 Cursor 的持续预训练和高计算强度强化学习被有效集成,这正是我们乐于支持的开源模型生态。注:Cursor 通过 @FireworksAI_HQ 托管的强化学习与推理平台访问 Kimi-k2.5,这是授权商业合作的一部分。”