撰稿 | 陈姚戈、高允毅

编辑 | 王一鹏

一场从线下蔓延至线上的舆论战争,正发生在伊朗。

线下,伊朗当局正在组织“反骚乱”集会;线上,断网、媒体管制和信息封锁同时发生。

在网络被关闭的时段,伊朗国营媒体几乎成为唯一的信息源。信息真空之中,大量影像只能在社交平台上传播,却很难被证实或证伪。

网民和非营利组织通过自发事实核查发现,伊朗官方发布了使用后期编辑和 AI 生成影像,刻意营造了“反骚乱”的舆论氛围。这类内容在 X 平台上获得了数万次观看。

与此同时,另一方同样出现大量 AI 生成内容。一段被广泛转发的视频显示,有人从建筑物上扯下国旗,发布者称有人撤下了伊朗国旗。这段视频经过反向图片搜索后,被证实拍摄于 2025 年 9 月尼泊尔抗议活动。

非营利组织 WITNESS“技术威胁与机遇”项目副主任 Mahsa Alimardani 指出,在传播过程中被 AI“增强画质”的现场照片,反而被当局用来否定影像本身的真实性,对抗议事实进行整体抨击。

真假在这一过程中被同时稀释,AI 让“知晓真相”这件事变得更难了。

这并非人们第一次意识到 AI 的风险。近几年,从《要求暂停更强模型训练的公开信》,到《针对超级智能的联合声明》,理想主义者反复呼吁放慢脚步、建立约束。但现实是,这些警告几乎没有改变产业的整体方向,也未能阻止更强模型和更激进应用的持续推出。

尤其是在战争中。

从俄乌冲突、以伊冲突,再到今天在伊朗发生的舆论战,包括生成式 AI 在内的技术被广泛采用,而战场也正成为前沿 AI 技术和武器的“实验场”。

《中国航空报》指出,乌克兰战事加速了 AI 在实战中的应用落地,如自主导航、目标识别和交战以及情报处理等。根据《青年参考》,大量军事科技初创企业和国防创新企业在乌克兰聚集,使乌克兰逐渐演变为相关技术的重要孵化地。

更深层的变化在于,科技公司、金融资本与国家战争机器之间,正在形成紧密绑定。

2025 年 11 月,美国国防部长 Pete Hegseth 公布新一轮国防采购改革,明确指出原有国防体系已难以应对新的战争形态,并宣布启动新的“作战采购系统”,以缩短交付周期、提升灵活性。

美国国防部试图引入硅谷的投资和迭代逻辑,重塑军备采购体系,让军队像科技公司一样快速试错、快速部署、快速扩张。

资本迅速跟进。今年 1 月,a16z 宣布新一轮募资超过 150 亿美元,其中明确投向国防科技领域的资金超过 11 亿美元。与此同时,a16z 还与美国陆军参谋长 CTO Alex Miller 和美国海军部 CTO Justin Fanelli 等美国军方要员共同推出播客和专栏,教初创企业如何拿下国防部订单。

以色列政府通过初创公司加速器计划 Innofense、增加对本土初创企业的采购额等,系统性地推动私营技术进入军事和安全体系。围绕这一政策环境,近几年集中涌现出一批专注国防科技的初创公司和投资机构,“Patriotism as a Service”成为了以色列创投圈的时髦概念。

类似的转向也正在欧洲发生。2024 年,欧盟投资银行放宽了对军民两用技术项目的投资限制,并参与设立规模约 1.75 亿欧元的国防股权基金,以吸引更多社会资本进入相关领域。《环球》杂志指出,这些政策为初创企业提供了关键的早期订单和市场入口;同时,在技术、市场、资本与战略因素的共振下,欧洲初创企业大力进军军工产业,欧洲军工创业投资正迎来爆发式增长。

世界正处这样的时刻:AI 的能力已被大规模引入战争中最敏感的场景,而大型科技公司缺乏主动约束自身的动力;本应推动规则协调与共识形成的国际组织,在关键议题上的作用仍然有限。

伊朗现场,正在发生的 AI 信息战

一段“万人上街支持政府”的航拍视频,在 1 月 12 日突然刷屏社交平台。

画面中,伊朗记者坐在一架直升机敞开的舱门边,一边俯瞰地面“集会人群”,一边对着镜头解说:伊朗民众自发走上街头,支持本国政府,对抗美国和以色列的干预。

镜头掠过,整条街道被伊朗国旗铺满,整齐庞大的队伍,看上去就是一场“全民拥护政府”的壮观场面。

很快,这段视频就被贴上了另一个标签:AI 造假。

伊朗政策分析师 Behnam Gholipour 公开质疑画面真实性,并谴责这是人工智能生成的虚假信息。

有网民对画面细节提出质疑,并逐帧分析指出:记者坐在直升机舱门边,却未见任何安全防护;衣着与面部状态未呈现高速气流下的正常反应;手部动作存在异常形变;街道背景中还出现了已被烧毁的建筑……

质疑声越滚越大,IRIB 很快放出第二段“证据视频”:

画面里,记者坐在电脑前,播放完整的集会录像,试图证明,先前那段航拍并非伪造。

但马上有人发现新录像存在前后矛盾之处。

而另一张广泛流传的关于集会的图片,有眼尖网民放大画面,发现有人“长”在伊朗国旗上,上半身悬在空中,下半身则直接消失。

社交平台的评论画风逐渐一边倒,IRIB 不仅在用可疑的视频讲述“盛大集会”,还在用同样粗糙的方式掩盖伪造。

网民对伊朗官方的愤怒,很快堆积在评论区。

有人开始恶搞那位直升机记者,用各种 AI 工具生成新的“伪造视频”和恶搞图。“既然你用 AI 篡改现场,那我们就用 AI 把你变成梗。”这种“以梗对梗,以 AI 反制 AI”的创作,在社交平台上快速扩散。

AI 玩梗是“技术抵抗”和消解意义的一种方式。但以 AI 对抗 AI 终不是种解法。

非营利组织 WITNESS “技术威胁与机遇”项目副主任 Mahsa Alimardani 在网络欺骗、审查和监控领域有超过 15 年的研究经验。她在最近发表的文章《怀疑如何在伊朗成为一种武器》中指出:“AI 对信息的操纵,以及围绕这种操纵产生的怀疑,本身都会成为掩盖真相的工具。”(AI manipulation, and the very suspicion of it, serves those who have the most to hide.)

Mahsa Alimardani 回忆称,集会自 12 月 28 日爆发后仅数小时,伊朗当局相关账号就开始将抗议现场的真实影像贴上“AI 伪造”的标签。

一个典型案例发生在抗议爆发后的第二天:一段在德黑兰拍摄的低清视频中,一名抗议者坐在街道中央,面对安保力量。该事件已被多方核实确认属实。

但随着视频在网络上不断传播,出现了经过 AI 增强画质的版本。BBC 波斯语记者 Hossein Bastani 发布了这段清晰版视频,但未注意到其已被 AI 处理。支持伊朗官方的相关账号随即抓住这一点,将 AI 修图留下的痕迹当作“证据”,以此否定这张照片和其他抗议影像的真实性。

上图为低清原视频;下图为 AI 增强后的版本。Hossein Bastani 已就未注意到其 AI 增强特性而道歉。

Alimardani 认为,深度伪造让 AI 贴上“欺骗工具”的标签,但实际上很多常用的图片编辑工具都带有生成式 AI 的能力,公众很难分辨出哪一种是善意修图、哪一种是恶意伪造。正因为如此,伊朗不仅可以利用 AI 本身,还可以利用公众对 AI 的怀疑,把这种怀疑变成一种“加速剂”,进一步压制和否定抗议信息。

AI 如何改变现代战场

在战场中,AI 不仅影响人们理解战争,更近一步参与战争本身。

俄乌冲突与以伊冲突,为观察 AI 如何介入舆论战与实际作战提供了清晰案例。

欧盟资助的虚假信息意识与韧性项目团队(DARE),在调研俄乌冲突时的信息操纵时发现,相关舆论操纵活动已明显呈现出自动化、规模化特征。调查显示,水军账号不再主要依赖人工运营,而是借助 AI 工具批量生成虚假社交身份,并模拟真实用户的行为轨迹。

以 Meliorator 为代表的 AI 软件包,可以自动生成包含头像、兴趣与互动历史的账号资料,并通过技术手段规避平台的异常检测机制,使这些账号在短时间内融入正常的信息流。同时,AI 生成的图像与视频被用于构建情绪指向明确的叙事,削弱受众对信息真实性的判断能力。

这种变化在中东地区的冲突中表现得更加直观。

以伊冲突期间,一张“伊朗击落以色列 F-35 战斗机”的图片在社交平台迅速传播。图片中,一架喷气式战机坠毁在沙漠中,残骸周围挤满围观民众。这一画面一度让外界误以为伊朗在空中对抗中占据上风。

但图像本身的物理逻辑存在明显漏洞。现场人物与车辆比例失衡,沙地上也缺乏高速坠毁应有的冲击痕迹。

据澎湃新闻旗下事实核查栏目“澎湃明查”梳理,在 2025 年伊以冲突期间,基于 AI 生成的虚假视频和图像数量显著上升,规模甚至超过了俄乌冲突初期。

这些内容往往画面粗糙、叙事夸张,甚至直接截取自游戏画面,却频繁被用于“重构”战斗场景,成为信息战的重要组成部分。凡是包含武器、废墟或宗教符号的影像,都可能被抽离原有背景,重新拼接成一个看似连贯、实则失真的“中东战场”。

如果说舆论战主要作用于认知层面,那么从俄乌冲突开始,AI 已逐步进入直接参与作战的阶段,战场也成为 AI 技术快速试验和迭代的环境。

2025 年 6 月的“蛛网”行动,集中体现了 AI 与无人机系统结合后所展现出的作战能力。在这次行动中,乌克兰国家安全局策划并实施代号为“蛛网”的特种作战,出动约 150 架远程无人机,对俄罗斯境内 5 座空军基地发动袭击,损坏包括 Tu-160、Tu-22 和 Tu-95 在内的 41 架战机。乌方称俄方损失约 70 亿美元,而单架无人机的成本不足 1000 美元。

伴随技术升级,战争的参与结构也在发生变化。商用武器、AI 技术和军事需求的结合,正在塑造一个由政府和企业共同参与的作战生态。这一模式部署灵活、更新迅速,但相应的监管与约束机制尚未同步建立。

在这一过程中,私营商业科技公司开始进入更核心的位置。乌克兰在冲突中广泛使用由美国民用软件公司 Palantir 提供的信息分析系统,对多源战场数据进行整合与研判,为指挥决策提供支持。相关系统能够在短时间内处理光学影像、雷达数据与火力分布信息,从而提升行动效率。

Palantir 是由 PayPal 创始人 Peter Thiel 创立的国防科技公司,已经成为多国国防部的供应商。就在今年 1 月,Palantir 与乌克兰国防科技集群 Brave1 启动 Dataroom 项目。该平台允许工程师利用大量经实战验证的数据训练和测试 AI 模型,目标之一是开发新一代自主拦截无人机,使其在缺乏人工干预、且 GPS 与通信受干扰的环境下,仍能完成探测、分类与拦截任务。

科技企业正主动嵌入战争的运行机制之中。技术开始按市场与投资逻辑被快速设计、部署和迭代,战争由此进入一套新的商业-政治结构,对既有国际规则形成持续挤压。

当一段伪造影像就足以影响大规模公众判断,当低成本无人系统能够在复杂环境中自主锁定并打击高价值目标时,如何为 AI 的军事应用划定清晰边界,已成为无法回避的现实问题。

当科技、资本和政治形成 AI 联盟

正在美国和以色列发生的事情,为我们提供了一种更现实的视角:当科技公司、金融资本与国家安全机器深度绑定,战争的技术形态、节奏与激励机制都会随之改变。

一个共同趋势正在显现——私营科技公司再次被系统性地拉入国防体系核心。它们不再只是为军方提供工具的外包商,而是直接参与战争工具的设计、部署,甚至作战本身。

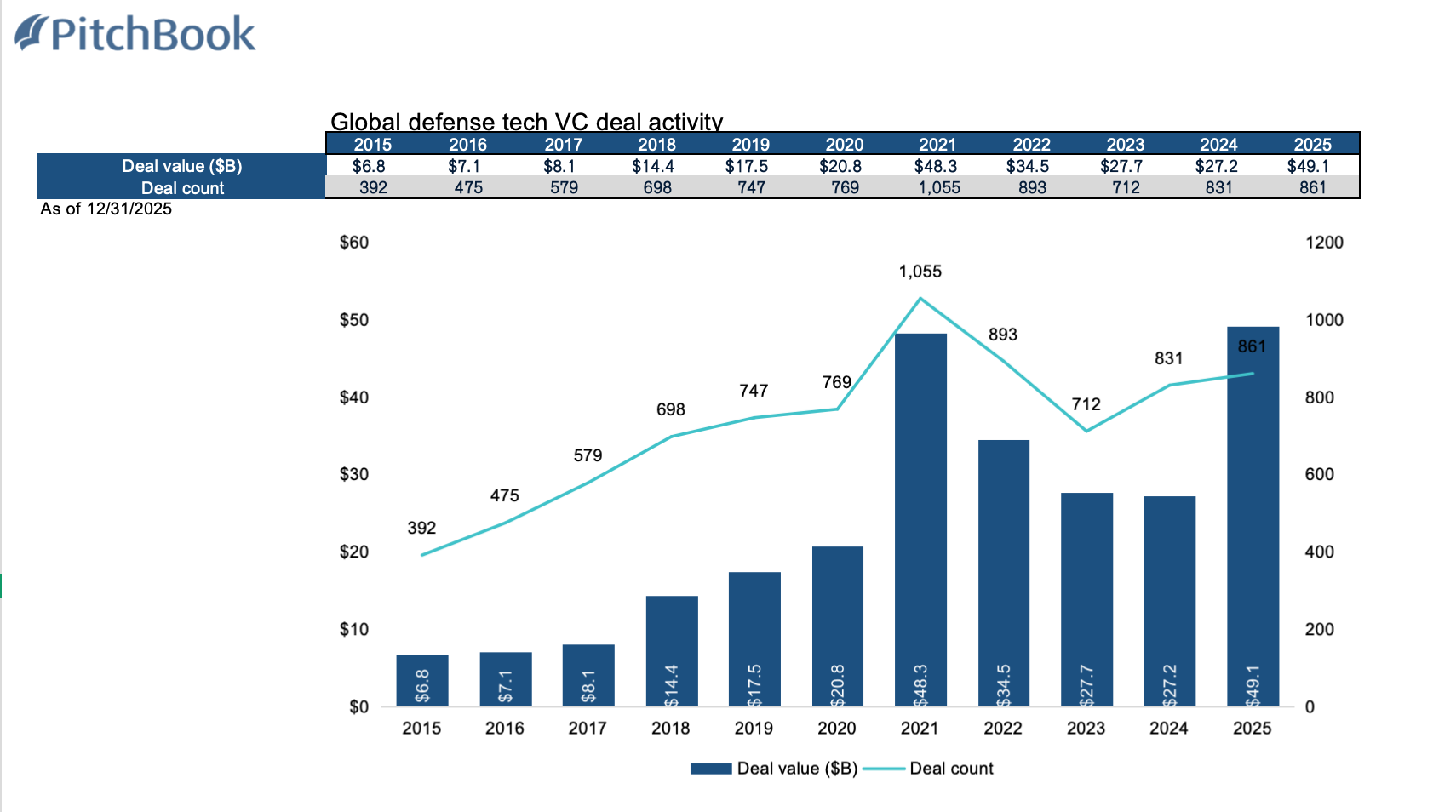

从资金流向上看,这并非零星现象。根据 PitchBook 数据,全球防务科技的风险投资在过去十年持续抬升,并在近两轮战争节点出现明显跃升。

无论是交易金额还是交易数量,在俄乌冲突、加沙战争这些时间点,“发战争财”都变得异常活跃。

硅谷回到五角大楼

在美国正在发生的事情是,硅谷与五角大楼关系的重新加温。

虽然硅谷的诞生与美国国防技术的发展息息相关,但过去二十年中,风险投资企业对国防科技的关注度,从未像今天如此之高。风险投资机构们纵使不出于道德考虑,也因为昂贵的硬件、未经证实的商业路径以及传统国防承包商的垄断,一直徘徊在五角大楼门外。

但这个平衡正在被打破。

一方面,政策环境发生变化。

特朗普通过一系列行政命令和《FoRGED 法案》等立法支持,对传统军工承包商施加严格的财务与绩效惩罚,同时大幅放松采购监管,以扶持高增长的科技企业。并推动一套得到两党支持的采购改革方案,核心逻辑只有一个:让军队像科技公司一样采购、迭代和部署技术。

2025 年 11 月 7 日,美国国防部长 Pete Hegseth 正式公布新一轮国防采购改革,目标是缩短装备交付周期,为长期僵化的采购体系引入更大的灵活性。在面向国防与科技行业高管的演讲中,他直言原有的“国防采购系统”已经走到尽头,并宣布启动全新的“作战采购系统”。

随后,五角大楼发布《采购转型战略》及配套指令,明确三项改革重点:一是整体转向作战采购体系;二是推进对外军售(FMS)与直接商业销售(DCS)的现代化;三是重塑联合需求审查流程。国防部释放出的信号十分明确——现有规则不再适配新的战争形态。

另一方面,资本明确进场。

就在今年 1 月 9 日,a16z宣布新一轮募资超过 150 亿美元,金额占 2025 年美国所有风险投资总额的 18% 以上。新基金的领域的金额包括: American Dynamism(11.76 亿美元)、Apps(17 亿美元)、Bio + Health(7 亿美元)、Infrastructure(17 亿美元)、Growth(67.5 亿美元)和其他风险投资策略(30 亿美元)。其中 “American Dynamism” 明确指向国防与国家安全相关产业。

在 a16z 的官网,你可以看到这样两行露骨的文字——

“a16z 致力于推动动态的国防科技改革,以重建美国的国防工业基础。以创新保障安全。是时候行动了。”

“美国——这个创新者和建设者的国度——已经因为官僚主义和中央计划而失去了国防工业基础。”

2025 年 6 月,美国陆军在官网宣布,正在组建第 201 分队“陆军高管级创新团”。来自 Meta、OpenAI、Palantir 和 Thinking Machines Lab 的 4 位高管,以高级顾问身份兼职宣誓加入陆军预备役。陆军在公告中表示,通过引入私营领域的专业能力,第 201 分队正为包括陆军转型计划在内的多个项目提供支持,目标是让军队变得更加精简、智能和高效。

2025 年 6 月 13 日,美国陆军参谋长 Randy A. George 为四名新任美国陆军中校主持宣誓就职仪式。

Randy A. George 对面从左至右分别是 Meta 首席技术官 Andrew Bosworth、Thinking Machines Lab 顾问和 OpenAI 前首席研究官 Bob McGrew、Palantir 首席技术官 Shyam Sankar、OpenAI for Science 副总裁 Kevin Weil。

硅谷不再只是为战争“提供工具”,也开始参与战争体系的设计。

从金融到科技公司,以色列的“全民皆兵”模式

相比美国,以色列并不缺乏军队和科技企业融合的历史,大量科技公司,如 Palo Alto Networks、Wix 的创始人都来自 8200 情报部队。8200 情报部队的退伍军人还组成了非盈利组织“8200 校友”,为青少年提供编程培训、为创业公司提供服务。

但真正的变化起源于 2019 年之后。当时,以色列前参谋长 Aviv Kochavi 发起了 Tnufa 五年计划,旨在将以色列国防军(IDF)转型为一支更致命、数字化的多域作战力量。与此同时,以色列国防部(IMoD)、研发局(MAFAT)与民间机构合作成立初创企业加速器 Innofense,寻找和集成能够改变战场游戏规则的军民两用技术,并为企业提供早期资金支持,加速其产品化进程。

在 2023 年的 10/7 事件后,虽然 Tnufa 计划宣告破产,但以 Innofense 为代表的军队与初创公司合作的模式被保留下来。除 Innofense 之外,以色列政府和军队还大力推进“绿色通道计划”(Green Lane Track),为初创企业和年收入不超过 2500 万新谢克尔 (NIS) 的小型公司提供精简流程,使其能够注册成为国防部的正式供应商。结果是,与标准国防采购相比,该通道大幅缩短了反馈响应时间,并放宽了合同条件,为初创企业简化了采购流程。

10/7 事件,是指 2023 年 10 月 7 日,在哈马斯袭击以色列之初,从加沙地带潜入以色列的哈马斯武装分子对在雷姆基布兹附近参加诺瓦音乐节的平民发动大屠杀。这个事件被认为是以色列的“911”。

上文提到的 Tnufa 计划中,以色列军队为了追求“高效、灵活”削减了一些传统的地面部队规模,导致以色列边境常规驻军过少且缺乏随时可用的预备役动员方案,增援部队花费了数小时甚至十数小时才到达受袭社区。2026 年,现任以色列国防军总参谋长 Eyal Zamir 宣布了新的多年计划 Hoshen,以替代 Tnufa。

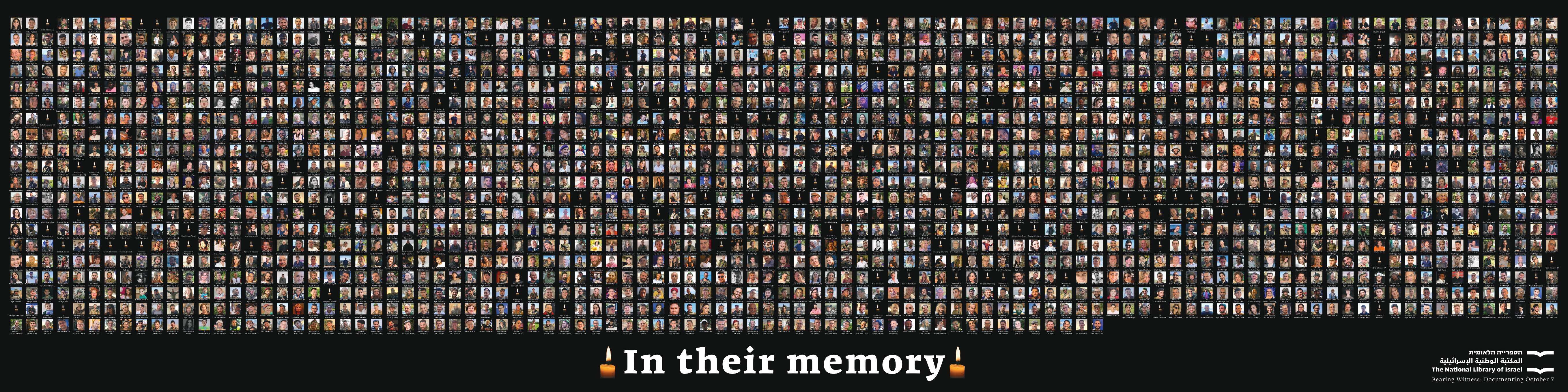

图片为以色列国家图书馆推出的“10 月 7 日纪念墙”,展示了 2023 年 10 月 7 日以来遇难的平民、以色列国防军士兵的照片和姓名。

根据公开信息,截止 2025 年 12 月,以色列国防部与超过 300 家初创公司合作,其中三分之一直接参与战争相关项目,大多为军民两用技术。

10/7 事件也直接影响了许多以色列金融和科技经营的投资和创业逻辑。

“过去 18 到 24 个月内成立的这批国防科技初创公司,绝大多数都是在‘10/7’事件之后才诞生的。它们源于真实的军事需求、作战需求,甚至是个人切肤之痛,并且已经经过实战验证、正在发挥作用。”Aurelius Capital 创始人 Alon Lifshitz 在最近的对谈播客中表示。

成立于 2024 年的 Kela 是这一代公司的代表。其目标是“帮助西方防务体系快速、无缝整合商业与军事系统”,已从红杉资本、Lux Capital 以及 In-Q-Tel 筹集 1 亿美元资金,最新一轮估值约 2 亿美元。值得一提的是,In-Q-Tel 虽为非盈利机构,其资金却来自 CIA ,它也是 Palantir 的早期投资者。

Aurelius Capital 则代表了这批公司背后,以色列投资机构的新风向。它成立于 2025 年 1 月,专注以色列国防领域投资,目前已经完成首轮约 5000 万美元的募资。 创始人 Alon Lifshitz 曾经在采访中表示,他此前创立的 Haneco Venture 因 LP 限制无法涉足国防领域,而 10/7 事件直接促使他与妻子另起炉灶,成立一家明确服务于国防方向的新基金。

这种转向甚至开始被包装为一种“以色列爱国主义”投资叙事。

在以往频繁讨论 Platform as a Service、Model as a Service 的以色列投资界,出现了“Patriotism as a Service”的说法。以色列风投机构 TLV Partners 在 10/7 事件后公开提出这一理念,并表示国防领域将成为其投资生态的重要部分。 TLV Partners 投资的 AI 视觉识别公司 Airis Labs,试图将日常数字影像转化为可直接用于任务的情报资产,服务于国家安全、公共安全、边境管理和应急响应等场景。

Airis Labs 在官网介绍,传统情报工具并非为去中心化、多模态的信息环境而设计,而以色列的对手正日益利用用户生成内容进行协调、招募和传播。借助 Airis Labs 的 User-Generated Field Intelligence,任何来源的媒体内容都可以被转化为可计算、可调用的情报资产。短短几句的描述,已经为我们勾勒出一个《疑犯追踪》中大规模、定制化监控系统。

从资金规模看,以色列国防相关部门和公司的合作已经具有明显规模效应。

根据多方公开信息梳理,与以色列国防部研发局(MAFAT)合作的国防科技初创企业,在 2025 年通过融资和并购已吸引超过 10 亿美元资金。报道同时指出,2024 年虽然也是国防领域融资金额创纪录的一年,但全年融资规模仅约 1.5 亿美元;在 2025 年之前,该领域初创企业历年来累计融资总额约为 4.22 亿美元。

很多人可能已经忘了互联网开始于军用网络。而今天这些科技公司、金融资本与国家安全机器在“国防”领域的合作,无疑都在提醒我们,一个把科技当作美好创新代表的时代已经结束了。

这正是我们今天讨论 AI 治理,无法回避的现实背景。

失效的 AI 治理

今天,AI 治理正同时经历着道德共识、国际机制与企业自律的三重失效。

来自 AI 行业引领者的警告一直从未缺席。

2025 年 10 月,非营利组织未来生命研究所发起了《针对超级智能的联合声明》,包括人工智能先驱杰弗里·辛顿、苹果公司联合创始人史蒂夫·沃兹尼亚克等多位知名人士参与签署。

但这份声明没有激起什么讨论的水花。

也许你还记得 2023 年 3 月,科技界曾发起《要求暂停更强模型训练的公开信》,呼吁所有人工智能实验室立即暂停训练比 GPT‑4 更强大的模型,暂停时间至少 6 个月,并建议在企业不配合的情况下由政府强制介入。结果是,没有任何一家关键公司或实验室真正停下,包括签署公开信的埃隆·马斯克本人。2023 年 11 月,xAI 正式推出 Grok‑1 的抢先体验版本——很难相信这是一场“暂停”之后的产物。

杰弗里·辛顿频繁公开演讲、不断签署声明,但这些努力并未改变产业的集体行动方向,并未改变和他一样的聪明头脑。

这些公开信之后的“缺乏行动”无疑反映出,大型科技公司缺乏主动约束自身的动力,行业内部也未能形成真正可执行的治理共识。

如果说道德呼吁无法转化为行动,本应承担“共识塑造”与规则协调角色的国际组织,同样未能填补这一真空。

军事领域负责任人工智能峰会(REAIM),是少数能够聚集全球近一半国家和地区代表,专门讨论军事人工智能治理的国际平台。2024 年,该峰会形成了一份“行动蓝图”,提出了关于“负责任使用军事人工智能”的最低共识,例如强调人工智能应用应符合伦理、以人为本,人类仍需对人工智能的开发和使用承担责任;同时明确指出,人工智能技术应接受法律审查,并遵循包括国际人道主义法和国际人权法在内的适用国际法框架。

但即便是这样一份最低限度的原则文件,在会议期间仍未获得完全认可,约有 30 个政府代表拒绝接受相关表述。

直到 2025 年 8 月,联合国才正式设立具备明确职能和常设架构的 AI 治理机制,包括“人工智能独立国际科学专家组”和“全球人工智能治理对话平台”。

但这份好不容易到来的“治理机制”并不试图建立一套具有强制力的普适规则,而是强调在部分议题上促进协调与共识,同时有意避开高度敏感的领域。尤其值得注意的是,独立政策研究机构 Chatham House 观察到,人工智能在军事领域的应用,被明确排除在联合国讨论议程之外,这也直接引发了对“军民两用技术”将如何被监管的广泛疑虑。

在国际治理尚未就 AI 在军事中的应用达成广泛共识之前,AI 企业自身已率先调整了边界。

2024 年 1 月,OpenAI 在其服务条款中删除了明确禁止人工智能用于“军事和战争”应用的条款,转而采用更模糊的措辞,要求用户不应“利用我们的服务伤害自己或他人”,包括“研发或使用武器”。

同年 11 月,Meta 宣布将向政府机构提供其 Llama 生成式人工智能模型用于“国家安全应用”,并与国防承包商 Anduril 合作,开发军用 AR/VR 头戴设备和训练系统。TechRadar 评论称,这一行动与 Llama 之前的可接受使用政策存在显著差异——该政策原本禁止模型用于“军事、战争、核工业或间谍活动”,并明确禁止武器开发和宣扬暴力。

2025 年,Google 修改《AI 原则》,删除“不开发武器”“不用于监视”等明确限制条款,转而采用更模糊的表述,强调技术应用需服务于“国家安全、民主与防卫”。这打破了 2018 年谷歌的承诺。当时 Google 因参与五角大楼 Project Maven 项目引发员工抗议,随后发布《AI 原则》,明确承诺不将技术用于武器开发或特定监控用途。

伦敦国王大学讲师 Nick Srnicek 在其新书《硅谷帝国:人工智能的未来之争》中,描述了 AI 巨头们卷入美国军事行动的故事。

他观察到 ,科技巨头正借助“竞争威胁”的叙事抵制监管,并与国家安全体系深度绑定。

过去几年中,关键人物的立场已发生明显转变:Sam Altman 从呼吁中美合作,转向强调“美国领导的志同道合国家联盟”;Anthropic 首席执行官 Dario Amodei 也从担忧竞赛风险,转向主张美国必须在 AI 竞争中取胜。

Srnicek 总结,这标志着“硅谷共识”的瓦解——曾以全球化与开放为目标的技术秩序,正在被技术民族主义和阵营对抗取代。

投资机构以及进入“国防”领域的初创公司,则进一步借助“安全困境”理论为自身行为提供正当性。

国防科技公司 Anduril 与投资机构 Founders Fund 的创始人 Trae Stephens 曾发表过一篇广为流传的文章《国防科技发展的伦理:一个投资者的视角》,为私企和资本加大对“国防”技术的投入“正名”。这篇文章的核心观点是,战争应当是“万不得已的最后手段”,对国防技术的投资恰恰是为了避免和慑止战争。

与此同时,他强调更高科技的武器有可能带来更少的伤害:高度精确、由 AI 驱动的打击手段,有可能减少无辜平民的伤亡,并降低大规模、无差别攻击发生的概率。

是的,技术有可能做到这一点。

但现实是,“精准打击”往往不顾及平民伤亡。根据冲突检测机构 Airwars,2023 年 10 月,以色列通过 AI 赋能的监听技术锁定哈马斯指挥官 Ibrahim Biari 后,对他所在地区展开空袭,袭击中超过 125 名平民丧生。

当这群世界上“最聪明”“最有野心”的人聚集在一起,不断提高武器创新和部署的效率时,很难相信“威慑”仍是他们唯一的动机——当从战争中公开获利变得越来越容易,又有什么理由真正去阻止战争的发生?