Cloudflare 通过发布由Code Mode驱动的全新模型上下文(Model Context Protocol,MCP)服务器,显著降低了与其完整API平台交互的成本,这代表了 AI 智能体访问复杂 API 方式的一次重要演进。这一新方法也展示了 MCP 生态中智能体与工具集成的新路径。

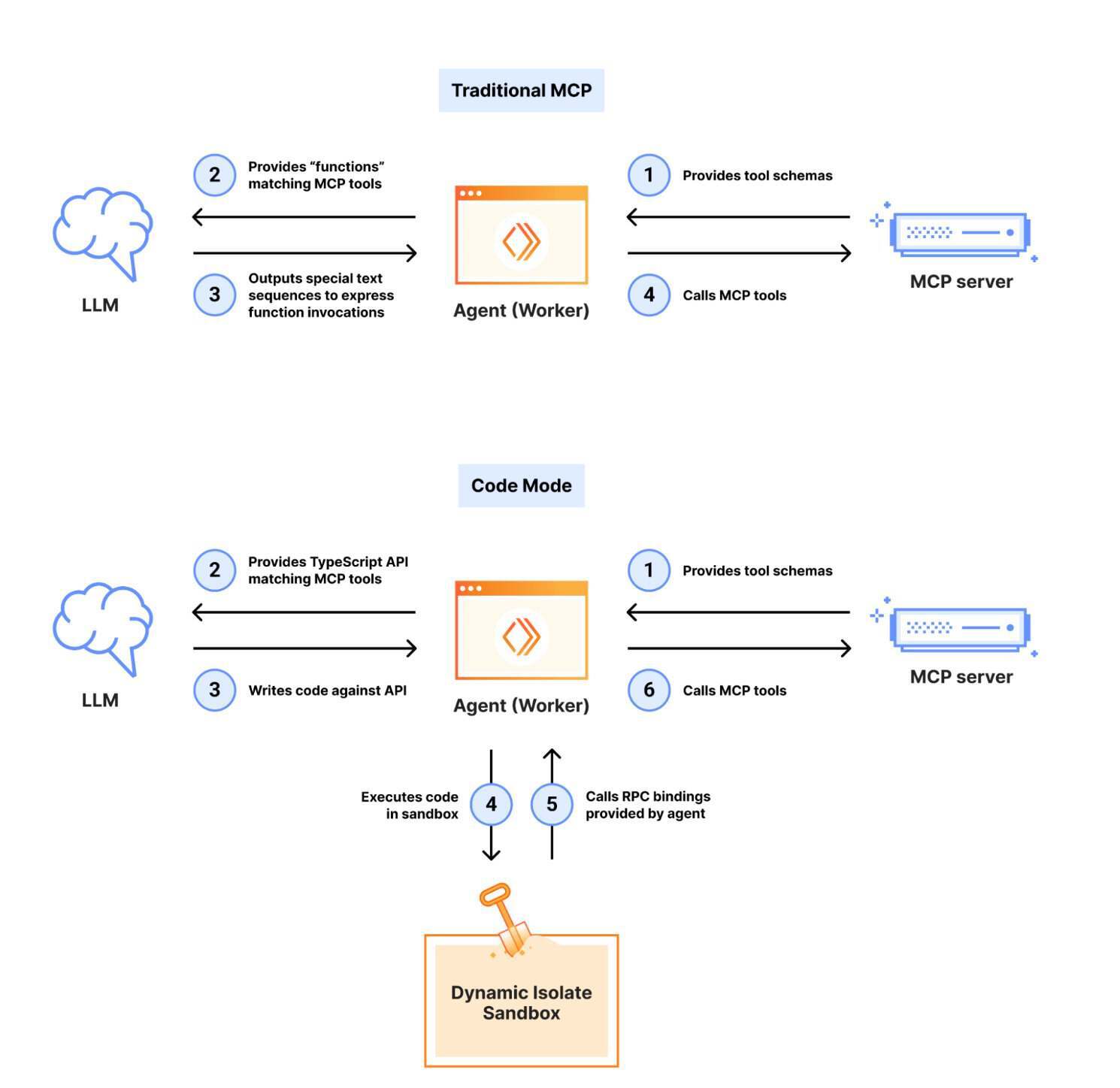

MCP 本质上是一项新兴的标准,它通过暴露结构化的工具,让大语言模型(LLM)在执行期间能够调用这些工具并与外部工具和 API 交互。传统做法中,暴露给智能体的每个 API 端点都对应一个独立的工具定义。该模型虽然简单直接,但每次工具规范占用模型有限输入预算中的 Token 时,都会带来显著的上下文窗口成本,从而压缩模型用于推理用户任务的空间。

Cloudflare 解决方案工程师Luuk Hofman表示:

所以,我们尝试了一种新的方式:把 MCP 工具转换成 TypeScript API,然后直接让 LLM 基于它编写代码。

Cloudflare 的Code Mode只暴露了两个工具:search()和execute()。其底层是具备类型感知能力的 SDK,允许模型在安全的 V8 isolate 中生成并执行 JavaScript 代码。这样可将智能体的计划编译成一个小型代码片段,在 OpenAPI 规范上编排多个操作,避免把所有端点定义都加载到上下文中。

传统 MCP 与 Cloudflare Code Mode 对比(来源:Cloudflare博客)

实际效果非常明显。Cloudflare 表示,Code Mode 将访问 2500 多个 API 端点的 Token 占用从超过 117 万 Token 降至约 1000Token,降幅约 99.9%。这种固定占用与 API 规模无关,使智能体能够在大型、功能丰富的平台上工作,而不会耗尽模型上下文。

Cloudflare 在 Reddit 的一篇帖子中强调:

团队采用了专门的编码策略,在不损失功能精度的前提下,将庞大的 API schema 压缩到极小的上下文窗口中。

智能体首先使用 search()按产品域、路径或元数据查询 OpenAPI 规范,规范本身不会进入模型上下文。随后,execute()在一次循环中运行处理分页、条件逻辑和链式 API 调用的代码,减少往返开销。

Cloudflare 还强调了执行阶段的安全性与沙箱模型。服务器在 Dynamic Worker isolate 中运行用户生成代码,不提供文件系统、不暴露环境变量,并通过显式处理器控制出站请求。该设计在保持智能体自主性的同时,降低了执行不受信任代码相关的风险。

这个面向 Cloudflare 全量 API 的新 MCP 服务器目前已覆盖 DNS、Zero Trust、Workers 和 R2 服务,并且可以立即集成。Cloudflare 还在其更广泛的 Agents SDK 中开源了 Code Mode SDK,以便第三方 MCP 实现采用类似的模式。

分析师和实践者认为,Code Mode 是推动智能体工作流从简单的单服务交互迈向更广泛的多 API 自动化扩展的关键一步。随着行业持续应对生产级 AI 智能体中的上下文成本和编排复杂度,这一模式可能在未来一年影响 MCP 标准服务器设计与智能体框架。

原文链接:

Cloudflare Launches Code Mode MCP Server to Optimize Token Usage for AI Agents