在 AI 原生开发时代,模型能力快速增长,但系统风险也呈非线性膨胀。如何在释放 AI 生产力的同时保持核心资产安全、控制复杂度,是每个工程团队必须面对的关键问题。本文提出“棒棒糖模型 + 螺旋演化”的分层安全架构,将人的操作、Guard 约束、测试计划与 AI 能力层级有机结合:

棒棒糖模型:核心资产是糖头,人的操作路径是棒身,贯穿系统各层,形成可控连接;AI 能力和外部工具是一层层糖衣,其能力释放受棒身约束。

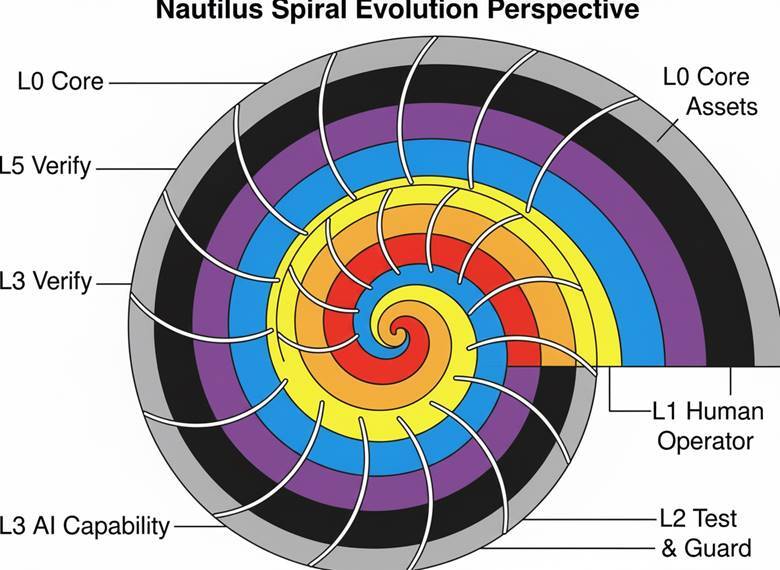

螺旋演化:随着版本迭代和功能扩展,规则密度、测试覆盖率和异常处理能力沿螺旋递增,实现系统随时间动态可控。

这种设计不仅提供静态安全边界,也兼顾系统长期演化风险,确保 AI 能力在复杂环境中被安全、可验证地释放。本文将详细介绍 L0–L6 分层架构、Guard Layer 模块化、单人模式落地实践,以及动态自愈与监控机制,提供可落地的 AI 安全工程方案参考。

1 引言

在 AI 原生开发时代,模型能力迅速增强,但系统风险呈非线性上升。传统架构往往将 AI 置于系统核心,而忽视以下问题:

核心资产边界

权限收敛机制

运行期行为漂移

成本失控路径

当 Agent 或模型出现异常时,损失可能具有放大性与不可逆性。本方案基于 TPDD(Test Plan Driven Development) 方法论,结合:

能力暴露(Capability Exposure)

禁止空间(Forbidden Zone)

Failure Thinking

Zero Trust 思维

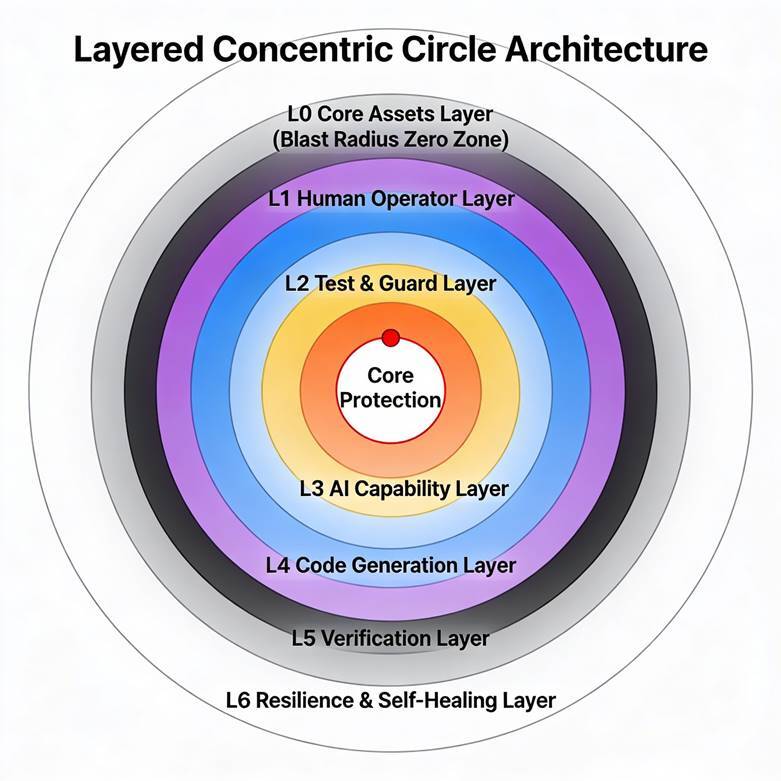

将 AI 系统安全抽象为分层圆 + 动态防御闭环,以在释放 AI 生产力的同时收敛失控风险。

核心原则

空间原则

越靠内层 → 资产价值越高 → 约束必须越强

越靠外层 → 不确定性越大 → 护栏必须越厚

控制权原则

系统核心是数据、权限与控制权

模型属于高风险计算外设,而非信任根

模型视角补充(静态 × 动态)

洋葱模型(Onion Model):刻画任一时刻的信任边界与权限分层(空间视角)

Nautilus Spiral 模型:刻画系统随时间的复杂度、测试密度与约束增长(时间视角)

二者关系:

横截面安全边界 → 洋葱模型

生命周期演化 → 螺旋模型

该组合可同时解决:

静态安全收敛

动态复杂度膨胀

AI 系统长期演化风险

2 分层同心圆架构(由内向外)

🔴 L0 核心资产层(Core Assets)【最内圈】

目标:绝对保护区(Blast Radius Zero Zone) 典型资产:公司数据库、用户隐私、商业机密、源代码仓库、内部高敏知识库、密钥 / Token / 凭证

约束原则:

❌ 默认 AI 不可直接访问

❌ 默认 Agent 不可持久触达

❌ 严禁长生命周期凭证

✅ 仅允许 JIT(Just-in-Time)短时授权

✅ 全链路审计可追溯

落地措施:

API Gateway + RBAC + ABAC 组合授权

KMS + 短期凭证轮换

行为基线异常检测

访问风险评分(risk scoring)

自动权限回收

🟠 L1 人员操作层(Human Operators)

目标:管理和约束人为操作风险 涉及角色:开发、QA、BA/PM、运维、数据分析、Prompt 编写者

主要风险:

Prompt Injection、误操作、权限滥用

社工攻击、敏感数据误粘贴

长上下文污染

工程化约束:

权限校验 + 全审计

高危操作双人确认

隔离执行环境

输入脱敏与 DLP

Prompt 风险评分

主动攻击演练与异常注入

说明:人的操作从最外层一直贯穿到最内层,就像 棒棒糖模型的棒身。

🟡 L2 测试与约束层(TPDD Guard Layer)⭐ 核心护城河

目标:将系统从“能跑”变为“可控”

Guard 架构:

Entry Guards(入口收敛)

Runtime Guards(运行时持续约束)

Shadow Guards(旁路监控)

模块职责:

Contract Guard:schema 校验、工具调用白名单、权限契约检查 → 防止能力误用

Invariant Guard:系统永真条件(不删除文件、不外发敏感数据、不越权访问) → 异常报警

Test Guard(TPDD 核心):边界测试、Failure 注入、对抗样本、回归测试、行为快照

Token / Cost Guard:context、steps、tool calls、成本限制 → 超额熔断策略、动态阈值与负载感知

落地措施:

自动化脚本执行 TPDD 测试计划并记录行为快照

异常行为触发内圈熔断、报警和自动回滚

多 Agent 调度系统联动实时限流

红队验证和主动攻击演练

🔵 L3 AI 能力外圈(Agent / Model Layer)

目标:能力释放层,风险最高 包含:LLM、Agent、Skills/Tools、RAG、多步规划、自动代码生成

工程认知:

外圈不应被完全信任

假设可能犯错、被注入、产生幻觉、越界尝试、非线性成本

落地措施:

AI 执行必须经过 Guard Layer 审核

每次生成操作附带行为日志和审计记录

异常或超阈值行为自动熔断

动态阈值随负载和业务峰值调整

🟣 L4 代码生成层(AI + 人工生成代码)

职责:统一管理 AI 与人工生成代码

自动化回归测试与静态分析

动态安全测试与代码审核

依赖分析与冲突检测

多 Agent 并行生成调度与隔离

生成代码附带行为快照和版本追踪

⚫ L5 验证层(Verification Mesh)

系统级裁决层,三阶段验证:

生成前(静态风险预判)

生成中(运行监控)

生成后(功能 / 性能 / 安全验证)

职责:

功能安全验证、性能压测、异常检测

红队演练、非线性攻击模拟

发布阻断权归该层

🧠 L6 自愈与韧性层(Resilience & Self-Healing Layer)

目标:维持系统收敛能力

Incident Learning Loop:事故归因、策略回放、Guard 规则调优

Policy Auto-Tuning:动态调整阈值、限流、授权窗口

Self-Healing Flow:会话隔离、权限收缩、Agent 降级、沙盒重启、状态回滚

Guard 健康监控:持续监测漏检率、延迟、旁路风险

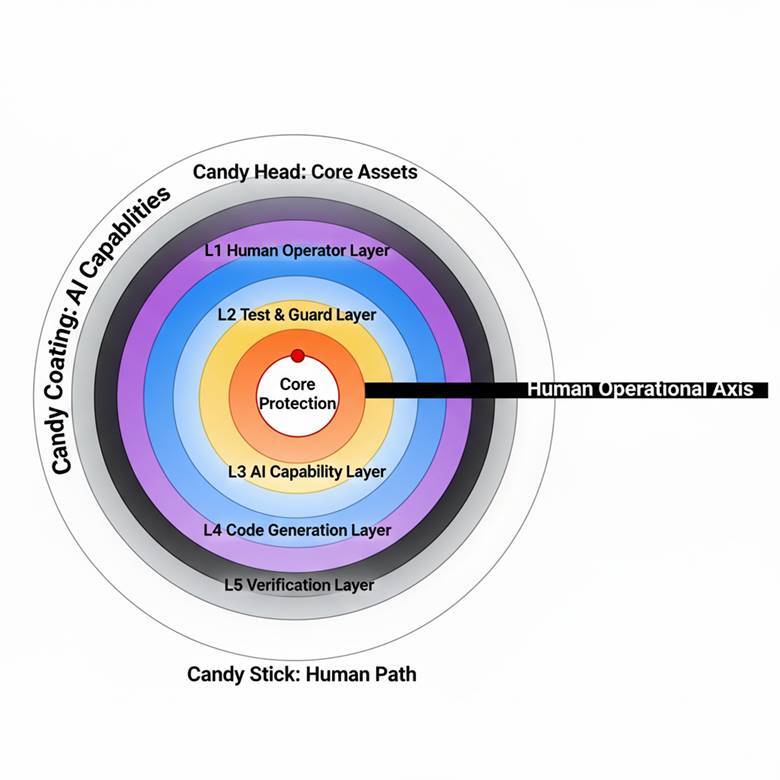

3 人的角色:贯穿全局的操作轴(棒棒糖模型)

人在 AI 安全架构中,不仅是使用者,更是安全闭环的中枢轴,贯穿 输入 → 约束 → 执行 → 验证 → 自愈:

L0 核心资产层:临时访问、JIT 授权、审计触发

L1 人员操作层:Prompt 编写、运维操作、敏感数据处理

L2 测试与约束层:执行 Contract / Invariant Guard、TPDD 测试计划

L3 AI 能力外圈:Agent / LLM 调用的审计、行为评分、异常触发

L4 代码生成层:生成代码回顾、版本追踪、多 Agent 隔离

L5 验证层:功能/性能/安全验证、红队演练、异常阻断

L6 自愈与韧性层:异常触发回滚、会话隔离、Agent 降级

可视化比喻:

棒头(Candy Head):核心资产,保护最严格

棒身(Candy Stick):人的操作路径,贯穿各层,形成受控连接

糖衣(Candy Coating):AI 能力和外部工具,能力释放受棒身控制

动态演化(螺旋/TPDD):沿棒身逐步增加规则密度、测试覆盖率和异常处理能力,实现系统随时间持续安全可控

通过这一设计,人的操作持续校准 Guard、TPDD 测试和异常监控,使 AI 能力在复杂系统中安全释放,同时保持核心资产的高度保护。

4 Nautilus Spiral 演化视角(动态复杂度增强)

同心圆模型刻画任意时刻的静态信任边界与权限层级,明确“当前可以访问什么、不能访问什么”,棒棒糖模型加入了人类可以介入的视角。

AI 系统随版本迭代、功能扩展而成长,代码量、复杂度和行为多样性逐步外扩,仅依赖静态洋葱无法完整描述长期演化风险。

螺旋模型要点:

螺旋对应版本沉积,每圈螺旋代表一次版本迭代

外圈规模更大、复杂度更高,但结构与内圈一致

动态规则与测试密度递增,Guard 规则、Failure 注入、监控指标随版本增长

TPDD 测试计划自动联动,覆盖率提升、异常注入增强

指标化落地:

测试密度(tests / KLOC)随版本递增

Guard 覆盖率逐步细化、自动化执行

行为异常率实时监控、阈值动态调整

Token / Cost 消耗斜率、风险评分动态计算

静态 + 动态结合:

同心圆:回答“当前边界在哪里”

Nautilus Spiral:回答“随时间边界如何膨胀、规则如何增强”

通过结合,两者确保系统长期安全可控。

5 安全执行流推荐路径(受控闭环)

Human / User

↓

L2 Entry Guards(Contract / Invariant / Token / Cost)

↓

Agent / Model (L3)

↕ 多轮受控交互

L2 Runtime Guards(Contract / Invariant / Cost)

↓

Code Generation Layer (L4)

↓

Verification Mesh (L5)

↓

Core Assets (L0, JIT 授权)

↓

L6 Resilience Loop

禁止路径:

User → Agent → DB

Agent → 高权限 Tool(无审计)

AI → 长生命周期凭证

关键工程语义:

Guard 双阶段:Entry + Runtime → 防止“一次放行,全程裸奔”

执行流受控,Agent 持续接受约束与异常监控

Verification 分布三阶段 → 目标尽早失败

Core Assets 默认不可达,临时授权、自动过期、全链路审计

6 OPC / 单人模式小型团队改进方案

核心目标:

单人或小团队环境,实现可控、安全闭环

阻止越界操作、实时监控异常、自动回滚、沙盒隔离、精细化成本/Token 管理

改进措施:

沙盒化执行:完全隔离、会话隔离、JIT Token、自动回滚、状态快照

自动化 Contract / Invariant Guard:契约检查 + Invariant 监控 + 规则自动升级

行为异常评分与阈值触发:异常评分、滑动窗口、自适应阈值

Token / Cost 精细化管理:按操作类型、上下文动态调整、超阈值自动熔断

简化自愈机制:会话隔离、沙盒重启、权限收缩、状态回滚

渐进式开发与定期 Review:每日/每周复盘 TPDD 测试计划、日志和 Guard 效能

核心架构:

Human / User

↓

L2 Entry Guards

↓

Agent / Model 执行层(沙盒 + 异常评分 + Token/Cost 精细化)

↓

L4 Code Generation Layer(自动回滚 + 多 Agent 隔离)

↓

L5 Verification Mesh(静态/动态/功能/性能验证)

↓

Core Assets / L0(JIT 授权 + 全链路审计)

↓

L6 Resilience & Self-Healing

7 整合三者

横截面:洋葱 → 当前边界

人的操作:棒棒糖 → 贯穿层级

纵向演化:螺旋 → 动态复杂度和规则增长

总结三者关系:静态 + 操作 + 动态 → 安全闭环

总结

核心资产永远在内圈,模型能力在外圈受控释放

Guard Layer 模块化、动态化、可反馈,是系统安全核心

单人模式仍可落地,但依赖最小可行安全套件

能力暴露 + 禁止空间 + Failure Thinking 架构落地,为 AI 工程提供可控、可验证、可维护的实践方法

动态量化阈值、负载感知、红队演练是改进后的关键增强点

作者介绍:

臧嘉玮,资深软件验证工程师与技术布道者,AI 探索者,曾贡献 1000+ 条维基百科与百度百科条目。精通自动化测试、开发策略优化及前沿测试技术,致力于将复杂系统验证经验与 AI 应用转化为可复用实战洞察。曾任 IBM 测试顾问、Siemens EDA 核心测试与自动化工程师,同时是 TPDD(Test Plan-Driven Development)方法布道者。