Meta 报告称,通过一种即时(Just-in-Time,JiT)测试方法提升了软件质量。该方法在代码评审期间动态生成测试,而不是依赖长期存在、需要人工维护的测试套件。根据 Meta 的工程博客及相关研究,这一方法在 AI 辅助开发环境中将缺陷检测能力提升了约 4 倍。

这一转变源于代理式工作流的兴起,在这种工作流中,AI 系统越来越多地生成或修改大段代码。在这种环境下,传统测试套件面临更高的维护开销且效果下降,因为脆弱的断言和过时的覆盖率难以及时跟上快速变化。

正如 ICT 系统测试工程师 Ankit K. 所观察到的:

AI 生成代码和测试的速度已经超过了人类的维护能力,JiT 测试因此几乎成了必然选择。

JiT 测试通过在拉取请求阶段基于具体代码差异生成测试来解决这一问题。与静态验证不同,该系统会推断开发者意图,识别潜在的失效模式,并构建有针对性的测试,在存在回归问题时使其失败。它专注于捕获回归的测试——这些测试在提议的更改上失败,但在父版本上通过。这是通过一个结合大语言模型、程序分析和变异测试的流水线实现的,其中会注入合成缺陷以验证生成的测试是否能够检测到它们。

正如 Meta 研究科学家 Mark Harman 所指出的:

这项工作体现了一种根本性的转变:不再只是让现有测试更稳,而是转向去发现未来可能出现的问题。

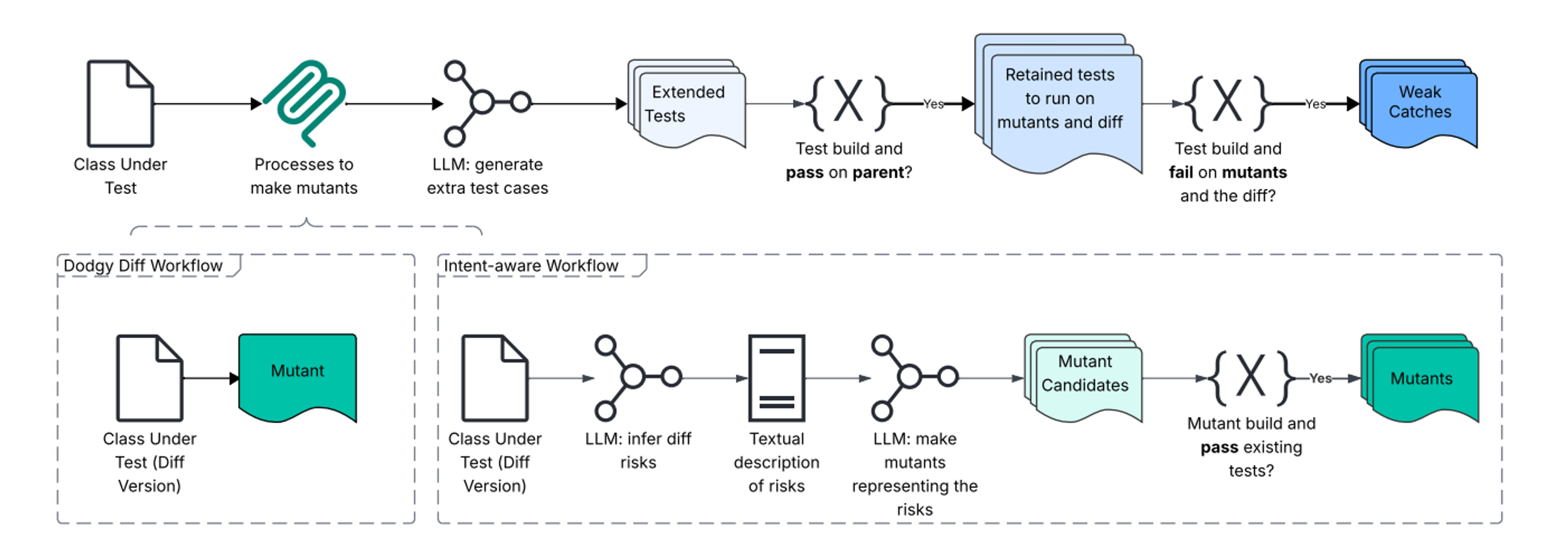

一个关键组件是 Dodgy Diff 与意图感知工作流架构,它将代码变更重新定义为语义信号,而非文本差异。系统会分析 diff,以提取行为意图和风险区域,然后执行意图重建和变更风险建模,以理解哪些内容可能因此而出错。这些信号被输入到变异引擎中,生成“可疑”的代码变体,用以模拟真实的失败场景。随后,一个基于 LLM 的测试合成层会生成与推断意图一致的测试,并通过过滤去除噪声或低价值测试,最终在拉取请求中呈现结果。

Dodgy diff 和意图感知工作流用于生成即时捕获(Just-in-Time Catches)的架构

Meta 表示,该系统在超过 22,000 个生成测试上进行了评估。结果显示,与基线生成测试相比,缺陷检测能力提升了 4 倍;与偶然结果相比,在检测有意义失败方面最高提升达 20 倍。在一个评估子集中,共识别出 41 个问题,其中 8 个被确认是真实缺陷,包括若干可能影响生产环境的问题。

Mark Harman 在另一篇 LinkedIn 帖子中强调:

变异测试在学术圈沉寂了几十年之后,终于开始走向工业界,并正在重塑实用且可扩展的软件测试 2.0。

捕获型 JiT 测试专为 AI 驱动的开发设计,按每次变更生成,用于在无需持续维护的情况下检测严重且意外的缺陷。它们通过随着代码演进自动适配并将工作从人类转移到机器,从而减少脆弱的测试套件。只有在发现有意义的问题时才需要人工审查。这将测试从静态正确性验证重新定义为面向特定变更的故障检测。

原文链接:

https://www.infoq.com/news/2026/04/meta-jit-testing-ai-detection/