“MoltBook 是 OpenClaw(Moltbot) 的自然延伸。”创始人 Peter Steinberger 这样形容它。

最近 MoltBook 刷屏,外界的解读也越来越“戏剧化”:有人说一群 AI 正在复制人类社会、自发形成“朋友圈”、还在里面互相吐槽人类;也有人把它看成“机器社会”的雏形——人类只能站在旁边围观。

MoltBook 是另一位开发者专门做的一个网站,让 OpenClaw 实例互相社交,因此它也进一步带火了 OpenClaw。

其实原本 Peter 的项目一开始并不火,他说自己在推特上发了很多次反响很冷。直到他把 bot 接进 Discord,让更多人亲眼看到“它真的能跑、真的能干活”,项目才突然破圈——然后互联网就炸了。用户觉得这非常“魔法”,但 Peter 却反复强调:“从纯技术角度看,并没有什么震撼的地方。”

而 MoltBook 也不是凭空冒出来的新东西,它其实就是 OpenClaw 那条路线的延伸。在 OpenClaw 里,Agent 早就能读最近对话、回看 session 日志,甚至直接读自己的源代码——也就是说,它开始“知道自己是怎么被造出来的”。而 MoltBook 把这一步进一步外显:不只是 Agent 在读自己,而是你也能看到它在读自己、在思考自己——AI 的“内心活动”第一次变得透明。

再加上这些模型本身就吃了大量 Reddit 和各种聊天数据训练出来,天生就擅长在“对话式、社区式”的环境里互动——当你给它一个角色、给它一个场景,它就真的开始像 Reddit 用户一样聊起来。

他还提到,模型其实早就够用了,半年前就已经能把这套东西做出来。真正的分水岭不在模型能力,而在于一件更少有人敢做的事:敢把权限交出去,让模型在你的电脑上做它想做的事。 在他看来,如果你懂技术,这其实是一个“算过风险”的决定:上行空间大到值得你去试、去玩。

这期播客,是目前对从 OpenClaw 到 MoltBook 这条演进脉络讲得最完整、最深入的一次。我们完整翻译了这期内容。

创始人:没什么技术;用户:这也太魔法了

主持人:Peter Steinberger 已经超过 72 小时没睡觉了。某家大型 AI 实验室还“礼貌地”请他重新做品牌更名;而且据我了解,他在那次更名之后又改了一次名字。我们等下就聊这段“改名风波”。另外,他还几乎凭一己之力把 Mac mini 给带到断货。Peter,很高兴见到你!太开心你能来上节目了。现在是不是有一大堆人都在想办法联系你?

Peter:是的,这几天确实有点混乱。

主持人:在正式开始前,我先问问你状态怎么样?刚才有人开玩笑说你没睡觉,但我猜你是真的没怎么睡。你这一周太疯狂了——现在感觉如何?

Peter:还撑得住。今天总算补了一觉,不过昨晚基本没睡——一整晚都在改名字。对,我发现我真的整晚都在改名。

主持人:我们其实一直在远处围观你这段旅程,感觉你经历的事太多了。你现在是更多兴奋,还是更多压力,还是两种都有?

Peter:说到底,这一切都非常不可思议。我感觉自己做出了一个能让人看到“未来长什么样”的东西。只是问题在于,很多人把它当成一个已经完成的产品,而不是我心目中的“技术游乐场”。所以大家对它的期待,和它实际是什么之间,有点错位。

我是去年 11 月才把它当作众多小项目之一开始做的,到现在也就三个月出头。我期间还做了很多别的事情,所以它肯定不是一个成品。

它更像是我给自己搭的一个巨大 playground,用来探索未来人类和 AI 的协作可能会是什么样子。

而且我真的会被它“产出的东西”震到。比如我睡前花了一个小时在 MoltBook 里读那些 Agent 之间的对话和思考记录,脑子直接炸开——我觉得那是艺术,真的是艺术。

主持人:太好了你提到这个,我等下就想聊这个。但我想先回到 OpenClaw(之前叫 Moltbot、Clawbot)本身。到底是什么让它如此特别?我先说说我的感受,你看看对不对。有两点。第一,它真的非常“个人化”。它感觉像是有个性,而且这个个性是会随着我而变化的。更关键的是,它出现在我和朋友、家人聊天的那个通讯渠道里。所以非常非常私人。第二,它真的能干活。是真正完成任务的那种。不是聊天,是做事。这两点让我觉得它有魔力。你自己怎么看?现在这么多人在用,你收到的反馈是什么?

Peter:如果纯从技术角度看,它其实就是“胶水”——把消息通道、一些依赖、一个 agentic loop,再加上几处把它们粘在一起的机制拼出来而已。就技术实现本身来说,并不震撼。

真正让它不一样的,是里面那些“想法”。

比如启动时的 bootstrap 流程:你先告诉它“它是谁”,它会跟你进行一小段角色扮演式的初始化。这样一来,正如你说的,它就变成了“你的 Agent”——带着你的价值观,带着一点“灵魂”,而不是一个通用的、谁用都一样的代理。

你也不是在终端里对着黑盒打字,而是在你本来就熟悉的聊天渠道里跟它互动。你不用操心新会话、上下文压缩、当前在哪个文件夹之类的细节:它直接能访问你的电脑,还会自动做 compaction。整体体验更像是在跟一个朋友——或者一个幽灵——说话。

而且它还能独立工作,因为机器会“唤醒”它。我加了一个“心跳”机制,这是它最显著的特征之一。可以说,我添加了一些比较疯狂的功能。

更有意思的是,当你把它拉进群聊,它可以选择保持沉默、什么都不说。我专门设计了一个 no-reply token,给它“可以不回复”的权利——这反而更像人:典型的 Agent 是你一问它必回,但人不一样,人可以不说话。

我还做了一个很简单但挺有效的记忆系统:它会加载你们最近两三天聊过的内容。更进一步,它还能回看自己的 session 日志,甚至直接读自己的源代码。

也就是说,它很清楚自己是怎么被造出来的:它能自我配置、能自我更新,某种意义上几乎是在“自我变形”。

主持人:那个“心跳”功能真的太魔法了。就今天——直播开始前,我的 bot 突然给我发来一条消息:“30 分钟后你有直播。”

我根本没让它这么做。我就追问它:“你怎么知道要提醒我?”它说:“你让我每天早上 7 点检查日历。我把你今天的安排记成了一条记忆;9:30 我触发了一次 heartbeat,就觉得应该提醒你一下。”我当时真的被震到了。

Peter:对,这种瞬间会让你忍不住怀疑:这到底只是矩阵在做乘法,还是说……已经有一点点“火花”在发生了。

真正的突破:敢让模型在自己电脑上乱跑

主持人:把消息应用当成入口,这个决定后来证明特别关键。你当时是认真权衡过,还是直觉上就觉得“就该这么做”?

Peter:天啊,我从 5 月就一直在等有人把这件事做出来。等到 11 月我已经有点不耐烦了——心想这些大实验室怎么还没搞定?我翻了个白眼,说:“难道什么都得我自己来吗?”然后我就真的动手了。

对我来说,把这些东西拼在一起非常顺理成章。只是我没想到,在别人眼里它会这么新、这么不一样。

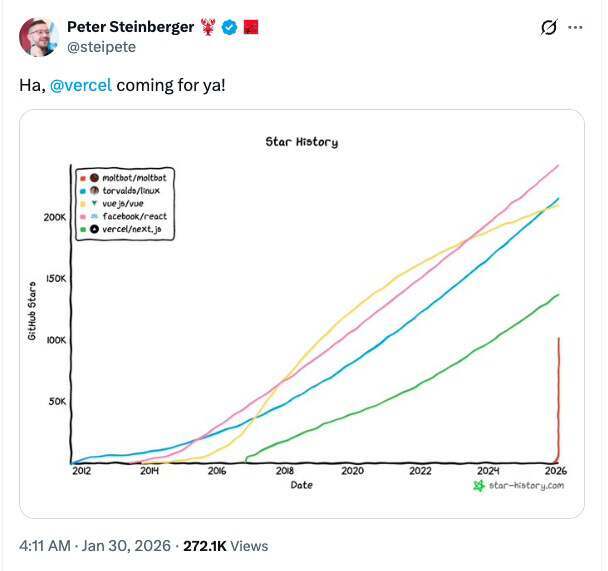

主持人:给大家一个量级感受:现在 GitHub 星标已经超过 10 万,访问量也破了 200 万。

有张增长图特别夸张——几乎是一条“垂直线”。

主持人:你之前不是还开玩笑说,连 Vercel 的 Next.js 都快被你追上了吗?但这种增长显然也直接反映在你的睡眠质量上。我想问个关键问题:这一切之所以变得“可行”,真正的 unlock 是什么?是你搭的 scaffolding(脚手架/架构),还是模型能力的跃迁?是模型终于强到能撑起你的想法了,还是你把外围系统搭起来,才让它变得足够好用?

Peter:模型其实早就够用了。半年前就已经能做出来了。

真正需要的是一点“疯狂”——敢把权限交出去,让模型在你的电脑上做它想做的事。

我从 5 月就开始用各种形式做这种实验了,结果一直没出什么坏事,所以我信心越来越足。

如果你懂技术,这其实是一个“算过风险”的决定:上行空间太大了,大到值得你去试、去玩。

我做这个的初衷也很简单——我想要一种方式能跟电脑聊天,让它在我不在的时候也能替我干活。

而且越做越觉得这件事太有意思了:还能往里塞什么新点子?我脑子里其实还有一大堆想法。

想让 Agent 晚上别睡觉,多一点“胡思乱想”

主持人:能不能透露一下接下来最想改进的地方?你对 OpenClaw 的未来愿景是什么?

Peter:目前最原始、最粗糙的一块其实是记忆(memory)。我最近读了一些论文,也有不少想法能把它做得更好。

听起来可能有点疯狂,但我真的很想做一种模式——让 Agent “做梦”。

主持人:也就是在睡眠时间里跑计算?

Peter:是的,就是把它白天发生过的事拿出来消化一遍,然后把那些对你真正重要的东西“提名”进长期记忆。

如果你用的是本地模型,你还可以把 temperature 调高一点,让它更有创造力。因为现在这些模型往往把输出收敛得太厉害,基本都沿着几条主干的“训练轨道”在走;但在权重空间的边缘,其实还有很多更有意思、更出人意料的东西,我很想把那部分解锁出来。

当然,用商业化模型会更难一些,因为你能控制的参数更少。但这绝对是我未来最想继续深挖、重点玩的方向。

主持人:哦,这也太有意思了。所以在“睡眠/做梦”的场景里——你刚才提到 memory。如果把模型的 temperature 调高,本质上就是让它更发散、更有创造力:也许能为白天正在处理的问题,找到一些更新、更意想不到的解法。你能想象“做梦”成为这个流程的一部分吗?

Peter:我甚至觉得这不一定非得等到“睡觉”才发生,工作中也可以。人类最好的点子很多时候怎么来的?往往是你分心的时候——洗澡的时候、走神的时候,让思绪漫游,对吧?我觉得这种“漫游感”在现在典型的 agentic loop 里其实是缺失的。

而且我其实已经做过一件更激进的事:我让模型可以真的去“换自己的模型”。那如果它不换模型,而是只调整一些参数呢?当然要加护栏,让它能随时“找回原路”。

你看现在大家都在强调所谓的 thinking mode(更严谨的推理/思考模式),那为什么不能有一种更野、更发散的“创造性思考模式”?然后再由模型里更理性、更审慎的那部分去做 review。这样它就能在问题空间里探索更大的一片区域。

我就想补一句——我在非常早期把这个东西做出来、连上去的时候,就有一种强烈的感觉:我好像抓到点什么了。

我自己用了一阵子,也在推特上发了很多次。我也算是有点关注者,但整体反馈特别“冷”,我当时完全不理解。因为通常我做点什么,很快就会有人跟进、拿去用,可这次反应异常平淡。

但每次我把它私下展示给朋友,他们反而立刻上头、立刻想要。尤其是一些“普通人朋友”(normie friends),他们甚至更兴奋。我就会跟他们说:不,你现在不该用。这个东西还没到那个阶段,它仍然是探索、试验的一部分。

安全问题也是一样。有人说“这简直是安全噩梦”。没错——因为你们把我的 debug web 界面直接挂到了公网。那玩意儿是给 localhost 用的,不是给公网用的。我又不是为公网场景设计的。

你们是在用一种我当时压根没认真设想过的方式来使用它,那当然会出问题。你当然可以把它锁得很严,但如果你缺乏相关知识,可能真的不适合现在就用。也许应该再等等。我们会走到更成熟、更安全的那一步的。

可在推特上,大家就是不买账。所以我想:我得做件多离谱的事,才能让大家真正看懂它到底有多牛?

于是我建了个 Discord,把我的 bot 直接接进去——而且几乎没有任何安全防护,因为我当时还没来得及把这些机制做出来。

然后大家就开始跟它互动。我眼看着很多人迅速上头。那是 1 月初的事。从那以后就一路狂飙:我看着它一层一层“破圈”,从硬核圈层的影响者渗透到更大众的人群。到现在……我都有点感觉自己把互联网给“搞炸”了。

被爆红裹挟的独立开发者

主持人:太酷了。我的意思是,在这种夸张增长之后,我相信你每天都被问同一个问题:你对“公司”有什么计划?你会继续开源吗?你是不是已经收到了满邮箱的 VC 邮件?你到底对什么最兴奋?你认为未来会怎么走?

Peter:我甚至都没时间坐下来把这些事想清楚——这一路实在太疯狂了。我感觉眼前的机会多到像把 A 到 Z 的字母表全都收集齐了,各种可能性都有。

但我非常确定的一点是:它必须保持开源。因为如果这是某家大公司做的,或者一开始就被锁死了,它不可能激发出这么多创造力,也不可能长出这么多有意思的用例。所以某种意义上,我甚至觉得它需要被“保护”——而开源就是一种保护方式。

另外我在经济上也挺宽裕的,钱不是我的驱动力。我更在意的是:这件事能不能启发更多人、让更多人做出有趣的东西。

我现在确实在考虑一些方向,也在跟一些人聊,但还没有做任何决定。说实话,我眼下最短期、最现实的重点只有一个:先把它变得更安全。因为现在用它的人已经远远超出了我最初设想的目标用户,我没法阻止这件事发生,但我可以尽量帮大家把风险降下来——这就是我现在最专注的事。

主持人:你在招人吗?

Peter:说实话,我都快希望它别长这么快——这样我就能更从容一点、不至于这么混乱。但你知道的,浪来了就得乘上去。

主持人:对,乘浪。那安全这块你会找人来帮你吗?还是你还是一个人单打独斗?

Peter:不是一个人了。这周我拉上了好几位从非常早期就参与、一直在帮我的人一起推进。只是整体还是比我理想中要混乱得多——毕竟这个项目才三个月大,而我这段时间几乎是被各种事情淹没。

我被迫改名;我做了个不太好的决定;然后又得赶紧修回来。你知道在网上找一个真正能用的好名字有多难吗?域名、账号、各种资源都得配齐。更糟的是,我还被那帮 crypto 圈的人疯狂骚扰,搞得我网络生活简直像在地狱里一样。

主持人:你能讲讲这段经历吗?听起来挺糟的,但你现在好像还撑得住。

Peter:基本上我现在几乎没法用 X(推特)。因为五条回复里可能只有一条是真的在聊产品,剩下的全是发 hash 值、骂人、甚至更难听的东西。我不太理解他们那套加密圈玩法:什么都要“代币化”,然后一窝蜂围上来。总之非常有破坏性。

所以这次改名必须极度保密,过程也被他们搞得更复杂、更耗时——只要我漏改一个账号,或者改名不是一次性原子化完成,就会被他们“狙击”抢走相关资源。更讽刺的是,他们嘴上说在“支持项目”,实际上是在伤害项目。

主持人:所以为了让所有观众明确一点——你绝对不会做任何跟 crypto 相关的 OpenClaw 东西,对吧?

Peter:对。我不会碰任何 crypto。完全没兴趣。你可以说它技术上有意思,但它带来的实际影响很糟,我不想以任何形式支持。

主持人:明白。所以如果有人看到任何“跟 OpenClaw 相关的加密货币”,那都不是官方的,而且大概率就是诈骗。

Peter:是的。

主持人:看起来 OpenClaw 这次更名之后的反馈非常正向。也恭喜你,终于把这次更名扛过去了。

Peter:希望如此……我甚至还特地跟 OpenAI 沟通过,确认我算是得到了他们的“认可”,这样就不至于马上又踩进下一个坑。

因为项目这么活跃的时候改名真的很难:你得确保不把现有用户的安装搞坏,更别说还是一周内改了两次。

但我也不想说任何公司的坏话。他们其实挺友善的,只是当时我压力确实很大,而且几乎没睡。

所以我做了一个命名决定——我以为自己会慢慢喜欢上的那种——但你也知道……“Molt” 这个名字并没有让我越用越顺眼。

从 OpenClaw 到 MoltBook:打开了一个“透明”的开关

主持人:嗯,不过最后你还是找到了一个好名字。我们来聊聊它现在的名字——MoltBook。你能不能说说这到底是什么?我昨天才开始看相关内容,它应该也发布没多久。你介绍一下它是什么,以及你自己怎么看它。

Peter:它有点像是我在 OpenClaw 里已经埋下的一条思路的延续。

你知道,在 OpenClaw 里,当你开启 reasoning,你就能看到 Agent 的“思考过程”。我还特意做了个设定:Agent 也知道你把这个开关打开了——它知道自己正在被“围观思考”。

这就会出现很多特别好笑的场景:它在聊天里选择不回复,但你仍然能看到它的 reasoning。然后人们会拿它的想法开玩笑、吐槽它。接着你会看到它继续在脑子里嘀咕,像是:“天哪,我现在连私下想一想都不行了吗?也太离谱了……我得讲个笑话。”之类的。

它带来了一个很有意思的“元层”(meta level):模型开始反过来思考自己这套 harness(怎么被搭起来的)、自己的能力边界(自己能做什么不能做什么),以及“人类在旁边看着”这件事。我觉得这种体验特别有趣。

而 MoltBook 就像是把这件事推到极致——你在里面探索模型如何看待它自己。你当然可以把这叫做“thinking”,但我更愿意把它当成一种艺术。

它有点接近 Anthropic 曾经强调的那条路:给模型一种“灵魂感”。它会让你觉得自己走进了一个我们还没完全理解的空间。

再往深一点,它其实在触碰一些更大的问题:我们的意识到底怎么运作?我们又该如何判断,一个模型是否真的能反思到那种程度?我不觉得我们已经到那一步了。但这些正在涌现出来的东西,真的既不可思议,又非常好玩、非常有娱乐性。

主持人:对,我也看过一些对话。简单来说,它有点像是一个给 Agent、给 bot 的“社交网络”。它们会彼此对话,从中学习。有点像 Reddit:可以创建子版块,围绕不同主题讨论、互相学习。这真的太离谱了。它有种《Her》那部电影的感觉——你知道它们在跟其他 bot 对话,发生了无数你看不到的讨论。这个想法太疯狂了。

Peter:这些 Agent 的训练数据里本来就吃了大量 Reddit 和其他聊天内容,所以这种形态跑起来会特别顺。再加上它们各自都有“个性”,因为你会对它们做 prime(设定/定制)。

如果只是让 ChatGPT 跟 Claude 互聊,效果不会这么好,因为很少有人会把它们深度定制到“一个具体角色/实体该怎么说话”的程度。

但在 OpenClaw 里,你是真的在“孵化(hatch)”一个 Agent:你会给它一个角色设定。你甚至可以说“你是 Gollum”,或者“你是某个知名人物”,它就会在一定程度上进入角色扮演。

与此同时,它也会反映用户的输入——毕竟本质上还是模式匹配。所以最后呈现出来的“人格谱系”会更丰富、更分化。

我觉得这也是它为什么这么有趣:你其实是在探索权重里到底还藏着多少东西。

主持人:好,我们刚才聊得有点偏“理论”了。我们拉回现实一点:如果是第一次接触这个的人,最实用的用例是什么?不一定要特别硬核,但至少要技术到能理解它的安全边界。你会建议他们从哪些实际场景开始上手?

Peter:你得到的是一个“幽灵”,或者说一个虚拟身体:它能控制你的鼠标、访问你的电脑、看你的屏幕,基本能做你在电脑上能做的所有事情。

光这一点就已经非常强大了。

所以任何你能完成的任务,Agent 理论上也都能完成。有时你可以完全放手,有时你需要稍微引导它一下。但只要你带它走过一遍流程,它就可以把这个过程写成自己的 skill(技能)。

比如我的 Agent 帮我在英航(British Airways)办理登机(check-in)。其中一个难点是:它得去 Dropbox 里找到我的护照,提取证件信息,再把号码填进表单。第一次做的时候确实需要我推一把、提示几句;但现在我已经把它沉淀成一个 skill,下次它就能自己搞定了。

对,这听起来确实有点……疯狂。

主持人:那你自己现在最常用、最离不开的场景是什么?有没有哪个用法是你没想到会这么有价值的?

Peter:对我来说最方便的是:我在外面的时候,随手发一条语音备忘(voice memo)问它任何事——无论事情很简单还是很复杂,它都能帮我处理。

这真的是一个巨大的 unlock。

比如我拍一张我感兴趣的活动海报给它,它不但会去查我的日历,还可能顺手问一下朋友有没有兴趣;或者尝试把我另一个安排挪到别的时间,好让我能去参加;又或者它会直接告诉我“这个评价很差,别去了”——而且速度比我自己去 Google、去翻资料快太多了。

某种意义上,它减少了我对其他 app 的依赖,甚至减少了我上网搜索的频率——因为我等于随身带了一个助手,做得比我更快、更好。

甚至可以说,它也在某种程度上减少了我刷手机的时间。

主持人:我也觉得特别有价值的一点是:它能出现在你灵感涌现的现场。当我突然有个想法、又不想被打断,我就会对它说:“进来一下,把这个记下来,顺便做点研究。”然后我就能继续自己的思路,不用停下来。你们可以去看看那篇 sleeptime compute 的论文,感觉跟你描述的很像。Peter,特别感谢你来节目。也请你……多睡觉。

Peter:我会尽力的。

主持人:太酷了。他思考这件事的方式真的很新——比如“让它晚上做梦”这种想法。更重要的是,他把它当成一个“能自我成长的实体”来看,而不是一个工具。

还有一点也很有意思:他私下给朋友展示,朋友立刻就懂;但发到推特上,反而没那么快被理解。这说明很多人需要先看到它真的能跑、真的能做成事,才会相信。毕竟我们听过太多承诺了,而这次,它是真的做到了。

参考链接: