谷歌发布首个原生多模态嵌入模型

昨夜,谷歌宣布推出全新的多模态嵌入模型 Gemini Embedding 2,这是首个基于 Gemini 架构构建的原生多模态嵌入模型。目前,该模型已经通过 Gemini API 和 Vertex AI 向开发者提供公开预览。

与此前仅支持文本向量化的嵌入模型不同,Gemini Embedding 2 可以将文本、图像、视频、音频以及文档等多种数据类型映射到同一个统一的嵌入空间,从而支持跨媒体语义理解与检索。这一能力意味着开发者可以在同一向量数据库中处理不同类型的数据,并基于语义相似度实现跨模态搜索、分类与聚类。

从应用层面来看,统一嵌入空间可以显著简化多模态 AI 系统的架构。以往,如果企业希望构建支持文本与图像检索的系统,通常需要分别使用不同模型生成向量,再通过额外的对齐或映射机制进行整合。而 Gemini Embedding 2 将不同模态的语义直接投射到同一向量空间,使得 检索增强生成(RAG)、语义搜索、情感分析、推荐系统以及数据聚类 等任务能够在统一框架下完成。

在能力规格上,Gemini Embedding 2 延续了 Gemini 系列模型的多模态处理优势,并对不同输入类型提供了明确的支持范围。

文本:支持最多 8192 个输入标记的扩展上下文

图像处理:每次请求最多可处理 6 张图像,支持 PNG 和 JPEG 格式

视频:支持输入最长 120 秒的 MP4 和 MOV 格式视频

音频:原生支持音频数据的导入和嵌入,无需中间文本转录。

文档:直接嵌入最多 6 页的 PDF 文件

除了单模态处理能力之外,Gemini Embedding 2 还原生支持交错输入(interleaved input)。开发者可以在同一个请求中同时传入多种模态,例如“图片 + 文本描述”或“视频 + 文本提示”。模型会在生成向量表示时综合不同媒体之间的关系,从而捕捉更复杂的语义结构。例如,在电商或媒体分析场景中,系统可以同时理解商品图片与描述文本之间的关联。

在向量表示层面,Gemini Embedding 2 采用了 Matryoshka Representation Learning(MRL)技术。这种表示学习方法通过“嵌套”信息结构,使模型能够在保持语义质量的前提下动态压缩向量维度。

默认情况下,模型输出 3072 维向量,但开发者可以根据需求缩减维度,以降低存储与检索成本。官方建议在 3072、1536 或 768 维三个级别之间进行选择,以在性能与资源消耗之间取得平衡。

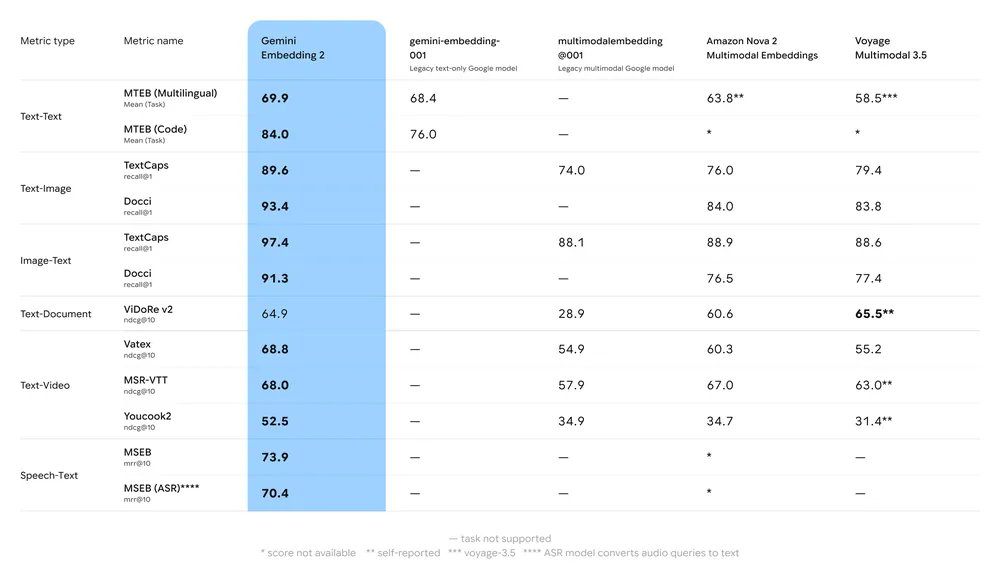

那么,这款新模型性能如何?

多项基测排名第一

谷歌在官网介绍,Gemini Embedding 2 不仅仅是对传统模型的改进,它还为多模态深度建模树立了新的性能标杆,引入了强大的语音处理能力,并在文本、图像和视频任务中超越了领先的模型。这种可衡量的性能提升和独特的多模态覆盖范围,能够精准满足开发者多样化的嵌入需求。

具体而言,在 Text–Text(文本对文本)的语义匹配任务中,Gemini Embedding 2 的表现优于其他模型。在 MTEB 多语言基准(Mean Task)测试中:

Gemini Embedding 2:69.9

Gemini-embedding-001:68.4

Amazon Nova 2:63.8

Voyage 3.5:58.5

这一指标反映模型在多语言语义理解任务中的平均能力。Gemini Embedding 2 比 Amazon Nova 2 高出约 6 分,比 Voyage 3.5 高出超过 11 分,说明其在跨语言语义对齐方面具有更好的泛化能力。

在 代码语义理解(MTEB Code) 上,同样具有优势:

Gemini Embedding 2:84.0

Gemini-embedding-001:76.0

相比上一代 Google 文本嵌入模型,提升达到 8 个点,表明新模型在技术文档、代码搜索、开发者 RAG 等场景中的表现显著增强。

在 Text–Image 与 Image–Text 任务上,Gemini Embedding 2 在主流数据集上几乎全面领先。在文本到图像检索中,在 TextCaps 数据集上,

Gemini Embedding 2:89.6

Amazon Nova 2:76.0

Voyage 3.5:79.4

multimodalembedding@001:74.0

Gemini Embedding 2 相比 Amazon Nova 2 提升约 13.6 分,说明其文本到图像语义映射更准确。

在图像到文本检索中,在 TextCaps 数据集上,

Gemini Embedding 2:97.4

Google multimodalembedding@001:88.1

Amazon Nova 2:88.9

Voyage 3.5:88.6

Gemini Embedding 2 接近 100 分水平,比其他模型 高出约 9 分。

谷歌强调,嵌入技术是许多谷歌产品体验的核心驱动力。从 RAG(嵌入技术在上下文工程中发挥关键作用)到大规模数据管理和经典搜索/分析,谷歌的一些早期合作伙伴已经在使用 Gemini Embedding 2 来解锁高价值的多模态应用。

Everlaw 公司 CTO Max Christoff 表示:“在诉讼取证(Discovery)这一高风险、高技术要求的环节中,寻找核心信息是一项巨大的挑战。我们之所以选择 Gemini 嵌入(embeddings)技术,正是因为其在这一领域的卓越表现。最新的测试结果显示,Gemini 的多模态嵌入模型在处理数百万条记录时,显著提升了搜索的准确率(Precision)与召回率(Recall),并成功解锁了针对图像和视频文件的强大搜索功能。对于法律专业人士而言,这些新能力为快速理解和掌握复杂大案的卷宗材料提供了全新的、前所未有的路径。”

Sparkonomy 联合创始人 Guneet Singh 表示:“Gemini Embedding 2 为 Sparkonomy 的‘创作者经济平等引擎’奠定了坚实基础。得益于其原生的多模态能力,我们通过省去大模型(LLM)推理环节,将延迟大幅降低了 70%;同时,文本-图像及文本-视频对的语义相似度得分从 0.4 提升至 0.8,实现了近乎翻倍的飞跃。这为我们独有的‘创作者基因组(Creator Genome)’提供了强大动力,使其能够以前所未有的精度,对数百万分钟的视频以及海量图像和文本进行索引。这不仅解锁了更加公正客观的品牌合作,也让经济成功的红利普惠至每一位创作者。”

网友评价:多模态 RAG 新基准来了

在多模态大模型竞争进入白热化的今天,谷歌新一代嵌入模型的发布不仅打破了技术圈的宁静,更在开发者社区引发了一场关于“效率革命”的大讨论。

网友们的评价从工程架构的简化到行业范式的转移,无一不透露出对这一技术跃迁的震撼。

对于许多企业而言,维护一个庞大的数据管道是必不可少的成本。然而,新模型的出现正在彻底重写这一逻辑。

“一个能够同时嵌入文本、图像、视频、音频和文档的统一空间,其背后的意义极其深远。”

有网友犀利地指出,以往需要雇佣 8 个人 精心维护的整条“数据管道团队”,如今在这一新模型面前,竟然被压缩成了一个简单的 API 调用。这种极致的“智能密度”让开发者感慨:一个曾经需要跨部门协作才能实现的复杂系统,现在仅凭一个终端指令即可完成。这不仅是技术的进步,更是企业工程效率的一次“降维打击”。

长期以来,AI 在处理不同模态的数据时,往往像是处于互不相通的“孤岛”中。而新模型对交错输入(Interleaved Input)的支持,被网友公认为最神奇的突破点。谷歌的新模型主要具备以下几点突破,首先是全场景融合: 用户可以将图像、长篇音频和 PDF 文档等异构数据“一股脑儿地扔进去”。此外还能跨模态共情: 模型不再只是生硬地提取关键词,而是能够真正理解内容的语气、氛围与内在逻辑。

网友评论称:“我们终于不用再忍受模态孤岛了。”这种全局理解能力,标志着 AI 从“分类机器”进化到了真正的“语境大师”。

如果说架构的简化和功能的增强是“面子”,那么合作伙伴给出的实测数据则是扎实的“里子”。Everlaw 和 Sparkonomy 等早期接入者的反馈,让业内人士感到震惊。

从合作伙伴给出的数据来看,有网友认为这绝非一次常规的小版本迭代,而是为多模态 RAG(检索增强生成) 树立了全新的行业基准。

参考链接:

https://blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-embedding-2/

https://x.com/search?q=gemini%20embedding%202&src=typed_query

https://ai.google.dev/gemini-api/docs/models/gemini-embedding-2-preview?hl=zh-cn