GitHub 详细介绍了其智能体工作流背后的安全架构,概述了一种纵深防御方法,可以安全地将自主 AI 智能体集成到 CI/CD 流水线中。这种设计强调隔离、受限执行和可审计性,降低 AI 驱动自动化带来的风险。

智能体工作流让 AI 智能体可以在 GitHub Actions 中理解意图、做出决策并执行任务,括展了传统的自动化能力。这虽然带来了生产力的提升,但也扩大了安全攻击面,存在提示词注入、权限提升以及意外操作等风险。行业舆论也愈发强调,这类系统需要建立超越传统确定性自动化的安全模型。

正如 Jeremiah Snee 在 GitHub 社区的讨论中所言:

持续 AI 在与 CI/CD 结合使用时效果最好,可以将自动化能力扩展到传统流水线难以覆盖的任务上。

Pravin Chandankhede 在 LinkedIn 讨论中指出智能体工作流所要解决的核心挑战:

从设计层面看,智能体具备非确定性特征。它们接收不可信的输入信息,对仓库状态进行实时的逻辑推理,还能在运行阶段自主执行相关操作。

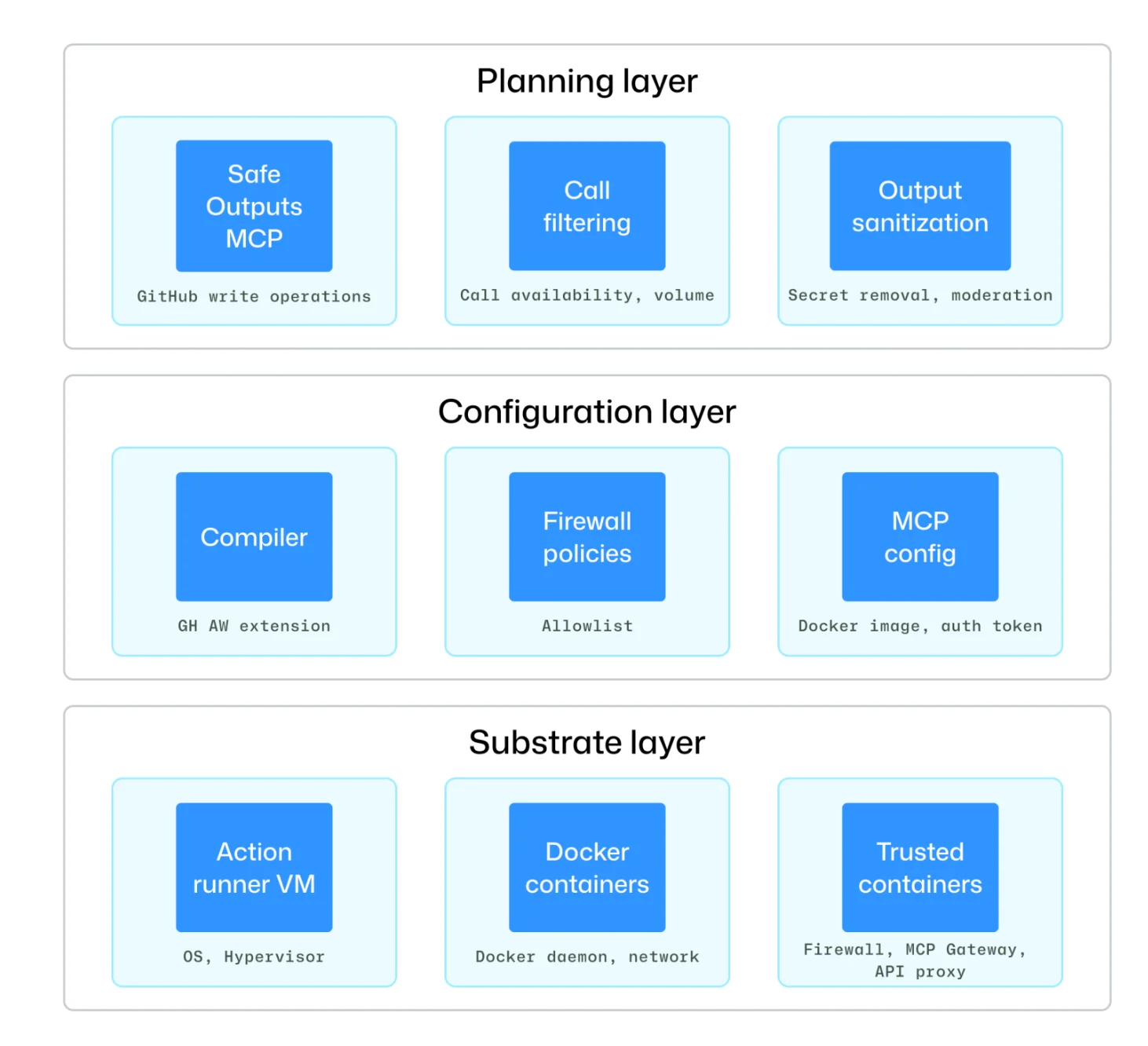

GitHub 设计的核心是一个隔离的分层模型。智能体在沙盒化的临时环境中运行,权限受到严格限制,防止了持久化,并限制了潜在的风险影响范围。工作流默认以只读模式运行,任何写入操作都必须经由受控的安全输出方式完成(如拉取请求或议题评论),确保所有变更保持透明、可审查,在应用之前都需要经过审批。

正如 Florin Lungu 所指出的:

GitHub 的智能体工作流通过隔离、受限输出和全面日志记录来提升安全性。

一个关键原则是避免向智能体泄露密钥。在共享的运行器环境中,智能体可以访问环境变量、配置文件和运行时状态,使得提示词注入成为重大的安全隐患。例如,恶意输入可能诱使智能体从本地文件或日志中读取凭证,并通过外部调用或仓库构件将其窃取。GitHub 通过将智能体隔离在具有受限网络出口的专门容器中来降低这个风险,同时将 API 令牌等敏感凭证通过智能体边界外的可信代理和网关进行路由转发。

第二层用于约束智能体的能力。工具访问采用显式授权机制,限制智能体可以调用的 API 或系统,而网络隔离降低了数据被窃取的风险。这也体现出行业正朝着最大限度减少对智能体行为隐式信任的方向整体转变。

GitHub 智能体工作流安全架构(来源:GitHub 博客文章)

为了进一步限制意外造成的影响,GitHub 对工作流进行了分级,并将写入操作限制为受控输出。智能体只能提出变更建议,这些变更在执行后会被缓冲和分析,确保修改在提交之前经过验证且符合策略规范。

正如 XBOW 平台工程负责人 Eddie Aftandilian 在 LinkedIn 的帖子中所说:

这些安全护栏使得将智能体自动化引入真正的生产仓库成为可能。

可观测性构成了最后一大支柱。GitHub 跨信任边界记录活动,包括网络流量、模型交互、工具使用和敏感运行时操作。这实现了完整的执行可追溯性,支持取证分析,并为执行未来的策略和信息流控制提供了基础。

查看英文原文:https://www.infoq.com/news/2026/05/github-agentic-workflows/