自动驾驶汽车是人工智能技术最令人兴奋和最具影响力的应用场景之一。

仅在美国,每年就有超过35,000人死于车祸。由于自动驾驶汽车理论上可以比人类司机更快做出反应,并且不会醉酒驾驶、不会边开车边发短信或感到疲倦,所以它们应该能够显著提高车辆安全性。这种技术还承诺让老年人和其他不能轻松驾车的人们更加独立,出行更方便。

在过去三年中,自动驾驶汽车行业获得的投资超过 2500 亿美元。

下面列举了行业中各个自动驾驶车辆类型领域中的典型企业:

送货机器人:Gofurther.ai、Idriverplus、Kiwibot、Neolix、Nuro、Refraction.ai、Scout(亚马逊)、Serve Robotics、Starship Technologies、Unity Drive、Yours Technology。

穿梭巴士和公交车:Auto(Ridecell)、百度、Beep、Coast Autonomous、e.Go、EasyMile、Local Motors、Milla Pod、May Mobility、Navya(软银)、Ohmio、Optimus Ride、Sensible4、TransDev、Venti Technologies、Voyage(Cruise)、宇通。

出租车:Argo、Aurora、AutoX、百度阿波罗、Cruise、滴滴出行、东风、现代、Motional、小马智行、Waymo、文远知行、Zoox(亚马逊)。

卡车:Aurora、戴姆勒、Einride、Embark、Gatik、Ike(Nuro)、Inceptio、Kodiak Robotics、Locomation、Plus.ai、小马智行、沃尔沃、特斯拉、TuSimple、Udelv、UPS、Waymo、Zipline。

消费级车辆:苹果、Aurora、百度、宝马、Cruise、戴姆勒、福特、本田、华为、现代、起亚、马自达、日产、标致、上汽、斯巴鲁、Tata Elxsi、特斯拉、腾讯、丰田、大众、沃尔沃。

但自动驾驶汽车真的会更安全吗?

汽车行业面对的最大挑战主要是边缘情况引发的意外状况。事实上有两个新的汽车安全标准,ISO 26262和UL 4600,就试图解决这些边缘情况。

然而这些标准不是强制性的,监管机构不要求自动驾驶汽车遵守这些或其他任何自动驾驶行业专属标准。更糟糕的是,正如我将在下面解释的那样,有充分的理由相信某些类型的自动驾驶汽车可能无法处理这些边缘情况。

自动化水平

首先,我们来定义“自动驾驶”的含义。汽车工程师协会定义了自动驾驶技术的六个级别,如下所示:

L0:人类司机掌控所有驾驶功能

L1:某种程度的驾驶辅助(可以是自适应巡航或路线保持/居中)

L2 :部分自动驾驶(同时具备自适应巡航和路线居中),但司机必须保持控制状态(手放在方向盘上,双眼注视路线,或者两者皆有)

L3:有条件的自动驾驶(特定条件下司机可以双手离开方向盘做自己的事情,但收到车辆提示时必须介入控制)

L4:高度自动驾驶(在特定场景下,如指定城市街道和/或校园道路上,司机不需要介入控制)

L5:完全自动驾驶(不需要人类介入控制)

L3-5 被视为自动驾驶系统(ADS),其中司机无需注意道路。在第 3 级别,司机可以看书或看电影,但如果车辆要求,司机必须能够在 10-60 秒内接管车辆操控。3 级车辆的一个大问题是,在司机接管的 10 秒过渡期内可能会发生碰撞,因此 3 级车辆可能需要包含一个 ODD,不会因为 10 秒交接而出事故(例如低速公路交通拥堵场景)。

第 4 级和第 5 级之间的区别在于,第 4 级车辆仅限在操作设计域(ODD)开启自动驾驶模式,这个 ODD 通常包括受限制的地理区域(例如城市中的一组指定街道),并且可能包括基于天气、当日时间、降水、道路坡度和曲率等因素的限制。5 级车辆可以不受限制地在任何地域行驶,理论上是消费级车辆和商用卡车的有效替代品。

当今道路上的许多消费级车辆,例如特斯拉,都具有驾驶辅助功能。它们可以让车辆保持在车道中央,并且可以自动加速和制动。然而,司机驾驶这些车辆时看书或看电影是不安全的。司机必须不断监控道路并准备好随时接管控制。这些都是 2 级车辆,不被视为 ADS。司机必须注意道路并准备好立即接管。

例如,上周我在纽约高速公路上以自动驾驶模式驾驶时,我的特斯拉时遇到了一个大颠簸。我的特斯拉突然转向并发出“叮叮咚”的声音,意思是“Steve,你靠你自己了”,我不得不迅速做出反应,把它开回我的车道。

这些 2 级车辆的一个问题是,诸如“全自动驾驶”之类的营销术语可能会诱使司机采取危险的行动,例如在 2021 年 4 月的一起特斯拉车祸中,驾驶座上连人都没有。

重大问题:边缘情况

人们在驾驶汽车时使用常识推理来处理各种意外情况:一头鹿飞奔到高速公路上;洪水让道路难以通行或无法通行;汽车在打滑,试图爬上结冰的山丘。

人们不会在驾驶学校了解所有这些可能出现的边缘情况。相反,我们使用日常常识推理技能来预测行动和结果。如果我们看到一个球滚到街上,我们就知道该注意追球的孩子。当我们看到前面的汽车突然转弯时,我们就会改变驾驶行为,因为我们知道司机可能喝醉了或是在发短信。

不幸的是,没有人知道如何将人类的常识推理能力构建到汽车或通用计算机中。 为了代替常识推理能力,ADS 开发人员必须预测每种可能的情况并对其编程。机器学习只能帮助制造商预测每种情况并提供每种可能情况的训练示例。

更糟糕的是,这些边缘情况的数量有数百万甚至数十亿个。 每个人都至少遇到过一次不寻常的驾驶经历。世界上有14亿司机。如果有 14 亿个这样的边缘情况,它们怎么可能全部被识别出来呢?更不要说都得到对应的编程了?

如果 ADS 不能使用常识推理能力来处理所有这些边缘情况,它们真的比人类司机更安全吗?

常识推理的重要性是与 ODD 相关的

4 级车辆仅限于特定的 ODD 才能启用自动驾驶。与没有 ODD 的 5 级车辆相比,这往往会显著减少边缘情况的数量。 例如,我们已经在企业园区内看到了行驶速度非常缓慢的 4 级点对点班车。

这些车辆不太可能遇到很多边缘情况,因为在两个地点之间的一条道路上不会发生很多意外状况。就算发生了什么事,穿梭巴士的行驶速度也非常缓慢,乘客或行人几乎没有风险可言。

ODD 限于特定城市街道的 4 级自动驾驶出租车将遇到比公司班车更多的边缘情况,但可能远不及消费级车辆可能遇到的边缘情况数量。将驾驶领域限制在特定街道上后,人们就可以维护非常详细的地图(包含交通灯和施工区域的丰富细节)。

相比之下,5 级车辆必须能在全球所有街道上行驶—或者至少是消费者所在的国家/地区的所有街道上自动行驶。华盛顿邮报统计,仅在美国就有超过 100 万条道路。

这就是为什么有这么多 ADS 开发人员在凤凰城、旧金山和其他许多城市测试自动驾驶出租车的原因。大多数测试都是由安全司机监控的,他们随时准备在危险情况下立即接管车辆。但是,只有少数无人驾驶测试是在限制性 ODD 条件下进行的。

自动驾驶汽车不像人那样“看世界”

ADS 的另一个问题是计算机视觉系统很容易出错,因为它们可能会被一些人类能正常识别的情况愚弄。

例如,研究人员证明,限速标志的微小变化可能会让机器学习系统认为该标志显示的是 85 英里/小时而不是 35 英里/小时。类似地,一些黑客使用鲜艳的贴纸制造出假车道,欺骗特斯拉的自动驾驶改变车道。

在这两种情况下,这些变化都愚弄了汽车,但愚弄不了人。此外,不良行为者想要欺骗汽车或卡车驶离道路或进入障碍物还有很多方法可用。

自动驾驶汽车看待世界的方式与人类存在很多差异,而这些差异引发的担忧远不止遭受黑客利用这一种。

例如,在现实世界中,许多特斯拉车主报告说他们的汽车经常将阴影(例如树枝的阴影)视为真实物体。在优步测试车辆撞死行人的案例中,汽车的物体识别软件首先将行人归类为未知物体,然后归类为车辆,最后归类为自行车。我不知道你是怎么看的,但我觉得马路上不管是行人、司机还是车辆,无法 100%准确识别行人和其他物体都是很可怕的事情。

为什么测试很重要

我们有很多充分的理由相信 ADS 将比人类司机更安全,我们也有很多充分的理由担心 ADS 不会像人类司机一样安全。

从监管的角度来看,仅仅考虑正面理由就让 ADS 开发人员全权决定是否让 ADS 上路,而无需证明它们比人类司机更安全是愚蠢的做法。但这正是监管机构正在做的事情。

美国国家公路和运输安全局(NHTSA)的立场是:

自动驾驶汽车的安全优势非常关键。自动驾驶汽车挽救生命和减少伤害的潜力源于一个关键而悲惨的事实:94%的严重碰撞事故是由人为错误造成的。自动驾驶汽车有可能从碰撞方程中消除人为错误,这将有助于保护司机和乘客,以及骑自行车的人和行人。当你考虑到美国每年有超过 35,000 人死于与机动车相关的事故时,你就会开始了解驾驶辅助技术可以帮助挽救多少生命。

NHTSA 于 2020 年 12 月发布了 ADS 安全拟议框架,该框架受到美国国家运输安全委员会(NTSB)的批评,理由是“……缺乏强制提交安全自我评估报告的要求,并且缺乏让 NHTSA 来评估报告是否充分的流程。”

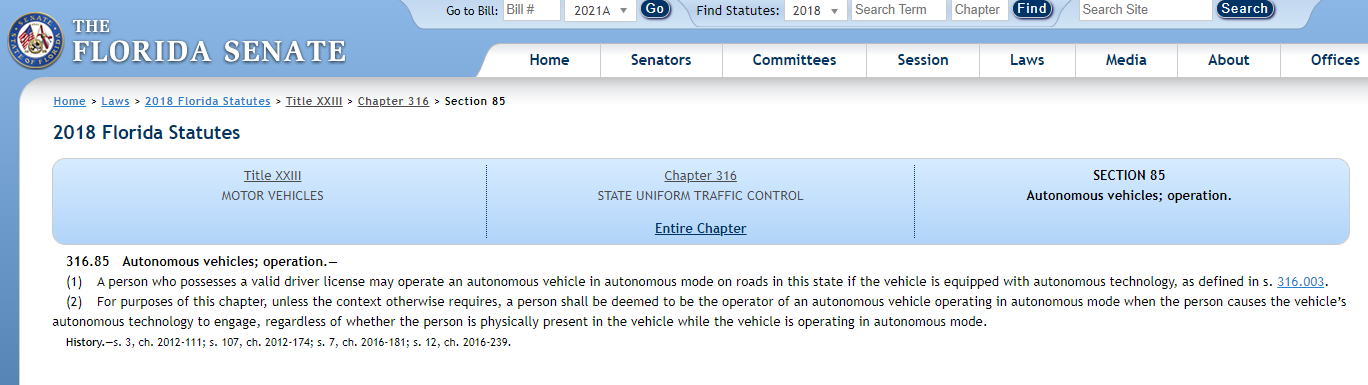

从公共文档中截取的图像

NTSB 还指出,由于缺乏联邦法规,个别州正在制定自己的法规。例如,亚利桑那州的限制最少,NTSB 称这至少对 2018 年 Uber ADS 造成的行人死亡负有部分责任。

佛罗里达州法规316.85 特别允许自动驾驶汽车的运营,并明确规定驾驶者在自动驾驶汽车中无需注意道路情况(例如,司机可以看电影)。它还明确允许自动驾驶车辆无需司机参与。

法规没有要求制造商通过安全测试,作为自动驾驶功能的前置要求。当汽车、卡车、公共汽车或出租车公司认为他们准备就绪时,他们就可以自由地测试和销售自动驾驶车辆。我在佛罗里达州有一个住处,这让我感到害怕。其他不少州也鼓励推出无需前置安全标准的自动驾驶汽车。

ADS 的安全标准

自动驾驶汽车需要进行三种截然不同的安全测试。

第一项测试是确保将信息提供给 AV 决策机制的所有组件都正常工作。一年前在台湾,一辆处于自动驾驶模式的特斯拉 Model 3 以 70 英里/小时的速度撞上一辆翻倒的拖拉机拖车。据报道,事故是由汽车前向传感器阵列中的软件故障引起的,这导致自动制动无法正常工作。传感器的测试应该足以防止这种类型的故障。

Waymo(谷歌)报告说,它将每个摄像头放入汽车之前都会对其进行测试,然后在汽车集成后再测试一次,最后,它会测试与摄像头相关的各种能力,例如检测行人的能力。

ISO 26262 标准已被汽车行业广泛采用,用于测试软件错误和硬件故障。它确保传感器和其他组件按设计工作。

**第二种类型的安全测试是为了证明车辆可以处理预期遇到的真实场景类型。**2016 年,NHTSA概述了 36 种应该进行测试的场景,但指出这不是一个完整的清单。示例场景包括

检测并响应速度限制变化和速度建议

执行高速并线(例如,高速公路)

执行低速并线

Waymo 在驾驶模拟器和加利福尼亚州一个 113 英亩设施的封闭课程中测试这些场景和其他场景,然后在真实街道上配备安全司机进行测试。

测试边缘情况

应该进行的第三类安全测试,是分析系统在遇到未经过训练或编程的意外情况时是否能够安全响应。

行业已开发出两种标准来支持此类安全测试:ISO 21448,也称为预期功能安全性(SOTIF),专为 1 级和 2 级车辆设计,但也可用于 ADS;UL 4600 则专为 ADS 设计。这些标准要求开发人员列出和测试已知的边缘情况。但是,这两个标准都不能确定 ADS 的安全级别,因为它们不测试未知的边缘情况。

**那么,你如何测试未知的边缘情况呢?**一种方法是使用脱离接触数据。在加利福尼亚州,许多制造商正在旧金山等城市测试自动驾驶出租车。这些车辆以 4 级模式运行,ODD 仅限于特定的城市街道,但也配备一名高度警惕的安全司机准备好立即接管,就好像它是 2 级车辆一样。当车辆出现问题时,安全司机会接管。这被称为脱离接触。

我们知道人类在两次事故之间平均会行驶多少英里。如果假设每次脱离都会导致事故,那么脱离率就可以与人类(或更具体地说是出租车司机)的事故率进行比较。不幸的是,估计自动驾驶汽车要证明安全性所需要行驶的里程数并不是那么简单。

兰德公司在 2016 年估计,这将需要数亿英里的自动驾驶里程,这是不切实际的。但从那以后,仅 Waymo 就已经记录了超过 2000 万英里的自动驾驶测试里程。

另一个问题是我们没有**针对特定 ODD 的人类司机事故的统计数据。**但是,我们至少可以将特定 ODD 的 ADS 事故率与人类司机总体事故率进行比较。鉴于 90%的人类司机车祸是由人为错误造成的,即使我们用的是精细的 ODD 统计数据,也可能不会与总体事故率有很大偏差,因为大多数事故都是人为错误造成的。

最后一个问题是,在 ADS 测试期间发生的许多脱离不会导致事故。很多脱离的发生是出于良性原因,例如需要在不属于 ODD 的街道上行驶。尽管如此,ADS 测试过程可以得到加强,以便进行某种程度的比较。

例如,Aurora 安全司机会记录他们为了防止事故而脱离的次数。类似地,Argo记录脱离事件的传感器数据,让分析人员可以使用它来审查脱离事件。Waymo使用脱离传感器数据在模拟中重新创建脱离条件,从而确定如果安全司机没有脱离,车辆是否会发生碰撞。

Aurora、Argo 和 Waymo 等公司正在测试 4 级车辆—主要是自动驾驶出租车。对于 5 级消费车辆而言分析脱离数据更加困难,因为环境种类繁多,这些车辆很难配备安全司机进行测试。然而,当使用的是 2 级 ADS 时,消费级车辆实际上是有安全司机的,安全司机就是消费者。

事实上,一些消费级车辆记录了不少脱离。例如,当特斯拉在自动驾驶模式下被人类司机接管控制时,这将被记录为脱离并报告给特斯拉总部。但据我所知,特斯拉不会与监管机构共享这些数据。尽管如此,消费级汽车制造商仍可以让负责记录脱离原因的安全司机测试他们的车辆,并且监管机构可能会要求 ADS 开发商共享这些数据。

总 结

自动驾驶系统(ADS)旨在驱动汽车、出租车、公共汽车或其他车辆,而人类可以在车上做其他事情(例如读书)。3 级和 4 级 ADS 的操作设计域(ODD)有限制,其中可能包括受限制的地理区域和基于天气、时间、降水、道路坡度和曲率以及其他因素的限制。5 级车辆可以在任何地方运行,并且没有 ODD。

有充分的理由假设 ADS 将比人类司机更安全。毕竟它们从不疲倦,不会在开车时发短信,或酒后驾车。

同样有充分的理由假设它们不会更安全。没有人知道如何将常识构建到计算机中。但是,ADS 需要常识推理来处理它可能遇到的所有意外情况(边缘情况)。在没有常识推理能力的情况下,ADS 只能处理已明确编码到 ADS 软件中的边缘情况,或 ADS 已被训练处理的边缘情况。当遇到 ADS 工程师未预料到的边缘情况时,可能会发生事故和交通拥堵。

现实情况是,ADS 可能对某些 ODD 是安全的(例如以 5 英里/小时的速度在一条街道上来回穿梭的公司班车),但对于其他 ODD(例如覆盖广泛地理和所有天气条件的出租车服务)可能就不够安全,或者无法实现 5 级自动驾驶了。

美国和世界各地的监管机构都在急于将 ADS 技术推向市场,因为它具有降低事故率和改善老年人和残疾人的出行能力等潜在好处。例如,美国国家公路和运输安全局(NHTSA))表示,它认为对 ADS 能力的测试不是必需的。某些 ADS 将被证明对特定 ODD 是安全的。一些 ADS 可能会被证明对其他 ODD 和/或 5 级驾驶是不够安全的。

在允许 ADS 进入公共道路之前,难道不应该要求 ADS 开发人员证明 ADS 至少与特定 ODD 的人类司机一样安全吗?缺乏监管有可能将我们的道路变成一场具有灾难性后果的大规模试验。

本文讨论了在我们的道路上允许 ADS 之前应该执行的测试类型,并呼吁我们的监管机构要求进行此类测试。

作者介绍

Steve Shwartz 于 1979 年在耶鲁大学计算机科学系担任博士后研究员,开始了他的 AI 职业生涯,曾是多家公司的创始人或联合创始人。他的世界语产品成为 1990 年代领先的商业智能产品之一,最近,他与他人共同创立了 Device42,该公司作为一家快速发展的科技公司赢得了许多奖项。Steve 是《邪恶机器人、杀手计算机和其他神话:人工智能的真相和人类的未来》一书的作者,该书于 2021 年 2 月由 Fast Company Press 出版。

原文链接:

https://thegradient.pub/are-self-driving-cars-really-safer-than-human-drivers