演讲嘉宾|隋伟 博士

编辑|Kitty

策划|QCon 全球软件开发大会

传统的具身智能操作方法将视觉感知、语言理解和动作规划分割为独立模块,导致系统复杂、误差易累积且泛化能力不足。视觉语言动作模型(VLA)则实现了从多模态感知到动作生成的端到端学习,构建了 “所见即所动” 的智能决策闭环,极大地推动了具身智能发展。

然而视觉语言动作模型本身也存在诸多挑战,例如训练数据难以获取、模型结构缺少长时序和物理逻辑推理的能力。这意味着 VLA 虽然能实现一些操作功能但是对不同场景、不同任务的泛化性仍然存在挑战,无法满足实际的需求。

本文整理自地瓜机器人算法副总裁隋伟 博士在 2025 年 QCon 全球软件开发大会(上海站) 的分享“具身智能中的 VLA 技术及其应用”,内含涵盖 VLA 技术的基本原理和机制,以及在落地过程中涉及到的数据、评测等问题, 从而提升 VLA 的性能和易用性等等。

预告:将于 4 月 16 - 18 召开的 QCon 北京站设计了「具身智能与物理世界交互」专题,聚焦 VLA/VA 模型与数据体系两大核心,深度拆解具身智能技术链路。拟探讨模型现状、核心挑战与机会,分享高质量数据解决方案,解析仿真与 World Model 的赋能价值,破解核心技术瓶颈。敬请关注。

以下是演讲实录(经 InfoQ 进行不改变原意的编辑整理)。

我先简单介绍一下地瓜机器人,是一家专门聚焦机器人领域的公司。我们提供一整套机器人解决方案,包括底层芯片、操作系统、开发环境、数据算法以及云平台等。我们的目标是让机器人的开发变得更加简单,让每个人都能上手开发机器人算法。

我今天分享的主题是 VLA(视觉 - 语言 - 动作模型)。我会围绕 VLA 开发过程中遇到的各种问题,介绍目前的现状与挑战,涵盖从数据到模型、再到最终部署及应用中遇到的困难。

具身智能中 VLA 的现状和挑战

首先看 VLA 的现状与挑战。具身智能在这两年非常火热,被认为是继智能驾驶之后的另一个爆发点。其背景是底层 AI 模型的快速发展,尤其是像 VLM(视觉语言模型)这种离身智能大模型,已经具备了很好的通用性和泛化性。目前在聊天类应用、文生图以及 VLM 问答方面,技术已经做得非常成熟。下一步,技术必然会向具身智能演进,即让机器人的动作也具备这种通用能力。而且,具身智能的前景和市场容量远比智能驾驶要大。智能驾驶目前的普及率大约在 60% 到 70%,而具身智能未来会存在于各种场景中。

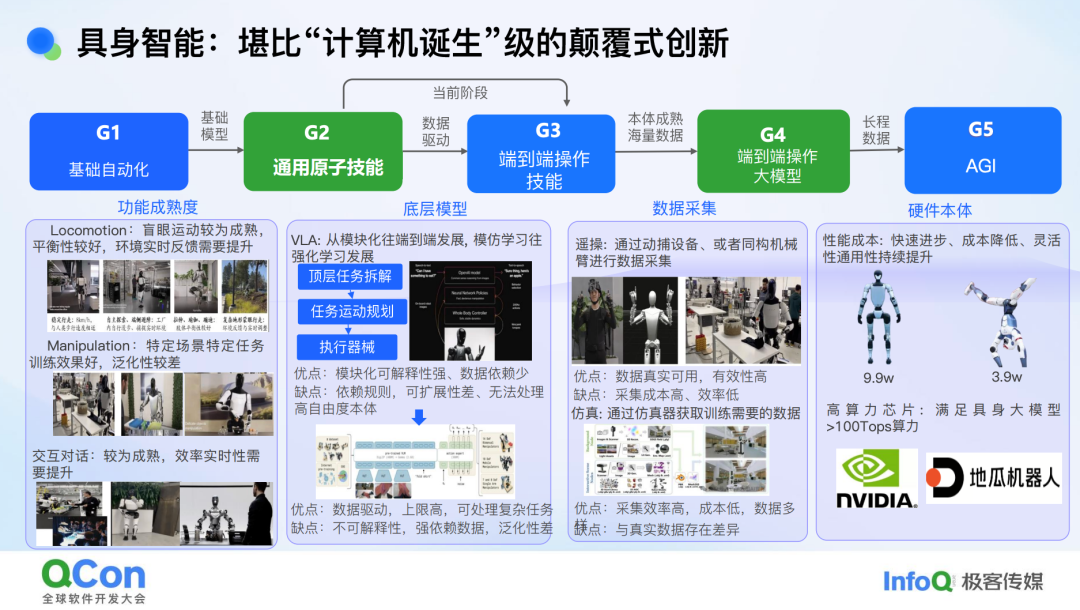

从功能、底层模型、数据和硬件本体四个维度来看,目前具身智能的现状如下:在功能成熟度方面,我们将本体任务分为上肢操作(Manipulation)、下肢移动(Locomotion)和对话。目前对话功能已经非常成熟,许多陪玩类机器人已经落地。在移动能力方面,我们能看到很多机器人跳舞或进行搏击比赛,但目前大多属于“盲眼运动”,虽然有一定的情绪价值,但缺乏与现实的感知交互。比如机器人在跳舞时,如果前面有障碍物,由于没有通过传感器感知世界,它依然会撞上去。

至于上肢操作,这是我们今天要讲的重点,也是与 VLA 关系最密切的方向,目前它是最具挑战性、最不成熟的。其底层模型正经历从 G1 到 G5 的发展阶段,现在大约处于 G2 到 G3 之间,即从传统的工业自动化向端到端学习过渡的过程。虽然 VLA 正在从分层式架构向端到端架构发展,但挑战巨大,核心在于数据。现有数据无法支撑 VLA 发挥出应有的性能,而数据采集目前也没有完美的解决方案。遥操作采集的数据真实,但效率极慢;仿真虽然能快速获取数据,但有效率较低。此外,硬件本体目前也不够稳定成熟,尽管成本在快速降低,但端侧算力依然面临挑战。虽然现在到处都是问题,但 VLA 在发展过程中肯定会遇到各种坎坷。它应该是一个螺旋式或波段式前进的过程,而我们现在正处于第一个波峰。

我们来看看 VLA 到底是为了解决什么问题。因为我之前从事自动驾驶领域,而自动驾驶是 AI 第一个大规模落地的场景,所以我比较倾向于通过自动驾驶这十年的发展路径和 AI 落地过程,来推演具身智能当前所处的阶段。

自动驾驶领域的一个重要节点是“端到端”技术的出现。特斯拉率先发布了端到端算法,通过模仿学习来解决拟人化的问题。在此之前,自动驾驶主要依靠规则化方案来生成轨迹,涵盖行驶方向、速度和加速度等。驾驶最关键的三个要素是安全性、舒适性和高效性。在端到端技术普及前,传统规则化方法很难同时兼顾这三点。比如,为了保证安全而让系统过于保守,效率就会降低;如果驾驶风格激进以提高效率,安全性和舒适性又会受到影响。端到端技术较好地解决了这个问题,因为它直接从专家数据中学习驾驶过程,让体验提升了一大截。

不过,端到端技术也遇到了泛化性和适应性的难题,核心还是数据问题。比如不同城市、不同风格的红绿灯和标志牌,一旦系统没见过相关数据,性能就会立即下降。既然现在的 VLM 已经具备了极强的通用性、泛化性和常识能力——例如你问它某个交通标志是什么意思、该怎么开,它能给出很好的语言描述——那我们就在想,能不能把这种能力引入到具身智能系统中,形成 VLA,让系统具备思考能力。目前在自动驾驶领域,已经有一两家头部玩家最近跑通了 VLA。相比端到端模型,VLA 的模型规模要大出 10 倍左右,端到端模型通常在 0.1B(亿级参数)量级,而 VLA 则在几个 B(十亿级参数)的量级,且训练数据量庞大,通常需要几十亿个短视频片段才能训练出一个性能较好的版本。

回到具身智能,即便是一个简单的动作,也存在技术方案的演进。第一种是模块化方案,类似于早期自动驾驶的思路,即“先检测再规划”。在 2019 年到 2020 年期间,很多 Demo 都是这么做的:先简单处理物体的姿态,再规划机械臂的操作。但问题在于,很多任务是无法直接规划的,尤其是自由度较高时。机械臂一般有 6 到 7 个自由度,人形机器人则有几十个,这不像自动驾驶只需在二维平面规划轨迹。

随后出现了模仿学习,即直接通过端到端的方式学习一条轨迹。它的好处是能完成一些规划不出来的复杂动作,并处理抓取柔性物体等任务。但它的局限性在于对数据的强依赖,于是便诞生了 VLA。VLA 的初衷是解决场景泛化、任务泛化和本体泛化这三个问题。我们希望利用 VLM“见多识广”的能力,让机器人也具备同样的通用性。从落地角度看,场景和任务的泛化优先级最高,本体泛化可以排在最后,因为单款机器人如果能具备通用性,其价值就已经非常巨大了。

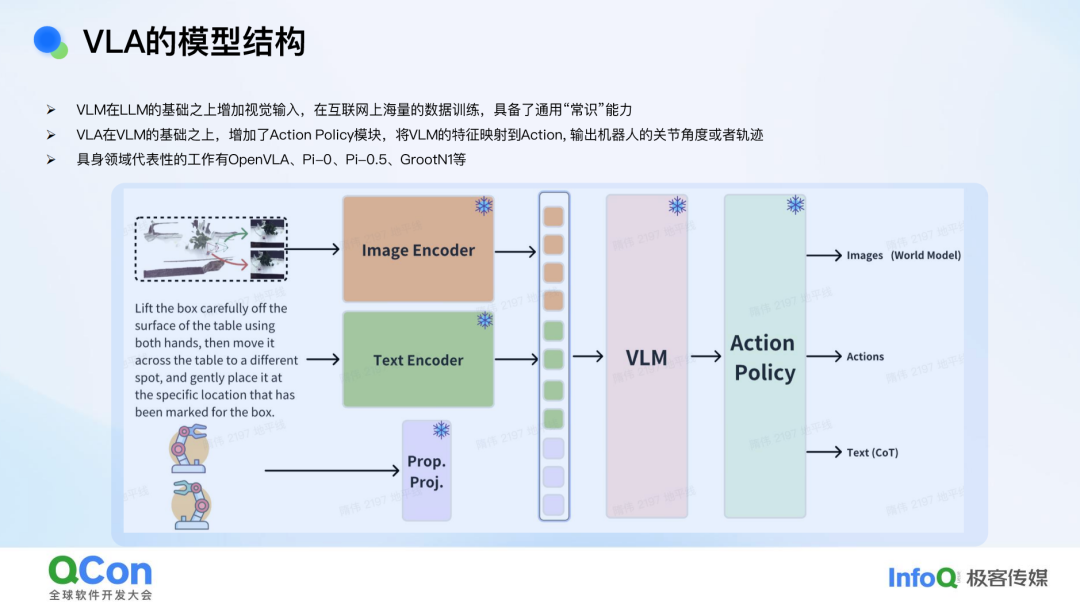

关于 VLA 的模型架构,其实逻辑非常直接。现在的模型输入通常是多模态信息,一般包含图像、文本和本体状态。其中本体状态主要指姿态信息和关节角度等。这些信息经过编码器处理后,输入到基于 Transformer 架构的 VLM(视觉语言模型)中进行多模态融合。VLM 输出的 Token 包含了图像、文本和本体的综合信息,随后进入动作策略(Action Policy)模块。

在动作策略模块中,目前主流的方法有两种。一种是扩散策略(Diffusion Policy),这在文生图等生成式模型中很常见。它通过生成式的方式来产生复杂的轨迹,相比之下,传统的判别式方法在描述轨迹的能力上不如扩散策略,因此扩散策略在动作生成中占据了非常重要的位置。另一种方法是流匹配(Flow Matching),同样属于生成式,它与扩散策略的主要区别在于底层的数学建模不同。扩散策略的分布建模更复杂,而流匹配则是在生成过程中进行线性迭代。经过动作策略模块的处理,最终会输出机器人的关节动作,也就是 VLA 中的“A”。

同时,也有很多研究工作会让模型输出一些辅助信息。比如有些模型会输出文本,这是借鉴了像 DeepSeek 等大语言模型的思路,旨在让机器人具备“思考”能力。也就是说,在训练模型时,不仅要让它给出答案,还要让它理解为什么是这个答案。这属于思维链(CoT)或动作链(CoA)的范畴。另外,也有研究会让模型输出图像信息,即利用当前的姿态、图像和文本去预测下一时刻的图像,这就是世界模型(World Model)。其基本原理是,如果模型能基于当前数据准确预测下一刻的状态,就认为它学习到了物理规律。目前已经有一些工作将世界模型与 VLA 结合在一起进行训练。

在具体的架构实现上,目前主要有两种主流方案。一种是 VLM 直接输出特征(Feature)并传递给后续模块,这被称为“一段式”的端到端架构。另一种是分层式架构,VLM 输出的不是特征,而是语言形式的任务规划。例如,当输入指令是“收纳桌子”时,VLM 会先将任务拆解为具体的指令,比如“把杯子移到中央”、“把水倒掉”、“把垃圾丢掉”等,再将这些步骤逐一输出给下游模块执行。

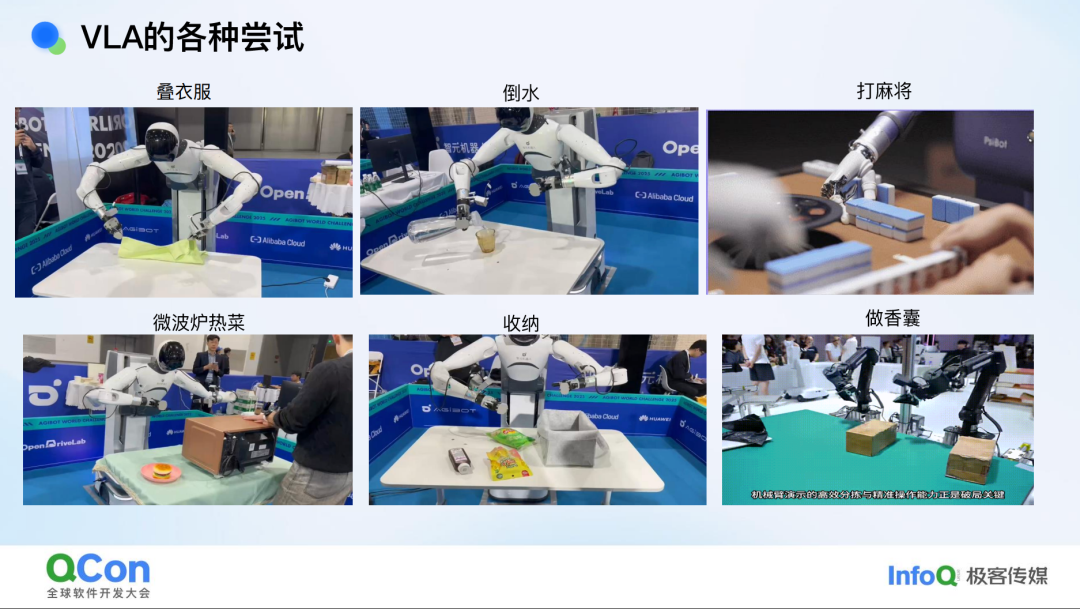

我们来看一下目前的 VLM(视觉语言模型)究竟能做哪些事情。VLM 的设计初衷,一是解决任务的泛化性,二是处理复杂的长程任务。最近我去杭州参加了机器人国际会议的一个比赛,现场有六种任务,我重点观察了其中三种。第一种是叠衣服,这是典型的长程任务,要求机器人无论衣服如何摆放,都能将其折叠好;第二种是倒水;第三种是操作微波炉;第四种是收纳。此外,在近期的世界机器人大会(WRC)和世界人工智能大会上,我也看到了一些现场演示。比如打麻将,它采用的是分层架构,使用了一个经过麻将数据训练的 12B 规模的 VLM。机器人会通过语音告诉你该怎么出牌,再利用传统方法检测麻将位置并完成推牌或抓牌动作,体验效果还不错。还有做香囊,这是一个更长程的任务,需要把东西装进去并勒紧绳子,这是由智元机器人完成的。目前市面上看到的这些炫酷动作,背后基本都是 VLA 在支撑,且大多基于 OpenVLA 等模型,这代表了目前能力的上限。

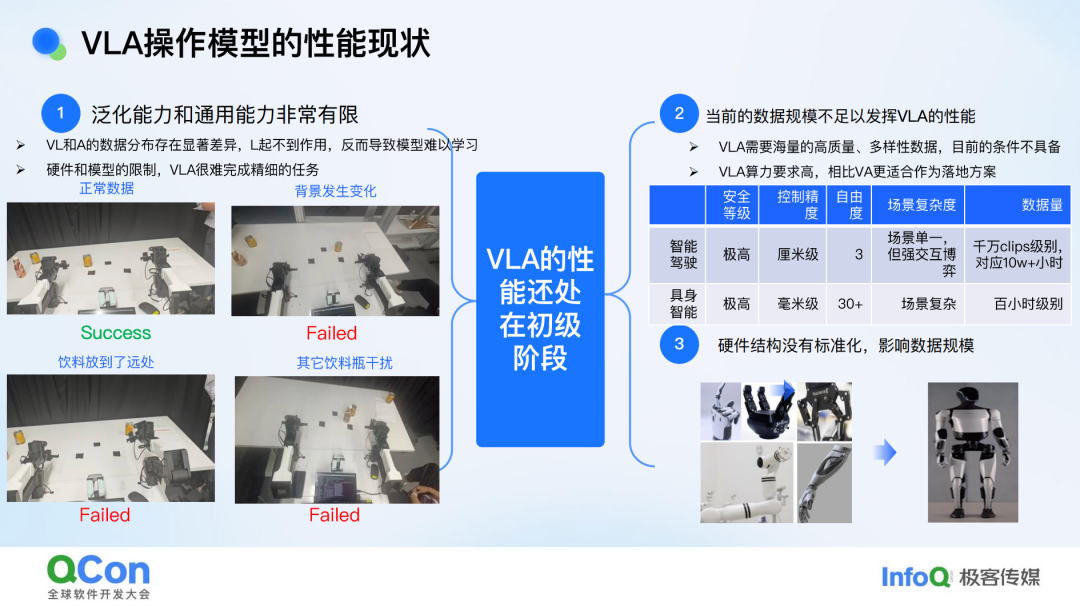

可以说,对于单一任务,如果我们提供大量数据,模型是具备长程执行、理解和复杂任务处理能力的。但它最大的问题在于泛化性极弱。我们设计 VLA,是希望利用 VLM 在互联网上见过的海量数据,让机器人具备通用性和迁移能力。理想情况下,即使面对没见过的场景,模型也能凭借“常识”实现零样本(Zero-shot)能力。但实际测试下来,这种能力还不具备,原因主要有几点。

首先,VLM 中的“视觉 - 语言”数据与“动作”数据分布不一致。VLM 基座是通过互联网上大量的图文对训练的,而动作数据(A)必须靠真机实采。目前实采的数据量非常小,通常只有几百到几千条,与图文数据相比极其不均衡,导致 VLM 的知识无法有效迁移到动作上,模型处于严重的过拟合状态。其次是硬件限制。我们看到的很多流畅动作其实是经过 5 倍或 10 倍速处理的,实际操作时会有明显的抖动。受限于机械臂硬件本体,目前 VLA 还无法完成穿针引线这类精细化任务。

我们也做了一些泛化性验证,比如最简单的抓取和投放。实验发现,当背景发生变化(如移走测试环境中的黑色窗帘)、物体位置放远了一点,或者加入未训练过的干扰物(如一瓶咖啡),机器人就会失败。这说明目前的系统非常脆弱,原因就是数据量太少,多样性严重不足。

我们可以对比一下自动驾驶所需的数据量。自动驾驶可以看作是单一任务的具身智能,只负责“驾驶”。即便如此,要训练一个基本可用的模型,大约需要千万量级的视频片段,换算下来约为 10 万小时的数据,且这些数据必须分布在不同的空间和天气场景中。而目前具身智能领域,即便是一些领先的采集工厂,数据量也仅在百小时到千小时级别,还要应对无数种任务,这显然远远不够。

此外,自动驾驶的车辆是标准化的,动力学特性基本一致,数据容易复用且采集便利。但具身智能的硬件目前还没收敛,手部既有夹爪也有灵巧手,自由度从 7 个、11 个到 21 个不等,导致数据无法复用,智能化进程缓慢。

经常有人问:现在的具身智能相当于自动驾驶的什么阶段?是 2015 年还是 2012 年?我认为,从算法模型来看,具身智能完全可以对标 2025 年的自动驾驶,两者都在往端到端或 VLA 方向走,没有代差。但从硬件角度看,具身智能可能还不如 100 年前的汽车工业,因为那时候汽车已经实现流水线大规模生产,而现在的机器人还远未达到那个水准。

VLA 的主流架构

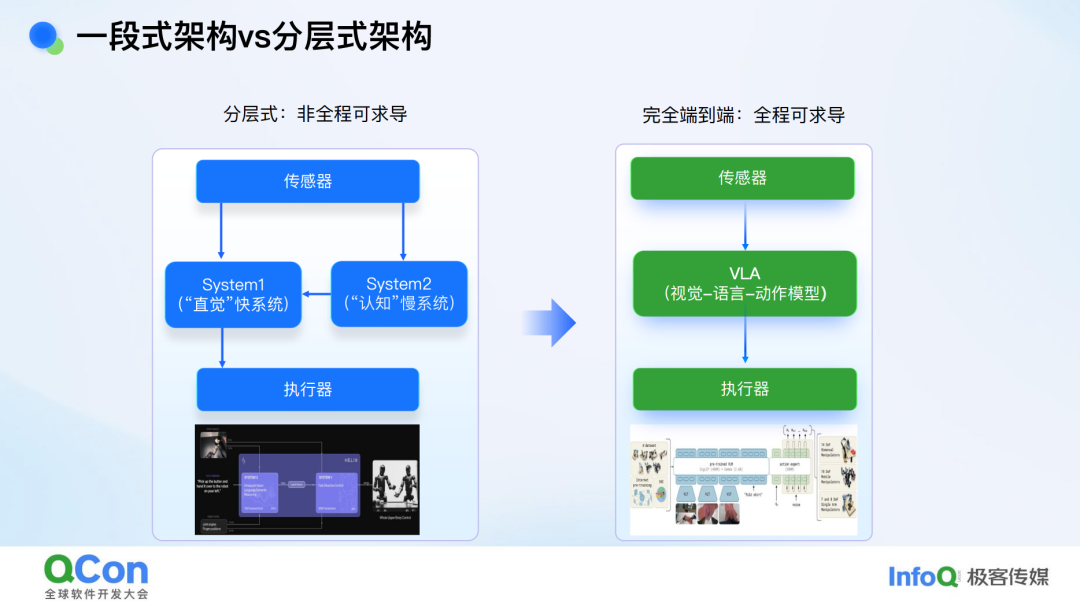

刚才我们讲到主流架构主要有两种:一种是分层式的,另一种是完全端到端的。这两者的核心区别在于 VLM(视觉语言模型)向下一层传递的是语言规划指令,还是直接传递特征(feature)。

分层式架构在输入传感器数据后,会由两个系统协同工作。所谓“慢系统”,就是我们常说的 VLM,它负责对数据进行推理。之所以称之为“慢”,是因为模型体量巨大,为了让它具备常识能力,必须经过海量数据训练,在现有的硬件条件下,其推理速度相对较慢。而“快系统”则是前面提到的端侧系统,它的模型较小,直接输出动作或轨迹,因此运行速度很快。我认为这种“快慢系统”的划分,本质上是受限于目前的硬件计算资源。如果未来端侧算力足够强大,其实就不需要这种区分了,所有环节都能实现实时响应。

在分层系统中,系统 2 负责思考并给出语言规划,再传达给快系统。比较典型的例子是 Figure 01 机器人展示的 Demo,它采用的就是分层式架构。由于需要部署在 Orin 等芯片上,为了克服无法实时处理的问题,必须构建快慢系统。去年在自动驾驶领域比较火的理想汽车,也率先推出了类似的快慢系统,其初衷同样是解决端侧部署时的算力限制。不过从工程角度来看,快慢系统会更复杂一些,因为模块越多,工程量就越大。相比之下,完全端到端的架构就简单得多,传感器数据输入后,中间全部交给 VLA 处理并直接输出结果,没有了快慢之分。

这两种架构各有优劣。完全端到端的上限更高,但它对数据的需求量极其庞大。分层式架构目前的优势在于对数据的依赖程度没那么高。因为 VLM 可以通过少量的针对性训练达到较好的语言规划效果,开发者只需要专注于训练后面的动作执行模块,甚至可以沿用传统的控制模块。就像我之前提到的打麻将机器人,它的快系统其实就是用传统方法实现的。在目前数据保有量有限的情况下,分层式是一个比较合理的选择。此外,分层式也更契合现在的智能体(Agent)或 MCP(多模型控制平台)架构,即由 VLM 充当“大脑”进行语言规划,再由快系统中的各种动作原子负责具体执行。

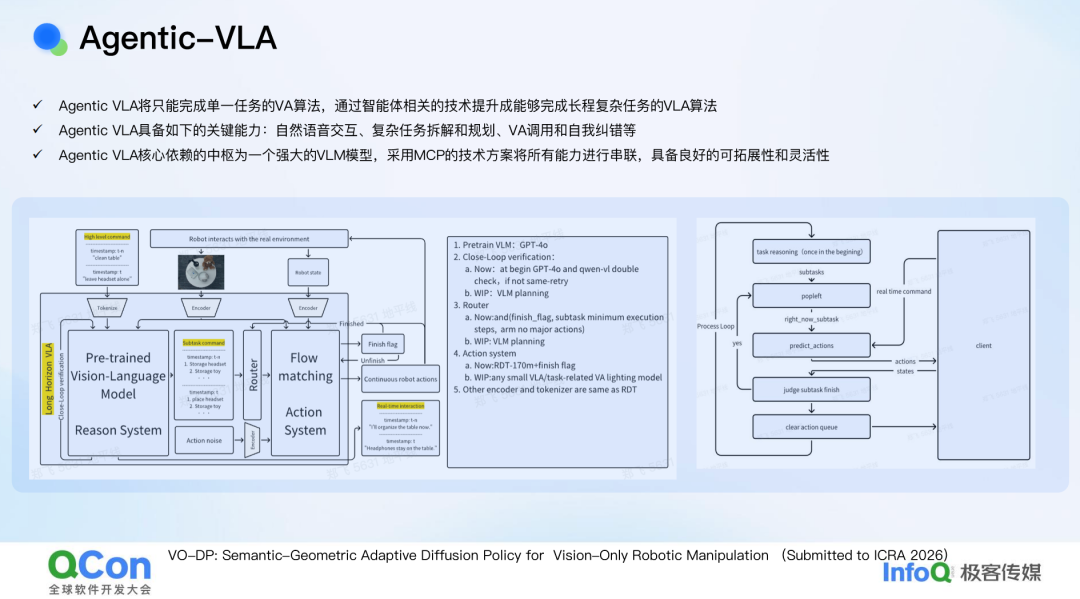

这是我们最近在做的一些探索,主要集中在分层式架构上。之所以选择这个方向,是因为我觉得目前纯粹搞端到端方案其实已经遇到了瓶颈。在数据量不够的情况下,大家做出来的东西很难体现出差异化,落地也非常困难。因此,我们的思路是先把 VLM(视觉语言模型)的能力利用起来,让它作为一个调度大脑,也就是 Agent,去调用各种各样的“动作原子”。

比如,驾驶可以被视为其中一个动作原子,当机器人需要执行驾驶任务时,Agent 就调用驾驶模块;收纳也是一个原子,它由许多“抓取与放置”(Pick and Place)动作组成。我们正在积累这些动作原子,当机器人面对复杂任务时,就由 VLM Agent 来进行任务分解和调度。这里面比较有挑战性的地方在于任务之间的衔接,即如何准确判断当前任务已经完成并开始下一个,以及当任务出错时,Agent 该如何调整调度流程。

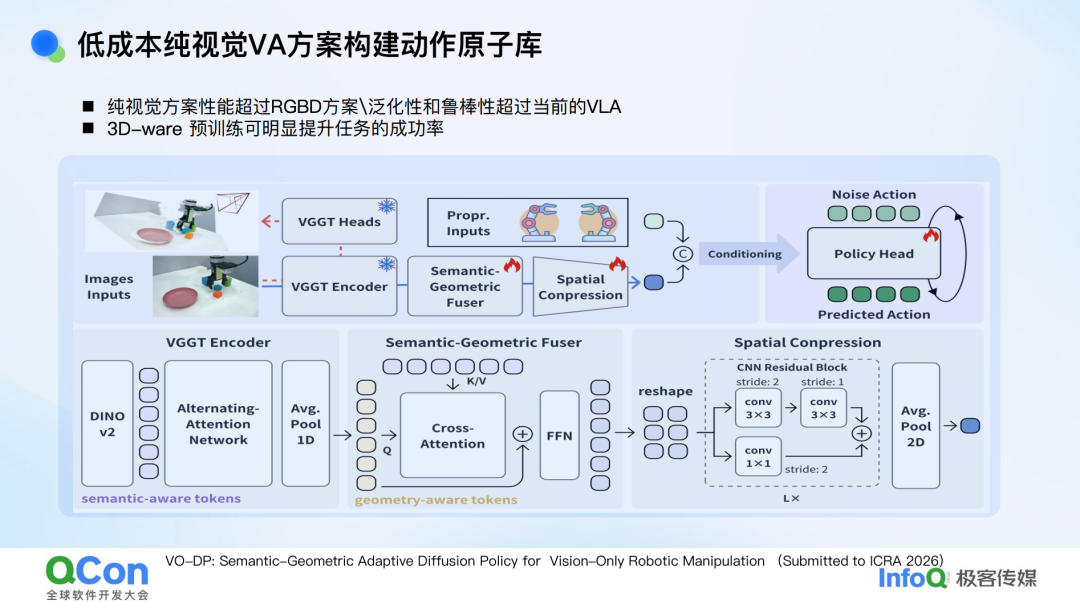

在开发动作原子时,我们走的是 VA(视觉 - 动作)路线。我们发现现阶段语言在具体动作执行中起到的作用其实非常有限,直接通过 VA 实现反而更容易出效果。在方案设计上,我们选择了纯视觉方案,没有使用 RGBD。这主要是从本质原理考虑的,我们认为视觉能力已经足够强,人类也是靠双眼来完成各种观测任务的。后期的验证也证明,纯视觉方案在鲁棒性和迁移性上确实比点云方案更好。

此外,我们在模型中增加了 3D 感知信息。目前的 VLM 其实并不具备很强的空间理解能力,如果你去测试它,它很难给出物体准确的方位、距离或复杂的几何尺寸,因为它的训练数据里缺乏这些信息。而这些 3D 信息对于动作的泛化性至关重要。如果能在一个统一的 3D 空间里进行动作规划,泛化性会强很多。因此,我们在架构中增加了一个 3D 编码器(Encoder)模块。

这里用到了今年 CVPR 的最佳论文 VGGT,这是一个用于三维重建的视觉基础模型。我们知道,大模型正在改写各个研究领域,原先的导航规划现在变成了 VLN(视觉语言导航),原先的操作规划和控制现在变成了 VLA。VGGT 则是三维重建领域的代表,它基于 Transformer 架构,效果已经接近传统的 COLMAP 等三维重建方法,潜力巨大。我们做的工作就是将 VGGT 预训练的 3D 相关特征提取出来,接入到 VA 模型中。经过验证,这种做法在鲁棒性和效果上都超出了我们的预期。

这是我们目前使用的模型架构,其中 VGGT 的编码器部分负责生成特征。这些特征同时包含了语义信息和几何信息,我们将其直接输入模型以获取结果。

其实模型本身并不复杂,在 VLA 的落地开发中,大部分工作量并不在模型架构上。通常情况下,模型部分的搭建两三周就能搞定,而真正耗费精力的是数据工作。对于具身智能而言,还涉及到机器人硬件适配、数据采集和实机测试,这部分工作量往往会占到总周期的三分之二甚至四分之三。

目前具身智能开发的第一步通常是在仿真环境中进行的。由于真实世界的有效数据非常稀缺,我们需要先在具有物理引擎的仿真器中采集数据,验证模型的有效性。以“夹木块”和“堆木块”为例,这类任务在人类看来很简单,但对机器人来说挑战巨大,稍微有一点偏差就会导致失败。我们将自己的方案与传统算法进行了对比:DP 是基于 2D 图像输入的扩散策略算法,而 DP3 则是基于点云输入的版本。在真机测试中,我们的方案成功率明显更高,尤其在将木块放入盘子的任务中,表现几乎比 DP 翻了一倍。

在测试 VLA 的过程中,我们发现“泛化性”是一个核心痛点。目前的 VLA 方案,比如 OpenVLA,在光照发生变化时表现得很脆弱。例如环境光线由暗变亮,任务可能就会失败。但如果我们在 VA 模型中引入 3D 几何信息,系统就会表现出更好的鲁棒性,而现有的主流方案在处理这类场景时依然容易失误。

当我们通过 VA 实现了这些动作原子并建立起原子库后,就可以利用 Agent 这种大脑角色进行任务编排,从而完成长程的复杂任务。这种做法的优势在于能充分利用现有 VLM 的推理能力。目前 VLM 在任务规划上已经非常成熟,比如你让它规划收纳任务,或者给它一张路口的照片问它车辆该怎么开,它都能给出非常清晰的规划指令,甚至会提醒你注意避让前面的大卡车。现在的核心挑战在于,如何将这些高质量的语言规划准确地传递给 VA 模块去执行动作。

只要能把这一步打通,整个任务链就能串联起来。如右侧表格所示,这是一个完整的闭环流程:我们需要识别任务是否已完成。例如通过增加标志位来检测当前步骤的状态,如果任务完成,就调用下一个原子动作;如果没有完成,则返回重新执行。这种典型的类似 MCP 的架构,是目前完成复杂长程任务的有效路径。

这是另外一些实验效果的展示,包括积木在左手与右手之间的交接、一个盒子叠放到另一个盒子上,以及桌面的整理管理。在这些任务中,有些属于复杂的长程任务,有些则是通过 VA(视觉 - 动作)模型直接实现的。目前来看,只要数据质量足够高且训练到位,机器人都能完成得比较好。此外,我们使用的机械臂采用了谐波减速器,精度较高,对于完成插拔这类精细任务来说是完全够用的。

VLA 的数据方案

接下来谈谈数据方案,这是目前具身智能行业最大的痛点。很多从自动驾驶领域转过来的同事会觉得,具身智能的数据基础设施还处于非常原始的阶段。目前行业内数据采集主要有两种方案:第一种是遥操作,这其中又包含很多细分技术;第二种是仿真。关于到底是以仿真为主还是以真实数据为主,业内一直存在路线之争。但在我们看来,真实数据是必不可少的,仿真数据如果做得好能起到很大作用,如果做得不好,可能只是锦上添花。

在遥操作方面,主要有几种技术路径。第一种是惯性动捕设备,通过让采集人员穿上带有 IMU 惯性传感器的服装,在运动时捕捉身体各关节的数据。这种方式的优点是没有视觉遮挡问题,即使两人拥抱也能采集到数据;缺点是惯性传感器存在漂移,时间久了精度会下降。目前特斯拉采集 Optimus 工厂数据时,使用的就是这种惯性动捕设备。第二种是光学动捕设备,需要在空间内安装多个摄像头,采集者穿戴贴满 Marker 点的服装。它的精度非常高,能达到亚毫米级,但缺点是容易受遮挡影响,如果摄像头没捕捉到某些点,后期就需要大量人工修补。

还有一种常见的方式是外骨骼采集,即人带着同构或异构的机械臂进行操作。这种方式采集的数据几乎是 1:1 复刻,数据有效率很高,但采集效率相对较低。上述这些方式现在统称为“以人为中心”的数据采集,其最大的挑战在于人的关节结构与机器人并不一致,涉及到非常复杂的数据重定向(Retargeting)问题,有些人的动作不一定能直接迁移给机器人。最后是仿真数据,目前它主要用于大规模数据生产和自动化评测。当模型训练完成后,如果想要进行快速迭代测试,在仿真环境中进行是最高效的选择。

在仿真环境的建设中,首先需要考虑的是资产库的规模。仿真器本身只负责物理仿真和渲染,而具体的场景——无论是工厂环境还是桌面环境,以及执行任务所需的各类物体,都需要丰富的资产支撑。这些资产的储备是目前具身智能开发中的关键卡点。其次,物理仿真的质量也至关重要。机器人与自动驾驶不同,自动驾驶的目标是避免碰撞和接触,而机器人执行任务时,时时刻刻都需要与物体发生物理交互。

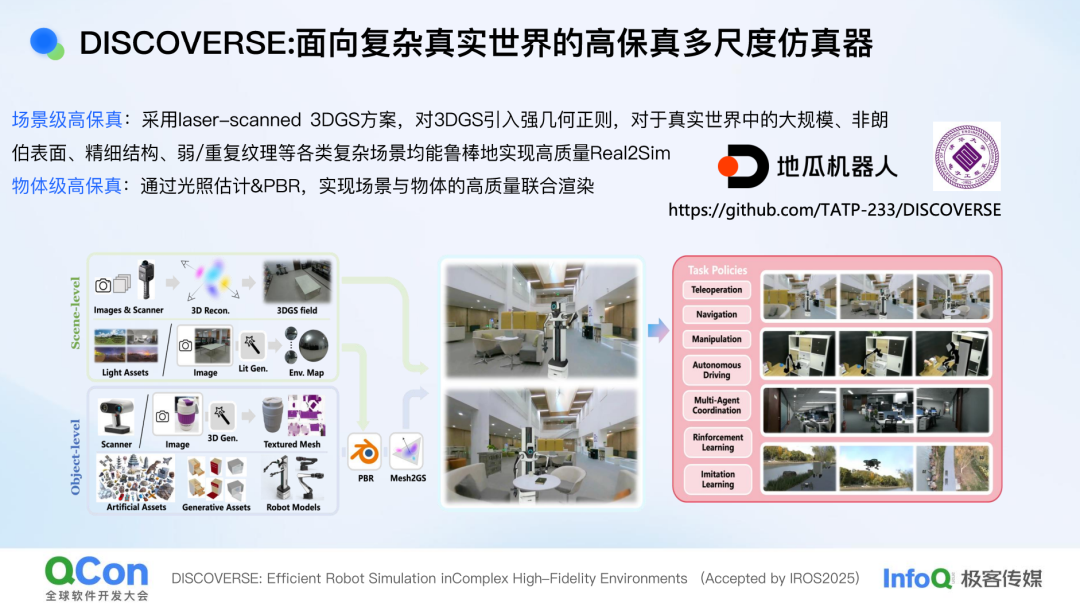

目前,像 MuJoCo 或 Isaac Gym 等成熟的仿真器在物理仿真方面表现较好。具身智能对传感器的仿真模型支持要求极高,目前主流的仿真平台包括我们与高校合作开发的成果,比如与上海交通大学合作的 RobotStudio,以及与清华大学合作的 DICOVERSE。此外,业界还有像 RoboVerse 等面向具身智能的仿真框架。以 DICOVERSE 为例,它的主要特点是具备“实对虚(Real-to-Sim)”再到“虚对实(Sim-to-Real)”的功能,通过 3D 高斯泼溅(3DGS)技术完成环境重建后再进行渲染,从而获得极高的真实感,便于数据生成和模型测试。

除了传统的数字孪生技术,我们最近还在尝试一种新的方案。业界常说的数字孪生追求的是对真实环境 1:1 的复刻,而我们提出了一个概念叫“数据表亲”。其核心逻辑是,在很多训练场景下,我们并不一定需要完全一致的 1:1 复刻,只要仿真环境中能出现类似的物体,就能达到训练效果。

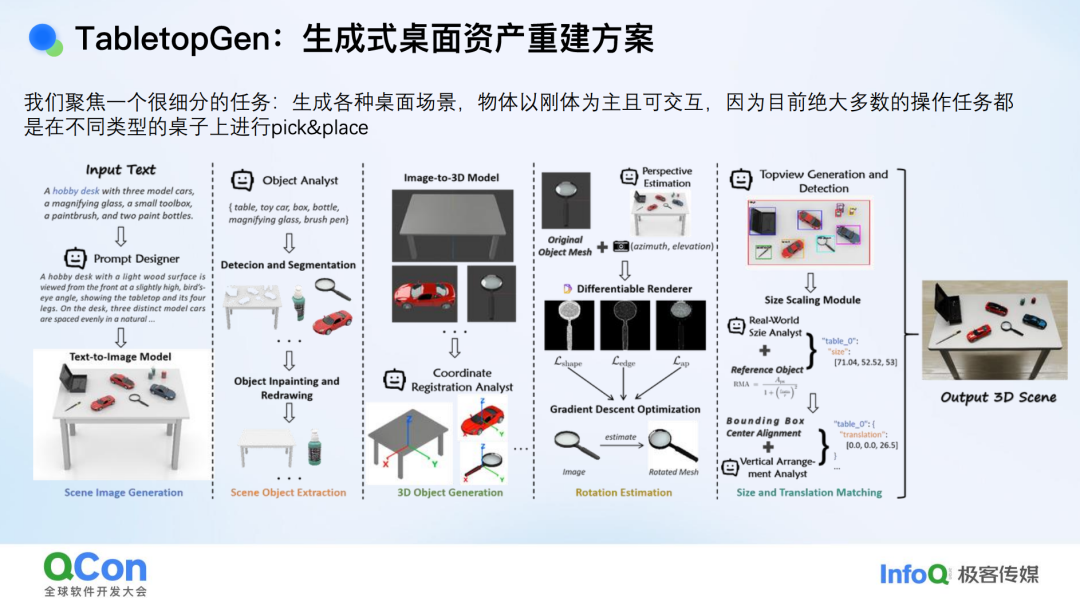

目前,我们正针对桌面这类固定场景进行开发,通过输入一张图像或一段文字描述,利用生成式 AI 技术产生 3D 资产并构建出三维场景。更重要的是,这些生成的场景都具备物理仿真属性。正如我前面提到的,仿真器中数据资产的丰富程度决定了上限,而这种生成式的方法正是为了解决资产稀缺的问题。

这里举了一些具体的例子。左边是输入的原始图像,右边是生成的 3D 场景。可以看到,虽然两者并非完全一致,但物体基本上都实现了一一对应,这完全是通过大模型的方式生成的。在过去,如果我们要做这类物体重建,必须使用高精度激光扫描来生成 Mesh,那种方式效率很低,且复杂物体的 Mesh 重建难度极大。现在得益于底层 3D 生成式大模型的发展,我们可以比较容易地生成这些高精度、高逼真度的 3D 模型。

VLA 模型的量化部署

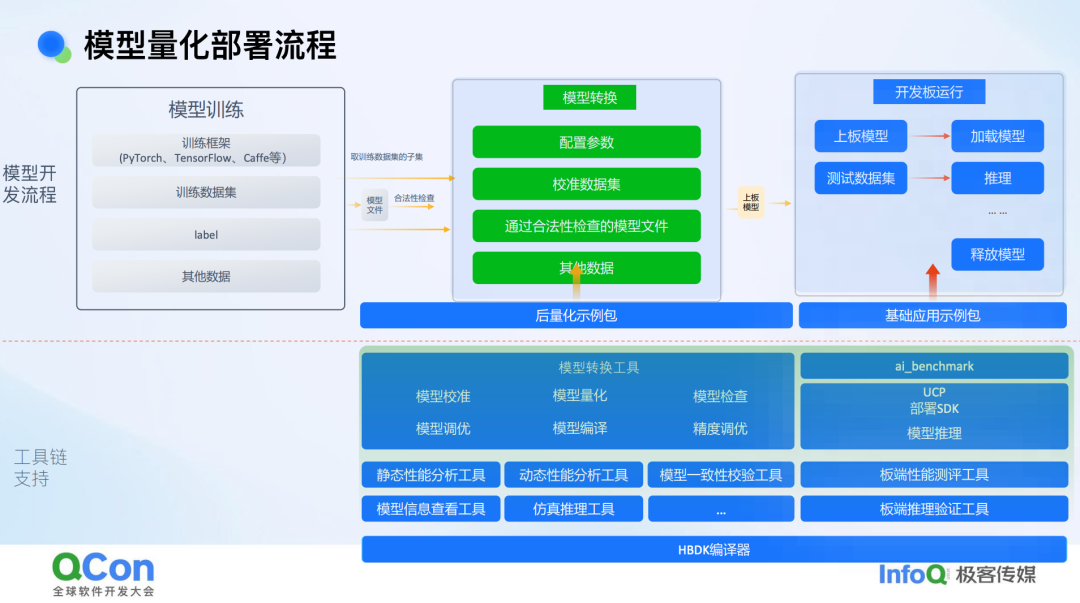

关于模型量化与部署,这是工程实践中非常关键的一环。在 GPU 上训练模型时,为了保证精度,通常使用 Float 32 或 FP16 等数据类型。但在推理阶段,这些类型的存储代价太高。举个简单例子,一个 1B(十亿参数)的模型,如果量化为 4 比特或 8 比特,模型大小约为 1GB 左右;若使用 Float 32,则需要 4GB。这会极大影响端侧的运行效率。因此,目前在端上运行时,都需要将模型量化并迁移到 ASIC(专用集成电路)上。目前主流的 VLM 量化方式通常是量化到 4 比特,且性能损失较小。通常芯片供应商会提供成熟的工具链来完成这种转换。在 VLA 中,量化的主要挑战在于扩散策略(Diffusion Policy)部分,因为它需要极高精度的姿态信息。在实际部署时,往往需要采用异构部署方案,根据任务特性将不同模块分配到 AI 加速器、CPU 或 DSP 上运行。

部署流程本质上是一个数据映射的过程,即将浮点数类型映射到 INT8 或 INT4 上。这个过程需要使用部分数据进行模型校准,观察映射后是否存在精度大幅下降(掉点)的情况。这些都是工具链提供的标准化处理流程。如果量化后性能无法满足要求,就必须回头重新修改模型结构。

总结与展望

总结来看,我们介绍了从数据采集、模型设计、训练到最终部署的完整开发过程。目前的现状是,整个 VLA 领域仍处于非常早期的阶段。首先是缺少高质量的数据,且机器人本体目前极不标准;其次模型结构尚不成熟,直接将 VLM 映射到 Action 这种“头重脚轻”的形式,难以建立起稳固的连接;最后是硬件本体的局限,目前市面上的机器人硬件还不足以支持完成各种复杂任务。一个验证标准是:即使在有人类遥操作的情况下,很多任务都不一定能顺利完成。

展望未来,有两个重要的探索方向。模型层面,大家正在尝试引入触觉信息、强化学习等技术。因为动作轨迹的训练不能仅靠简单的回归损失函数来完成,强化学习可以通过稀疏奖励(比如只告诉模型结果的好坏)来训练模型。此外,世界模型(World Model)也处于预研阶段,重点在于 3D 空间表达、记忆信息和思维链,我们认为这是改造 VLA 最关键的点。

我认为 VLA 要实现量产,除了端侧模型本身,更多的精力应该放在构建数据闭环上。现在的具身智能其实很像 Robotaxi。Robotaxi 在行驶中不能有人干预,但遇到困难时需要云端接管,随着技术进步,接管次数会逐渐降低,智能化随之提高。机器人也是如此,如果工作时旁边必须有人,其商业模式就无法成立。因此,我们可以借鉴 Robotaxi 的路线:先通过人工遥操作让机器人进入实际场景工作,在这一过程中收集大量数据,随着自动化程度的提升逐渐减少遥操作频率,最终实现真正的自主化。

演讲嘉宾介绍

隋伟博士,现任地瓜机器人算法副总裁。

2011 年,他于北京航空航天大学探测制导与控制技术专业毕业,之后进入中科院自动化研究所深造,并取得博士学位,其研究方向为模式识别与智能系统。

2016 年 7 月博士毕业后,担任模式识别国家重点实验室助理研究员,负责 3D 视觉感知方向的研发工作。

2019 年 1 月隋伟博士加入地平线,任高级算法工程师,主要负责机器人和自动驾驶场景下,基于旭日和征程系列芯片的 2.5D 及 3D 视觉算法研发。2020 年 12 月 - 2023 年 12 月,任研发总监,带领团队(30 人)成功开发了地平线高阶自动驾驶 BEV 感知方案,并且搭建了国内首套最为完备且先进的 4D Label 标注系统。目前旭日系列芯片出货量已达数百万片,BEV 感知方案也已在多个车型上定点量产,为自动驾驶领域的发展做出了重要贡献。隋伟博士在 ICRA、IROS、CVPR、TIP、TVCG 等国内外知名期刊和会议上先后发表学术论文 20 余篇,拥有专利 40 多项。此外,他长期担任 ICRA、IROS 等机器人会议的审稿人,同时担任《智能驾驶和机器视觉》《智能驾驶与多维重建》等自动驾驶相关著作的主编。

2023 年 11 月至今任地瓜机器人算法 VP ,负责面向消费机器人和具身智能的软件算法方案研发。

会议推荐

OpenClaw 出圈,“养虾”潮狂热,开年 Agentic AI 这把火烧得不可谓不旺。在这一热潮下,自托管 Agent 形态迅速普及:多入口对话、持久记忆、Skills 工具链带来强大生产力。但这背后也暴露了工程化落地的真实难题——权限边界与隔离运行、Skills 供应链安全、可观测与可追溯、记忆分层与跨场景污染、以及如何把 Agent 纳入团队研发 / 运维流程并形成稳定收益。

针对这一系列挑战,在 4 月 16-18 日即将举办的 QCon 北京站上,我们特别策划了「OpenClaw 生态实践」专题,将聚焦一线实践与踩坑复盘,分享企业如何构建私有 Skills、制定安全护栏、搭建审计与回放机制、建立质量 / 效率指标体系,最终把自托管 Agent 从可用的 Demo 升级为可靠的生产系统。