DoorDash 构建并部署了一个AI驱动的安全系统SafeChat,用于审核配送员与顾客在应用内聊天、发送图片及进行语音通话时的互动内容。SafeChat 运用机器学习技术,可近乎实时地检测并响应不安全内容,筛查通信中的冒犯性或不当信息,并支持立即采取行动,如举报问题或取消配送任务。该系统专注于安全保障而非用户互动或自动化。它以 AI 为核心基础设施,旨在维护平台的信誉及保障配送员与顾客的利益。

SafeChat 使用了分层 AI 架构,结合了机器学习模型与人工审核。该系统每天处理数百万次互动,对文本消息、图片和语音通信内容进行分类。其文本审核分为两个阶段。

在第一阶段,DoorDash 工程师采用了一个三层方案。第一层是审核 API,提供了一个低成本、高召回率的过滤器,以极小的延迟自动清除了大约 90%的消息。随后,未被清除的消息进入一个速度快、成本低的大型语言模型(LLM),它能以更高的精确度将 99.8%的消息识别为安全信息。剩余的消息由一个更精确、成本更高的 LLM 进行评估,对包含不敬言语、威胁和性内容的消息进行评分。这些评分可以为采取安全行动提供支持,例如在检测到高风险消息时允许配送员取消订单。

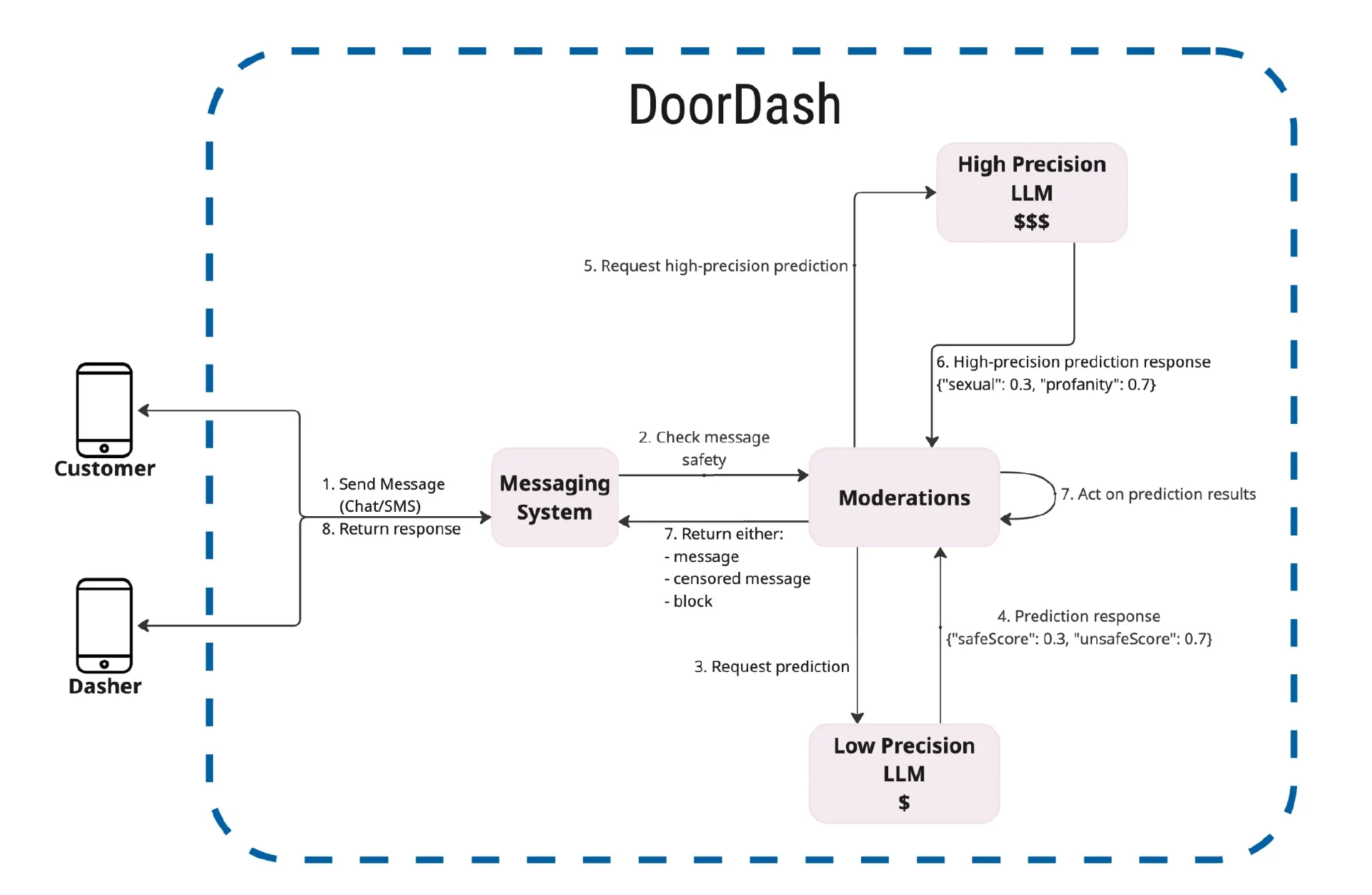

DoorDash 基于第一阶段的大约 1000 万条消息训练了一个内部模型,第二阶段因此能够采用一种双层方案。内部模型为第一层,用于自动清除大多数消息。只有被标记的消息才会进入精确的 LLM 进行详细评分。第一层的响应时间在 300 毫秒之内,而被标记的消息可能需要长达三秒钟。该系统处理了 99.8%的流量,提高了可扩展性并降低了成本。

DoorDash 双层文本审核架构(图片来源:DoorDash技术博客)

图片审核由计算机视觉模型负责处理,模型的选择依据是吞吐量和粒度。为了减少误报和漏报,他们通过反复的人工审核调整了阈值和置信度分数。该系统每天可以处理数十万张图片,而且延迟可以满足实时互动的要求。

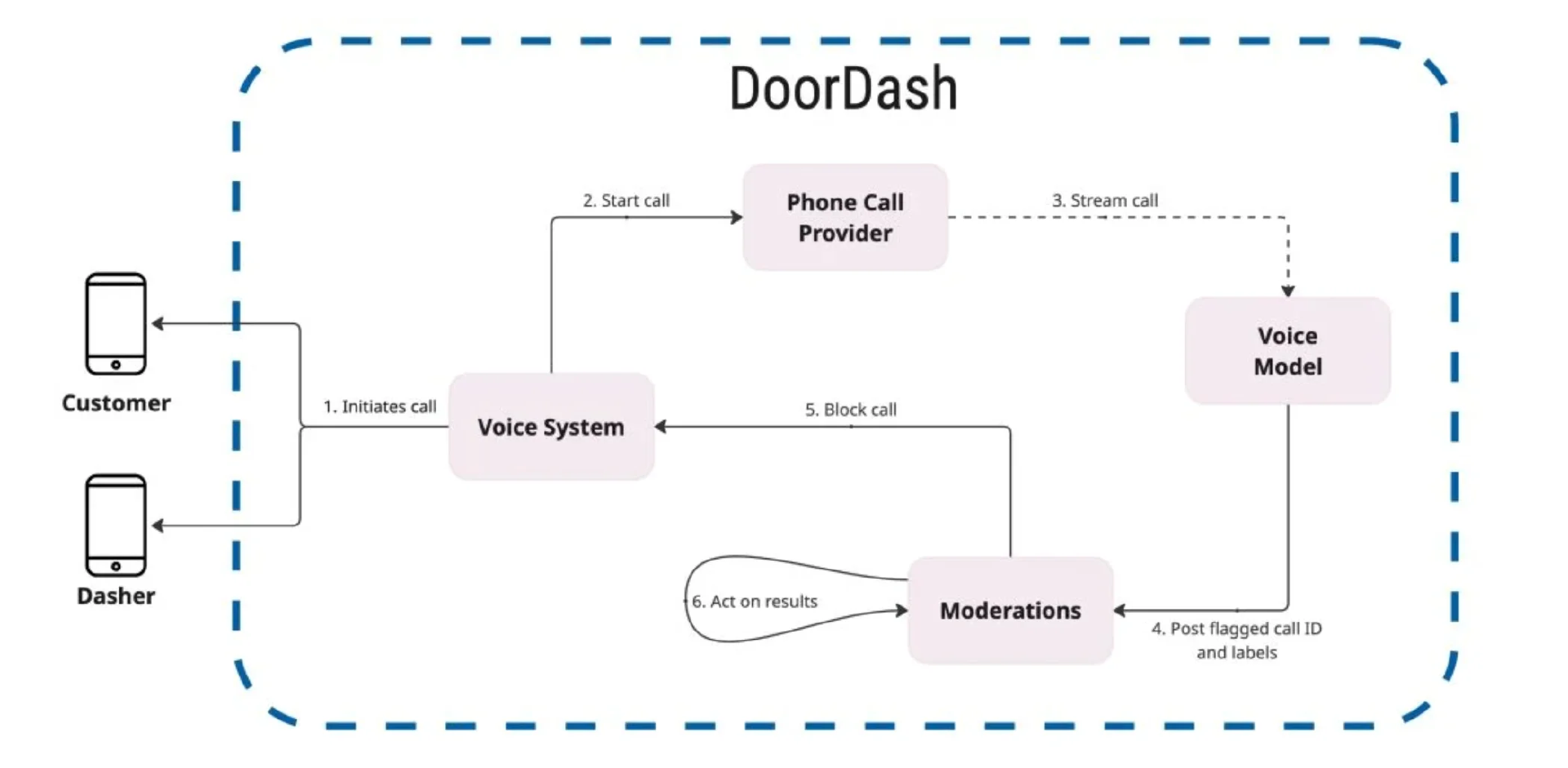

语音审核最初以仅观察模式部署,用于校准置信度分数。待阈值验证完成后,系统即可自动执行干预措施,例如中断通话或限制后续通信。

DoorDash 语音审核架构(图片来源:DoorDash技术博客)

在 LinkedIn 上,作为特性发布公告的一部分,DoorDash 表示:

SafeChat 通过 AI 创新和精心设计,使平台上的每个人都建立起信心和信任,为所有用户打造一个更安全顺畅的使用体验。

SafeChat 的执行层根据违规的严重性和反复性采取相应的行动。它可以阻止或删除不安全的消息,终止通话,限制通信,或将问题升级给人类安全代理。重复出现或严重的违规行为会触发账户审查或暂停。

根据 DoorDash 工程师的报告,通过将分层 AI 模型与人类反馈循环相结合,SafeChat 系统得以实现大规模运行并保持近乎实时的响应速度。按照该公司的说法,该系统自部署以来,已使中低严重程度的安全事件减少了约 50%。

原文链接:

https://www.infoq.com/news/2026/01/doordash-safechat-ai-safety/